Der Leitfaden zum technischen SEO für Einsteiger

Nach Autor Patrick Stox

Technisches SEO bei Ahrefs

Technisches SEO ist der wichtigste Teil von SEO – bis es das nicht mehr ist. Seiten müssen crawlbar und indexierbar sein, um überhaupt eine Chance auf Rankings zu haben, aber viele andere Aktivitäten haben im Vergleich zu Content und Links nur minimale Auswirkungen.

Wir haben diesen Einsteiger-Guide geschrieben, um dir zu helfen, einige Grundlagen zu verstehen und zu zeigen, wo du deine Zeit am besten investierst, um den größten Effekt zu erzielen.

Grundlagen des technischen SEO

Was ist technisches SEO?

Technisches SEO ist die Praxis, deine Website zu optimieren, um Suchmaschinen dabei zu helfen, deine Seiten zu finden, zu crawlen, zu verstehen und zu indexieren. Es hilft, die Sichtbarkeit und Rankings in Suchmaschinen zu erhöhen. Das ist auch für die KI-Suche wichtig.

Wie kompliziert ist technisches SEO?

Das kommt darauf an. Die Grundlagen sind nicht besonders schwer zu beherrschen, aber technisches SEO kann komplex und schwer verständlich sein. Ich halte die Dinge in diesem Guide so einfach wie möglich.

Ist technisches SEO für die KI-Suche wichtig?

Ja. Die KI-Suche hängt weiterhin von crawlbaren, gut strukturierten, vertrauenswürdigen Webseiten ab. Technisches SEO sorgt dafür, dass deine Website schnell, zugänglich und indexierbar ist – all das erhöht die Chancen, dass deine Inhalte sowohl in KI-gestützten Antworten als auch in der klassischen Suche genutzt werden.

Crawling verstehen

In diesem Kapitel behandeln wir, wie du sicherstellst, dass Suchmaschinen deine Inhalte effizient crawlen können.

Wie Crawling funktioniert

Beim Crawling greifen Suchmaschinen Inhalte von Seiten ab und nutzen die Links darauf, um noch mehr Seiten zu finden. Es gibt einige Möglichkeiten, wie du steuern kannst, was auf deiner Website gecrawlt wird. Hier sind ein paar Optionen.

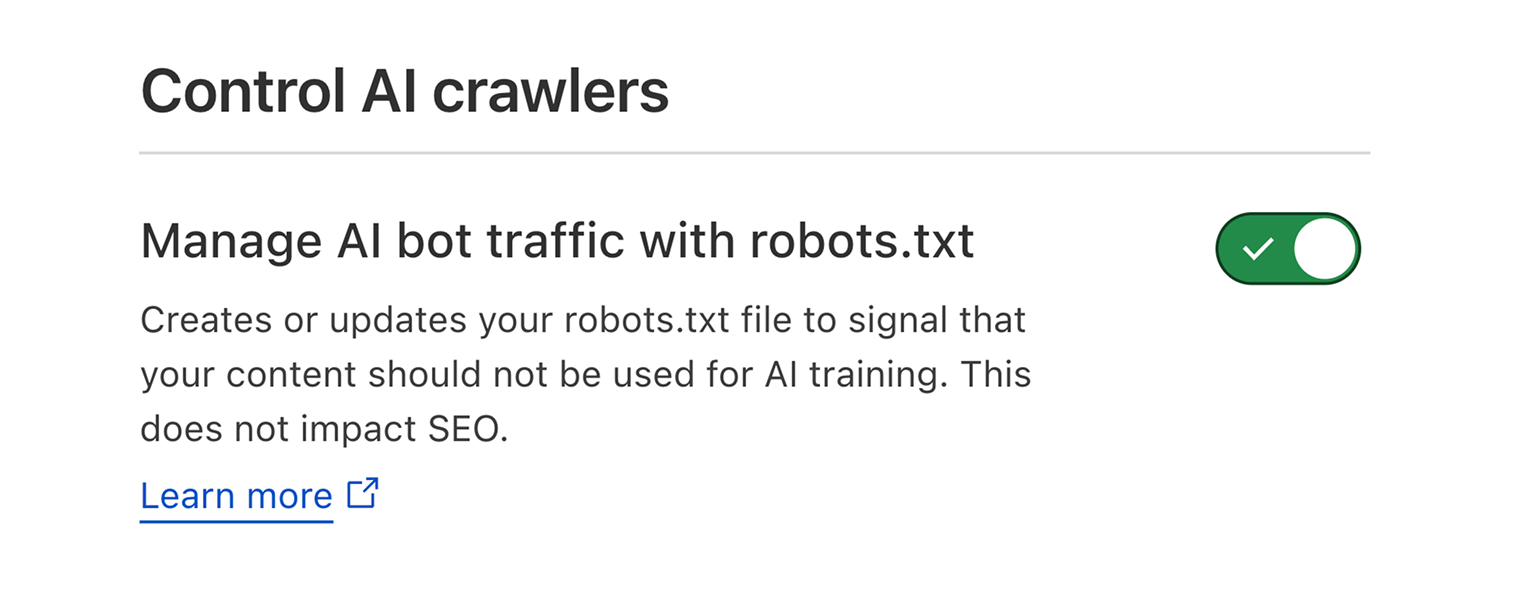

Robots.txt

Eine robots.txt-Datei sagt Suchmaschinen und KI-Plattformen, wo sie auf deiner Website hingehen können und wo nicht.

Die meisten Suchmaschinen und KI-Crawler respektieren deine robots.txt-Einstellungen. Wenn du ihnen den Zugriff ausdrücklich untersagst, halten sie sich daran und crawlen deine Inhalte nicht und nehmen sie nicht in Trainingsdaten auf. Wenn du Suchmaschinen und LLMs jedoch daran hinderst, deine Website als Trainingsmaterial zu verwenden, begrenzt du auch deine Chancen, in ihren Antworten sichtbar zu werden.

Wusstest du schon?

Google und einige LLMs können Seiten indexieren, die sie nicht crawlen können, wenn Links auf diese Seiten zeigen. Das kann verwirrend sein, aber wenn du verhindern willst, dass Seiten indexiert werden, sieh dir diesen Guide und dieses Flussdiagramm an, die dich durch den Prozess führen.

LLMs.txt

LLMs.txt ist ein freiwilliger Standard, um großen Sprachmodellen (LLMs) mitzuteilen, wie sie deine Inhalte verwenden können. Aber wie wir in unserem Guide zu LLMs.txt erklären, ist es nicht besonders effektiv und der Aufwand lohnt sich wahrscheinlich nicht.

Es gibt bisher keine Hinweise darauf, dass LLMs.txt die KI-Abrufbarkeit verbessert, Traffic erhöht oder die Modellgenauigkeit steigert.

Crawl-Rate

Zugriffsbeschränkungen

Wenn die Seite für einige Nutzer, aber nicht für Suchmaschinen zugänglich sein soll, möchtest du wahrscheinlich eine dieser drei Optionen verwenden:

- Eine Art Login-System

- HTTP authentication (bei der ein Passwort für den Zugriff erforderlich ist)

- IP-Whitelisting (das nur bestimmten IP-Adressen erlaubt, auf die Seiten zuzugreifen)

Diese Art von Setup eignet sich am besten für Dinge wie interne Netzwerke, Inhalte nur für Mitglieder oder für Staging-, Test- oder Entwicklungsseiten. Es ermöglicht einer Gruppe von Nutzern den Zugriff auf die Seite, aber Suchmaschinen können nicht auf die Seite zugreifen und werden sie nicht indexieren.

So siehst du Crawl-Aktivität

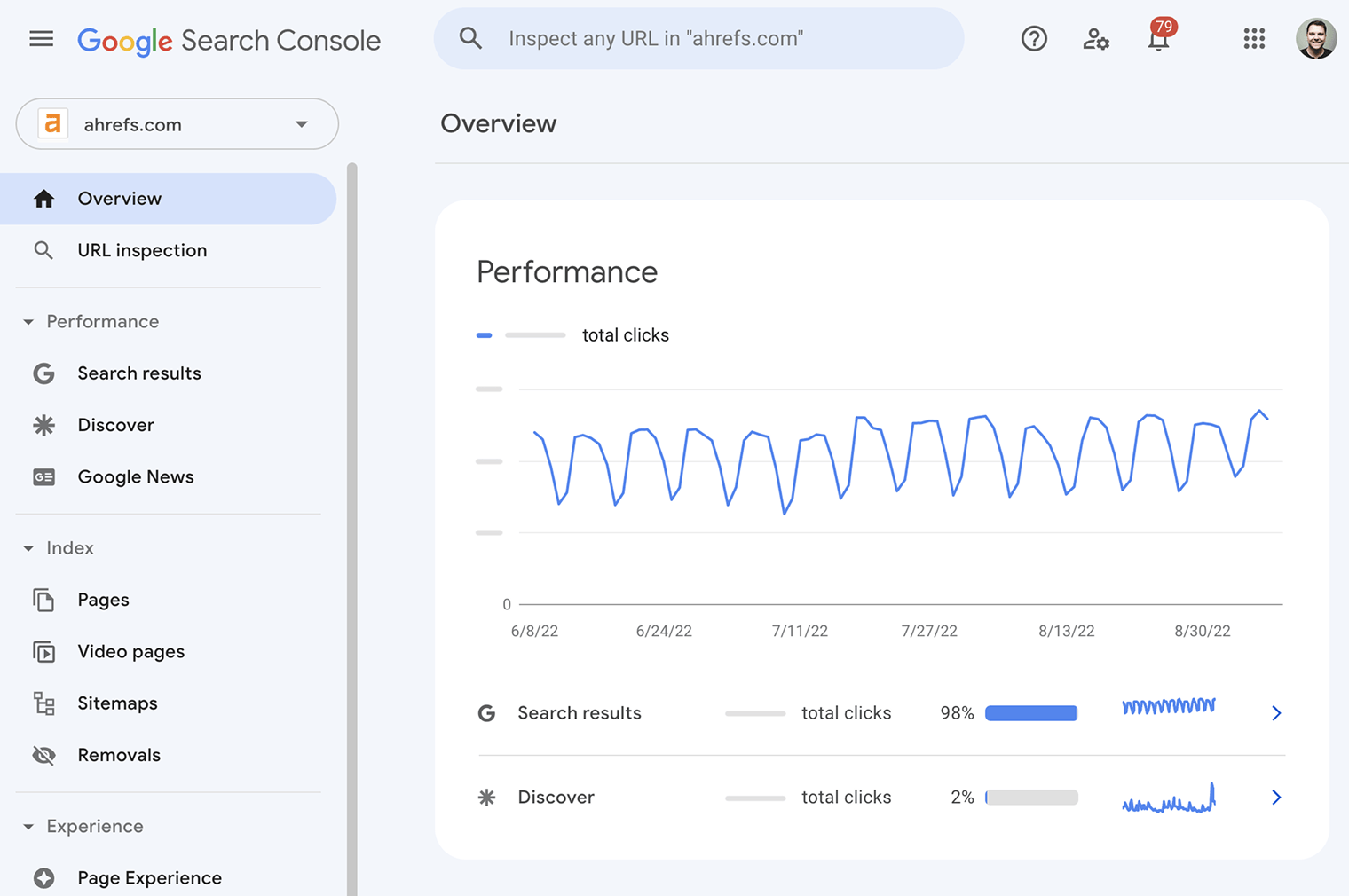

Speziell für Google ist der einfachste Weg, zu sehen, was gecrawlt wird, der Report „Crawl-Statistiken“ in der Google Search Console. Er liefert dir mehr Informationen darüber, wie Google deine Website crawlt.

Wenn du alle Crawl-Aktivitäten auf deiner Website sehen möchtest, einschließlich der von KI-Crawlern, musst du auf deine Server-Logs zugreifen und möglicherweise ein Tool verwenden, um die Daten besser zu analysieren. Das kann ziemlich fortgeschritten sein. Aber wenn dein Hosting ein Control Panel wie cPanel hat, solltest du Zugriff auf Roh-Logs und einige Aggregatoren wie AWstats und Webalizer haben.

Crawl-Anpassungen

Jede Website hat ein anderes Crawl-Budget. Das ist eine Kombination daraus, wie oft Google eine Website crawlen möchte und wie viel Crawling deine Website zulässt. Beliebtere Seiten und Seiten, die sich oft ändern, werden häufiger gecrawlt, und Seiten, die nicht beliebt oder nicht gut verlinkt wirken, werden seltener gecrawlt.

Wenn Crawler beim Crawlen deiner Website Anzeichen von Überlastung erkennen, verlangsamen sie typischerweise oder stoppen das Crawlen sogar, bis sich die Bedingungen verbessern.

Nachdem Seiten gecrawlt wurden, werden sie gerendert und an den Index gesendet. Der Index ist die Masterliste von Seiten, die für Suchanfragen zurückgegeben werden können. Lass uns über den Index sprechen.

Indexierung verstehen

In diesem Kapitel sprechen wir darüber, wie du sicherstellst, dass deine Seiten indexiert sind, und wie du prüfst, wie sie indexiert sind.

Robots-Anweisungen

Ein Robots-Meta-Tag ist ein HTML-Snippet, das Suchmaschinen sagt, wie sie eine bestimmte Seite crawlen oder indexieren sollen. Es wird in den <head>-Bereich einer Webseite eingefügt und sieht so aus:

<meta name="robots" content="noindex" />

Kanonisierung

Wenn Duplicate Content mehrere Versionen derselben Seite erzeugt, wählt Google eine Version aus, um sie in seinem Index zu speichern. Dieser Prozess heißt Kanonisierung, und die als kanonisch ausgewählte URL ist diejenige, die Google in den Suchergebnissen zeigt. Es gibt viele verschiedene Signale, die Google verwendet, um die kanonische URL auszuwählen, darunter:

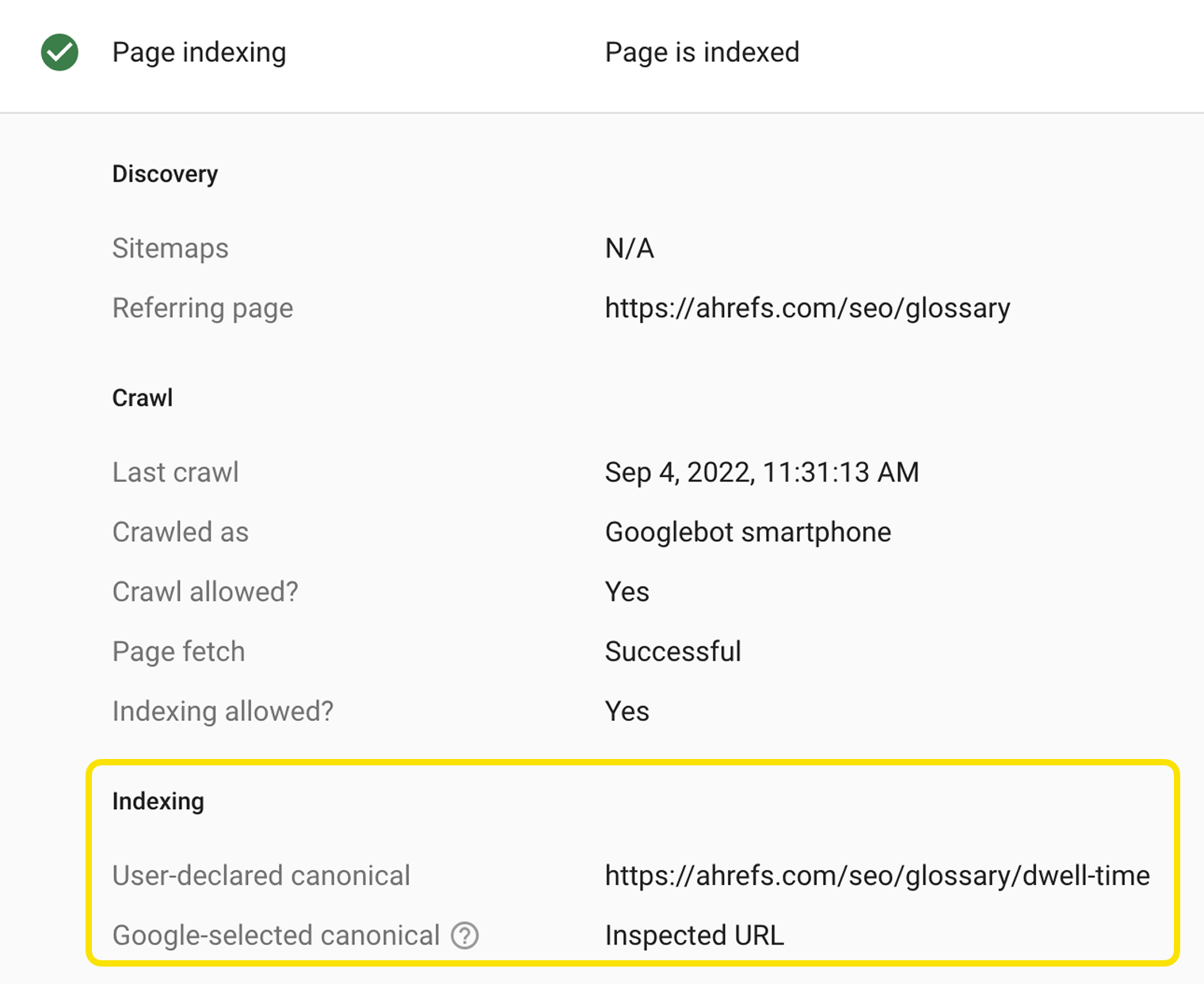

Am einfachsten kannst du herausfinden, wie Google eine Seite indexiert hat, indem du das URL-Prüftool in der Google Search Console nutzt. Dort wird dir die von Google ausgewählte kanonische URL angezeigt.

Schnelle Erfolge für Technisches SEO

Eines der schwierigsten Dinge für SEOs ist die Priorisierung. Es gibt viele Best Practices, aber manche Änderungen haben mehr Einfluss auf deine Rankings und deinen Traffic als andere. Hier sind einige Projekte, die ich zum Priorisieren empfehlen würde.

Indexierung prüfen

Stelle sicher, dass Seiten, die Menschen finden sollen, in Google indexiert werden können. In den zwei vorherigen Kapiteln ging es um Crawling und Indexierung – und das war kein Zufall.

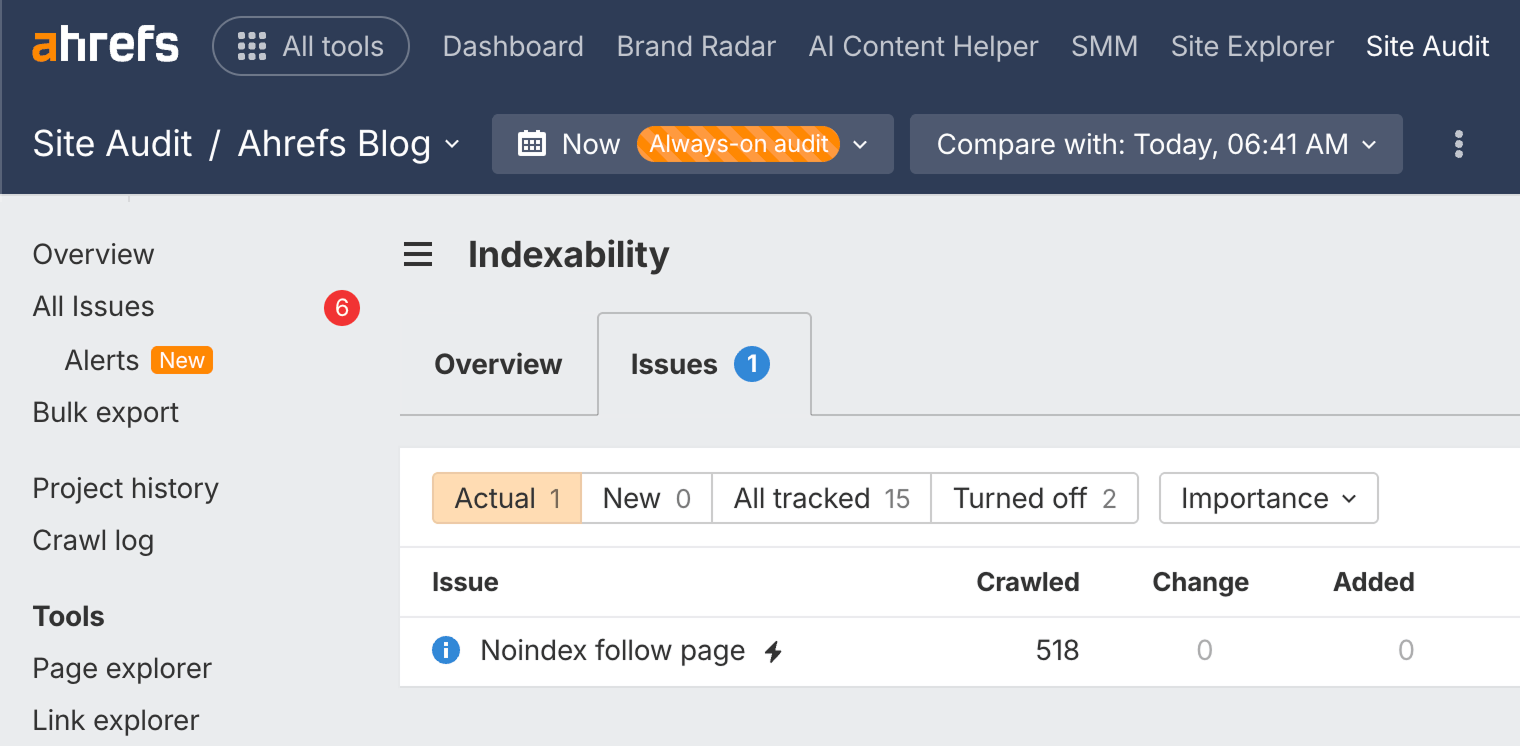

Du kannst den Indexability-Report in Site Audit prüfen, um Seiten zu finden, die nicht indexiert werden können, und die Gründe dafür. Das ist kostenlos in Ahrefs Webmaster Tools.

Führe ein kostenloses technisches SEO-Audit durch

Mit der Anmeldung hier erhältst du kostenlosen Zugang zu den Ahrefs Webmaster Tools ↗

Verlorene Links zurückgewinnen

Websites ändern im Laufe der Jahre oft ihre URLs. In vielen Fällen haben diese alten URLs Links von anderen Websites. Wenn sie nicht auf die aktuellen Seiten weitergeleitet werden, gehen diese Links verloren und zählen nicht mehr für deine Seiten. Es ist nicht zu spät, diese Weiterleitungen einzurichten, und du kannst schnell jeden verlorenen Wert zurückholen. Sieh das als den schnellsten Linkaufbau an, den du je machen wirst.

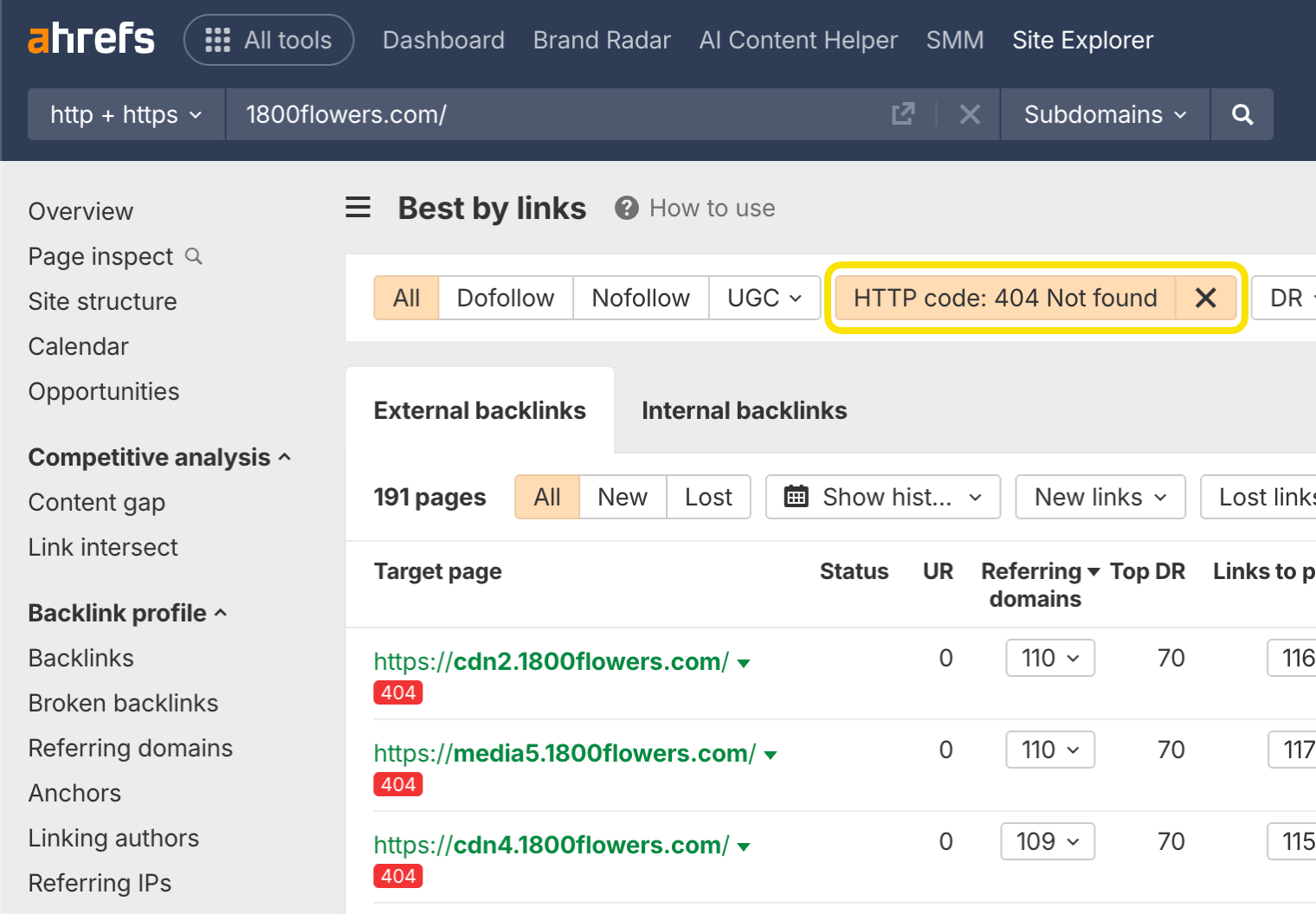

Du kannst Möglichkeiten finden, verlorene Links zurückzugewinnen, indem du Ahrefs’ Site Explorer verwendest. Gib deine Domain ein, gehe zum Report Beste nach Links und füge einen Filter für die HTTP-Antwort „404 not found“ hinzu. Ich sortiere das normalerweise nach „Verweisende Domains“.

So sieht es für 1800flowers.com aus:

Wenn ich mir die erste URL in archive.org ansehe, sehe ich, dass das früher die Muttertags-Seite war. Indem du diese eine Seite auf die aktuelle Version weiterleitest, holst du 225 Links von 59 verschiedenen Websites zurück – und es gibt noch viele weitere Möglichkeiten.

Ich habe sogar ein Skript erstellt, das dir hilft, Weiterleitungen abzugleichen. Keine Sorge: Du musst nur ein paar Dateien herunterladen und hochladen. Das Colab-Notebook führt dich durch den Prozess und übernimmt die schwere Arbeit für dich.

Du solltest alle alten URLs per 301 Redirect auf ihre aktuellen Ziele weiterleiten, um diesen verlorenen Wert zurückzugewinnen.

Wusstest du schon?

Ein 301 Redirect ist eine permanente Weiterleitung. Alle Links, die auf die weitergeleitete URL zeigen, zählen in den Augen von Google zur neuen URL.[3]

Interne Links hinzufügen

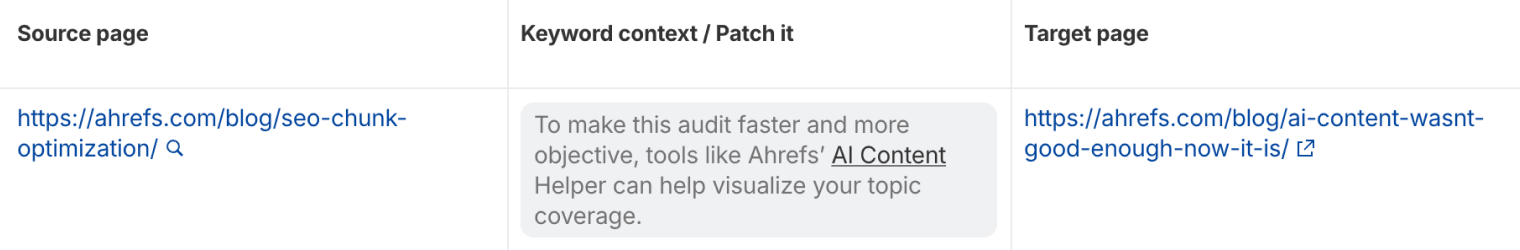

Interne Links sind Links von einer Seite deiner Website zu einer anderen Seite deiner Website. Sie helfen dabei, dass deine Seiten gefunden werden, und helfen außerdem dabei, dass die Seiten besser ranken. Wir haben ein Tool in Site Audit namens Internal Link Opportunities, das dir hilft, diese Möglichkeiten schnell zu finden.

Dieses Tool sucht nach Erwähnungen von Keywords, für die deine Website bereits gut rankt. Anschließend schlägt es diese als Möglichkeiten für kontextbezogene interne Links vor.

Das Tool zeigt zum Beispiel eine Erwähnung von „faceted navigation“ in unserem Guide zu Duplicate Content. Da Site Audit weiß, dass wir eine Seite über faceted navigation haben, schlägt es vor, einen internen Link zu dieser Seite hinzuzufügen.

Schema-Markup hinzufügen

Schema markup ist Code, der Suchmaschinen hilft, deine Inhalte besser zu verstehen, und viele Funktionen ermöglicht, mit denen sich deine Website in den Suchergebnissen von anderen abheben kann. Es kann LLMs auch helfen, den Inhalt deiner Seite korrekt zu interpretieren. Google hat eine Search Gallery, die verschiedene Suchfunktionen und das dafür benötigte Schema zeigt, damit deine Website dafür infrage kommt.

Technisches SEO für KI-Suche

KI hat verändert, wie Inhalte gefunden und Suchenden angezeigt werden, aber sie stützt sich weiterhin auf ein Fundament aus crawlbaren, gut strukturierten und vertrauenswürdigen Webseiten. Außerdem verändert sie, wie wir Inhalte erstellen und optimieren.

Wenn du einige KI-spezifische technische Faktoren beachtest, kannst du sichtbar bleiben – egal, wo Menschen nach Informationen suchen.

Mach deine Website für LLMs zugänglich

Wie Suchmaschinen müssen auch LLMs in der Lage sein, deine Website zu crawlen und auf ihre Inhalte zuzugreifen. Allerdings funktionieren sie ein wenig anders als Suchmaschinen-Crawler.

Die meisten LLMs rendern zum Beispiel kein JavaScript, eine gängige Programmiersprache zum Erstellen von Websites. Wenn wichtige Inhalte oder Navigation erst nach dem Laden von JavaScript erscheinen, besteht das Risiko, dass einige KI-Crawler sie nicht sehen. Daher ist es am besten, es für alle geschäftskritischen Inhalte zu vermeiden, die in der KI-Suche sichtbar sein sollen.

Es lohnt sich auch zu prüfen, ob Drittanbieter-Tools KI-Crawler daran hindern, auf deine Website zuzugreifen.

Cloudflare führte beispielsweise neue Funktionen ein, mit denen Website-Betreiber steuern können, ob KI-Plattformen Inhalte für ihre Trainingsdatensätze scrapen dürfen.

Die Standardeinstellung blockiert KI-Crawler beim Zugriff auf Inhalte. Du musst sie jedoch deaktivieren, wenn du mit deinen Inhalten maximale Sichtbarkeit in KI-Suchergebnissen erreichen möchtest.

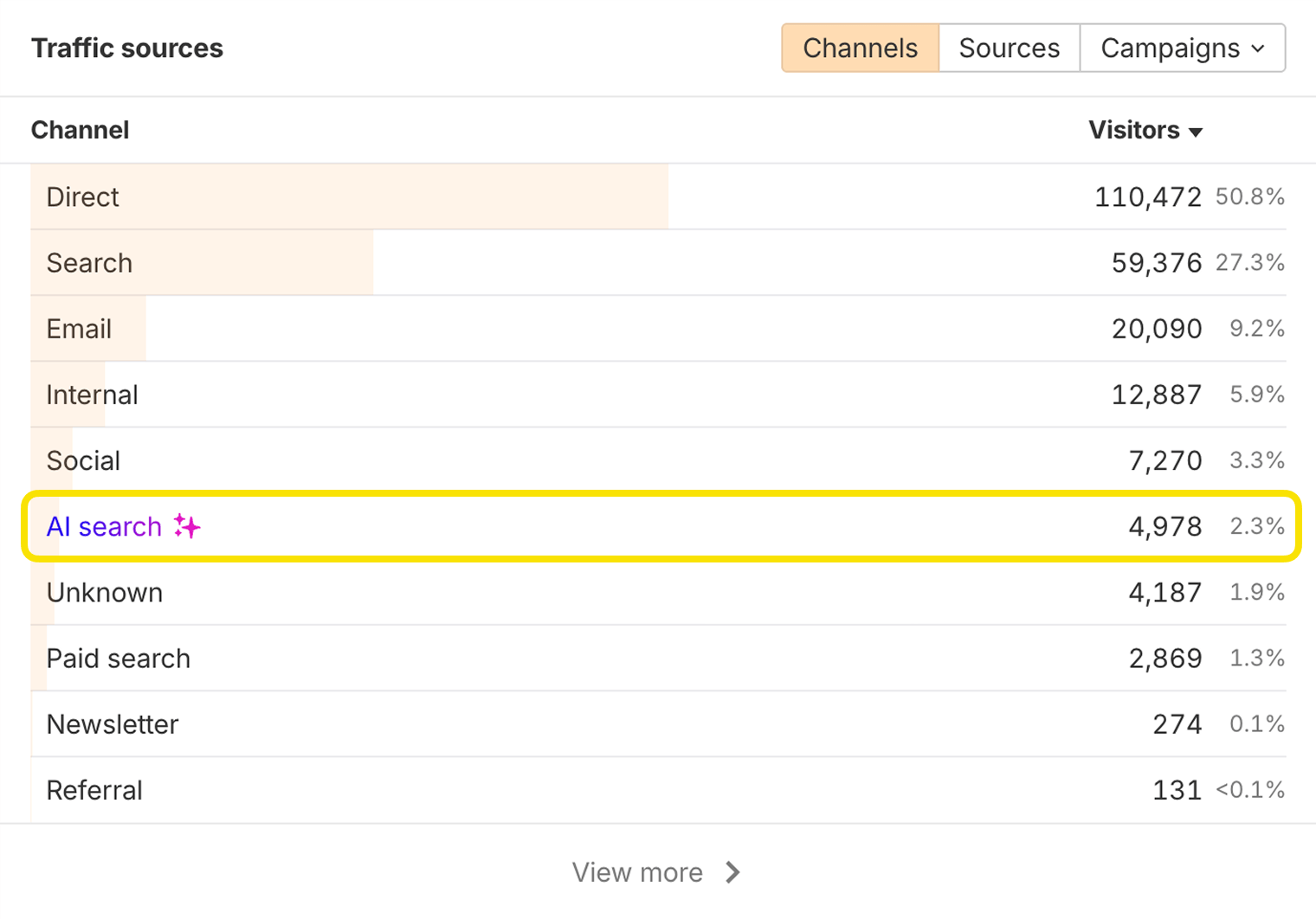

Weiterleitung halluzinierter URLs

KI-Suchsysteme können URLs auf deiner Domain zitieren, die nicht existieren. Du kannst diese in Ahrefs’ Web Analytics finden, indem du dir Seiten ansiehst, die KI-Such-Traffic erhalten:

Wenn eine dieser Seiten auf einen 404-Fehler hinausläuft, hat das KI-System die URL möglicherweise halluziniert. Um keinen Traffic zu verlieren, kannst du diese URL auf eine passende aktive Seite weiterleiten.

Regelmäßiges Monitoring verhindert Frustration bei Nutzern und schützt die Markenautorität.

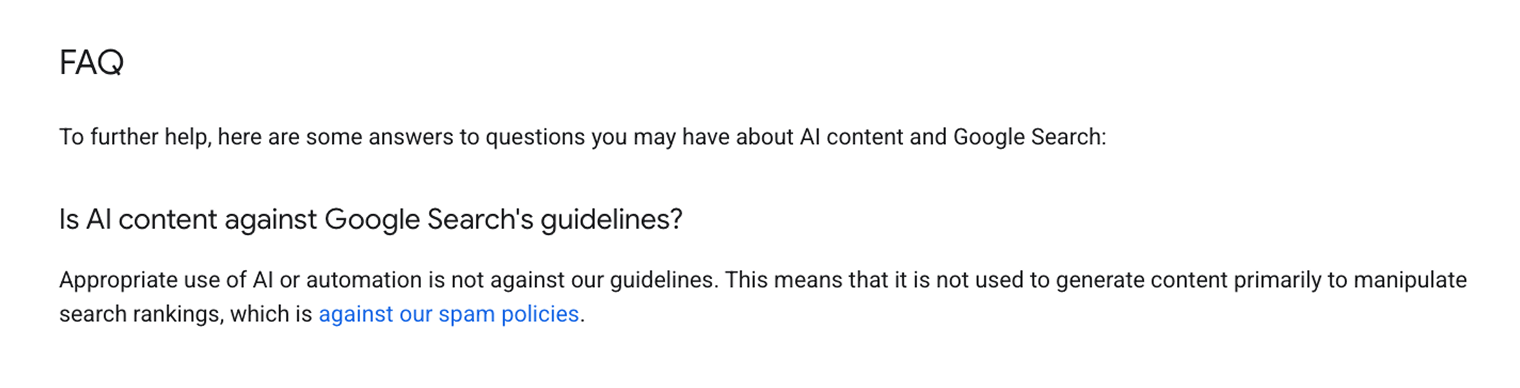

Erkennung von KI-Content

Auch wenn es in Ordnung ist, KI zu nutzen, um Inhalte für deine Website zu erstellen, kann zu viel KI-Content als Spam-Signal wahrgenommen werden, das die Sichtbarkeit deiner Inhalte in klassischen und KI-Suchsystemen einschränkt.

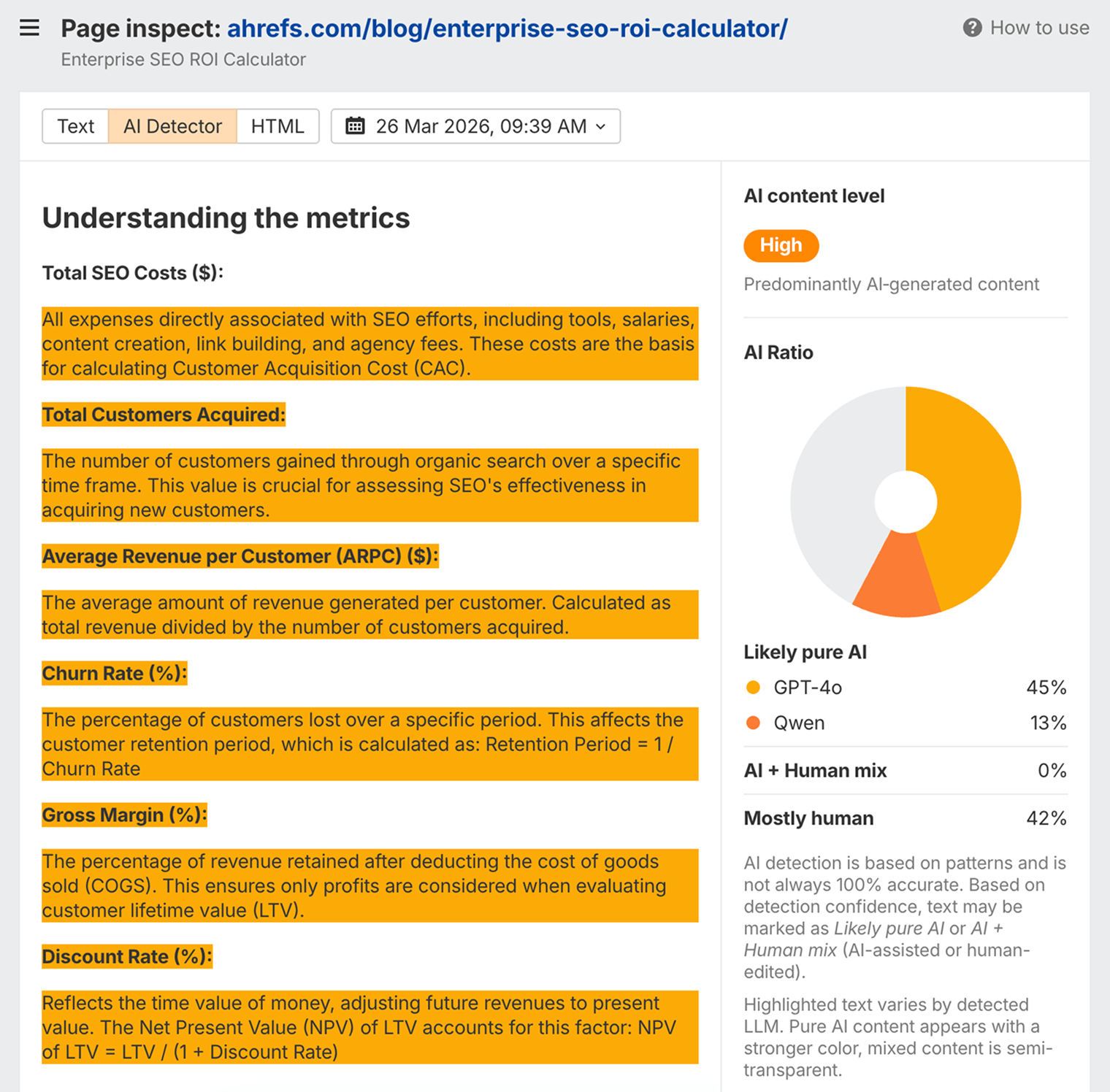

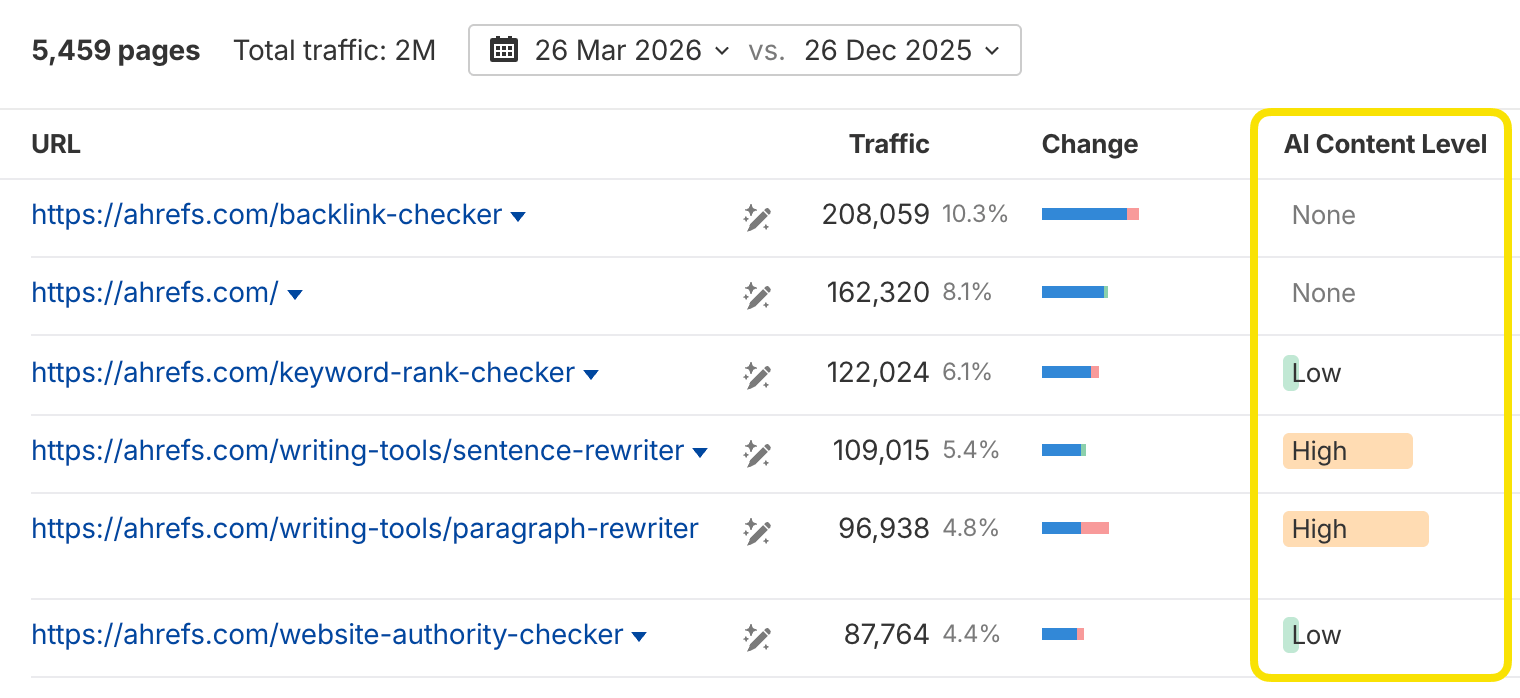

Du kannst den KI-Detektor von Ahrefs in Site Explorer > Page Inspect verwenden, um zu sehen, wie Maschinen den KI-Anteil in deinen Inhalten interpretieren könnten.

Du kannst das auch gesammelt im Report Top Seiten prüfen, um bestehende Seiten zu finden, die möglicherweise überarbeitet werden müssen:

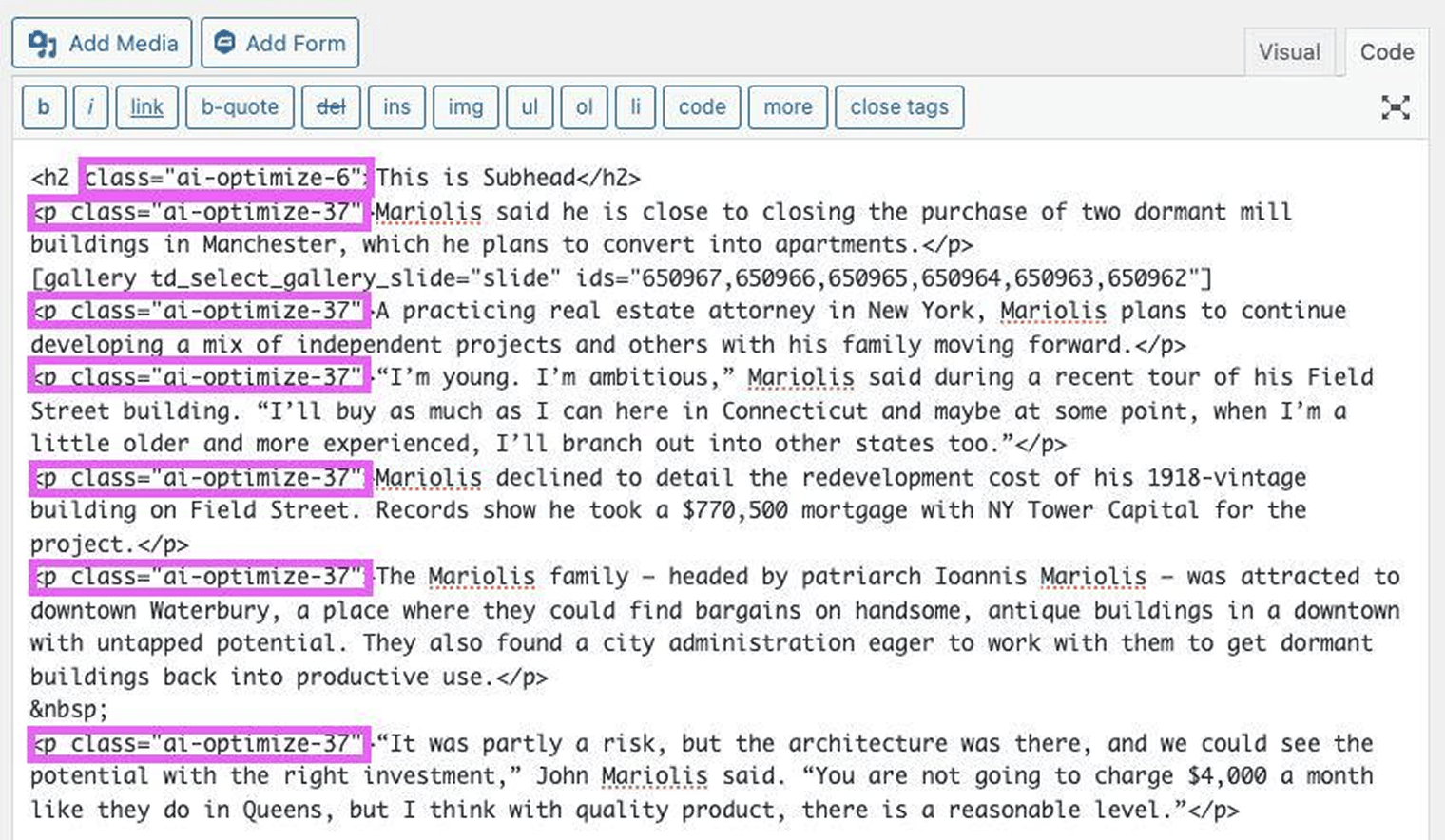

Von KI-Tools injizierter Code

Wenn du KI genutzt hast, um deine Website zu erstellen oder ihr neue Funktionen hinzuzufügen, können dabei zusätzlicher HTML-Code entstehen, der verrät, dass KI verwendet wurde.

In einem Fall fügte ein Bug in Yoast SEO versteckte KI-bezogene Klassen in Seiten ein, wodurch für Suchmaschinen offensichtlich wurde, dass KI beteiligt war.

Wenn du KI-Tools für On-Page-Änderungen verwendest, prüfe den Quellcode deiner Website, um sicherzustellen, dass nichts Unerwartetes hinzugefügt wird. Versteckte „Fingerabdrücke“ wie diese lassen sich durch regelmäßige Code-Reviews und Tests vor dem Veröffentlichen von Updates vermeiden.

Zusätzliche Projekte für technisches SEO

Die Projekte, über die wir in diesem Kapitel sprechen, sind alles gute Dinge, auf die man sich konzentrieren sollte, aber sie können mehr Arbeit erfordern und weniger Nutzen bringen als die „Quick Win“-Projekte aus dem vorherigen Teil. Das bedeutet nicht, dass du sie nicht machen solltest. Das soll dir nur helfen, ein Gefühl dafür zu bekommen, wie du verschiedene Projekte priorisieren kannst.

Signale zur Seitenerfahrung

Das sind weniger wichtige Rankingfaktoren, aber dennoch Dinge, die du im Sinne deiner Nutzer prüfen solltest. Sie betreffen Aspekte der Website, die die User Experience (UX) beeinflussen.

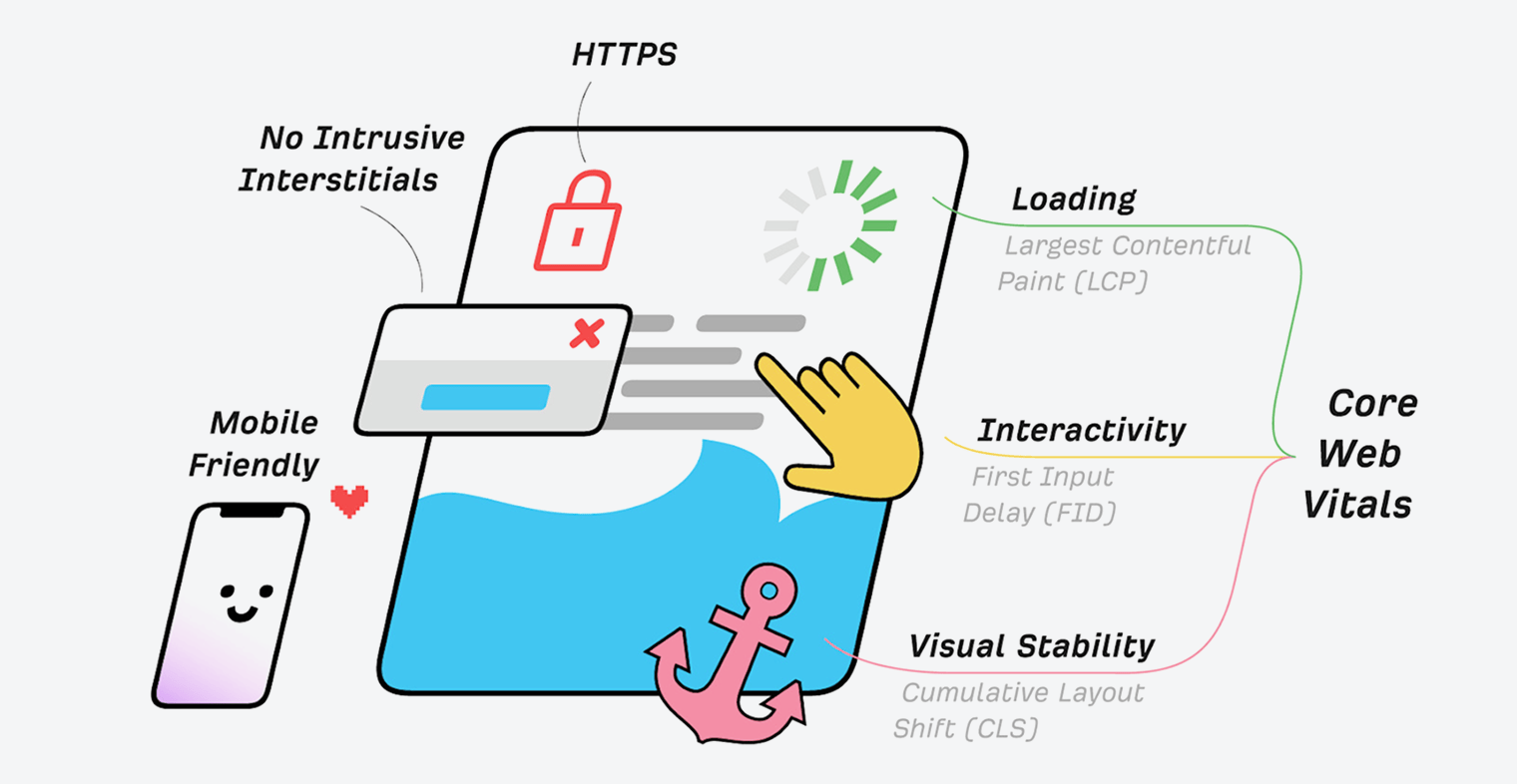

Googles Suchsignale für die Seitenerfahrung

https://ahrefs.com/blog/core-web-vitals/

Core Web Vitals

Core Web Vitals sind Geschwindigkeitsmetriken, die Teil von Googles Signalen zur Seitenerfahrung sind und zur Messung der User Experience verwendet werden. Die Metriken messen die visuelle Ladezeit mit Largest Contentful Paint (LCP), die visuelle Stabilität mit Cumulative Layout Shift (CLS) und die Interaktivität mit First Input Delay (FID).

HTTPS

HTTPS schützt die Kommunikation zwischen deinem Browser und dem Server davor, von Angreifern abgefangen und manipuliert zu werden. Das sorgt für Vertraulichkeit, Integrität und Authentifizierung für den überwiegenden Teil des heutigen WWW-Traffics. Du willst, dass deine Seiten über HTTPS und nicht über HTTP geladen werden.

Jede Website, die ein „Schloss“-Symbol in der Adressleiste zeigt, verwendet HTTPS.

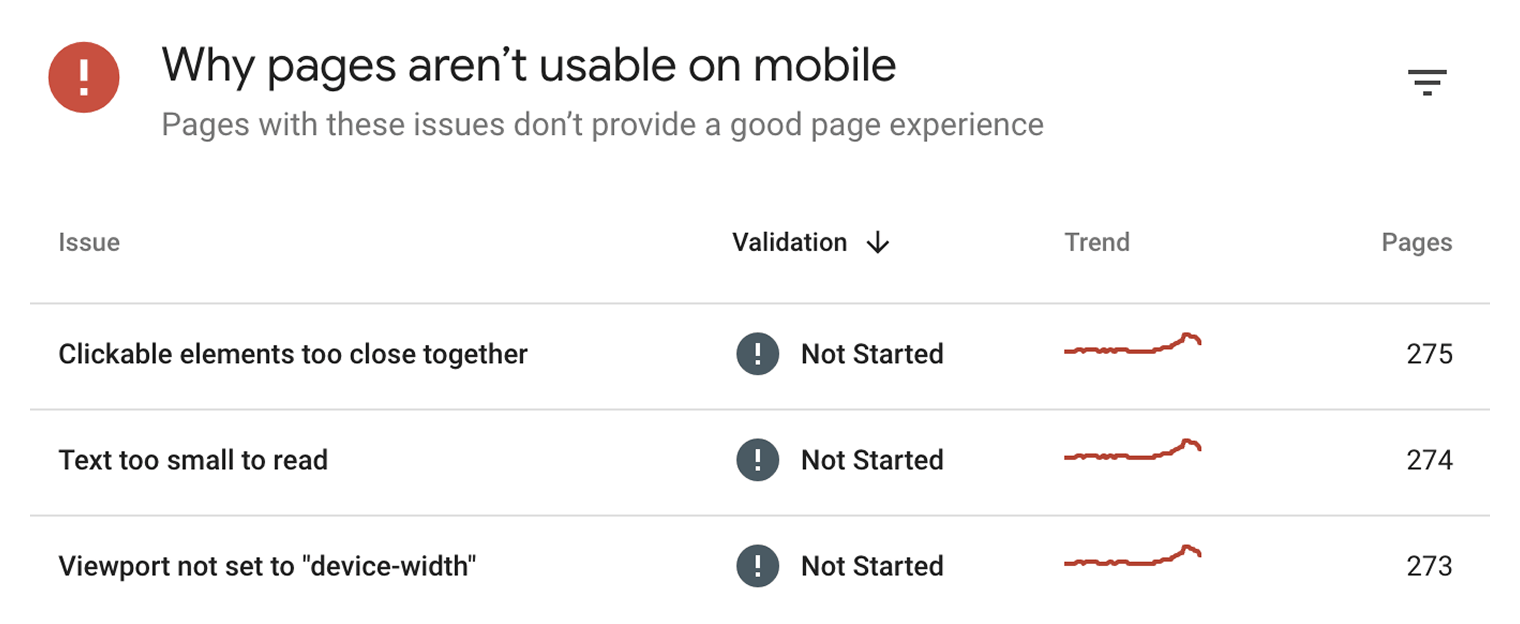

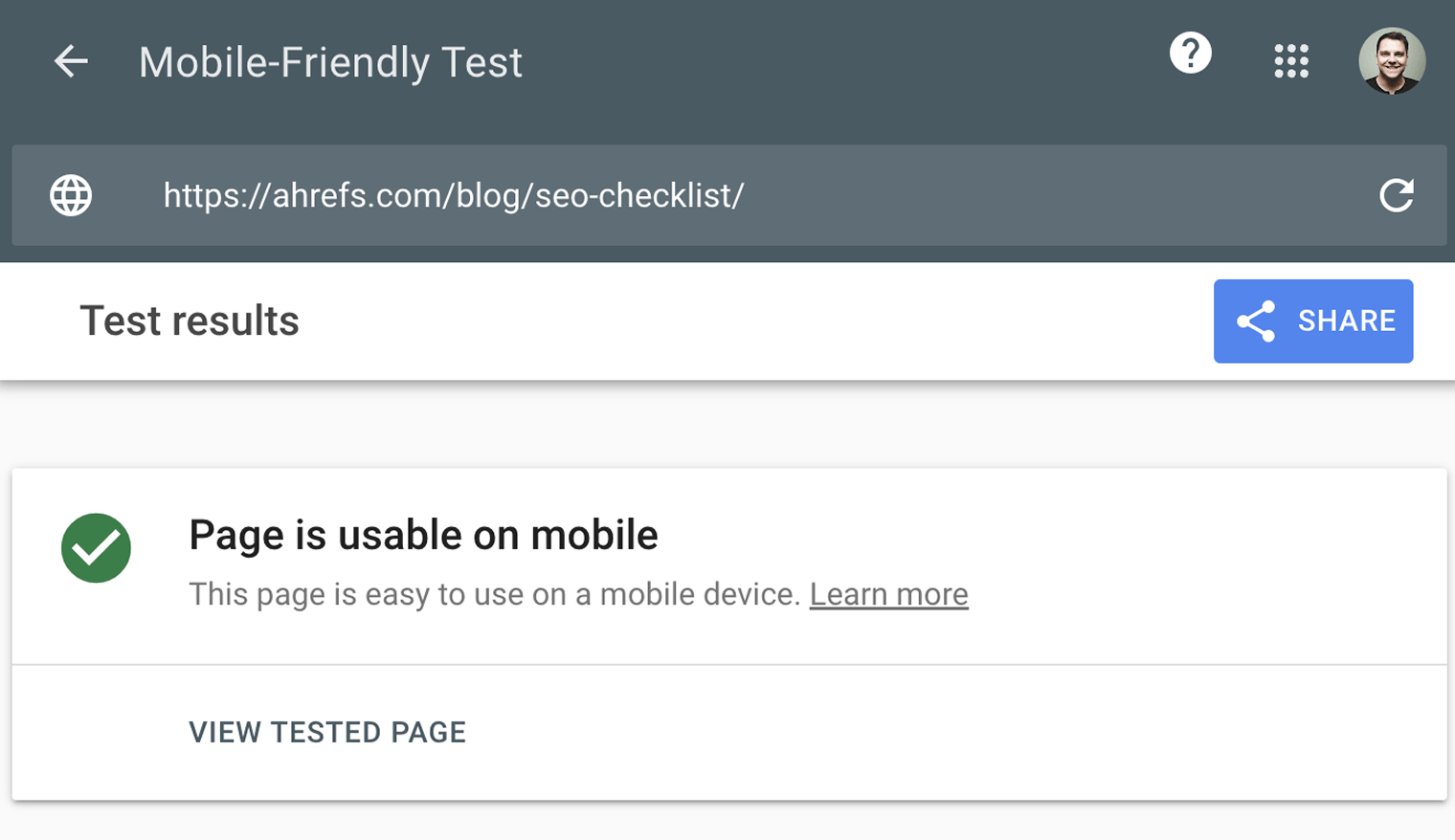

Mobile-Freundlichkeit

Einfach gesagt prüft das, ob Webseiten auf Mobilgeräten korrekt angezeigt werden und sich von Menschen leicht bedienen lassen.

Woher weißt du, wie mobilfreundlich deine Website ist? Schau dir den Report „Mobile Usability“ in der Google Search Console an.

Dieser Report zeigt dir, ob eine deiner Seiten Probleme mit der Mobilfreundlichkeit hat.

Interstitials

Interstitials verhindern, dass Inhalte gesehen werden. Das sind Pop-ups, die den Hauptinhalt überdecken und mit denen Nutzer möglicherweise interagieren müssen, bevor sie verschwinden.

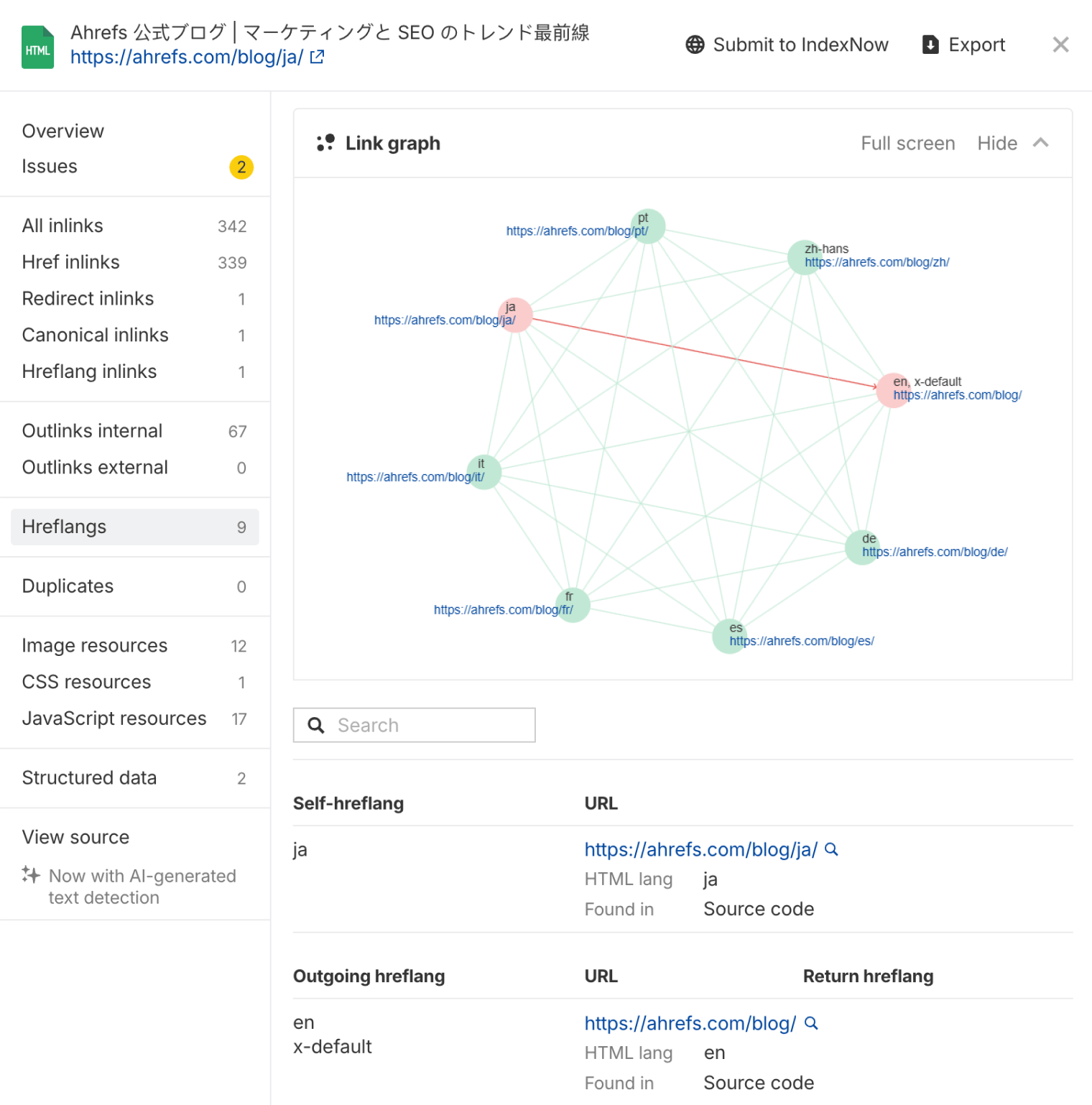

Hreflang – Für mehrere Sprachen

Hreflang ist ein HTML-Attribut, das verwendet wird, um die Sprache und geografische Ausrichtung einer Webseite anzugeben. Wenn du mehrere Versionen derselben Seite in verschiedenen Sprachen hast, kannst du das hreflang-Tag verwenden, um Suchmaschinen wie Google über diese Varianten zu informieren. Das hilft ihnen, ihren Nutzern die richtige Version auszuliefern.

Ahrefs erleichtert die hreflang-Implementierung jetzt mit einem visuellen hreflang-Link-Graphen in Site Audit.

Diese Hreflang-Übersicht zeigt alle Sprachvarianten einer Seite an und macht auf eventuelle Konfigurationsprobleme aufmerksam. Außerdem weist sie auf Fehler wie ungültige Sprachcodes, fehlende interne Links und das Fehlen von gegenseitigen Tags hin und gibt klare Anleitungen, wie du diese beheben kannst.

Allgemeine Wartung/Website-Zustand

Diese Aufgaben werden wahrscheinlich keinen großen Einfluss auf deine Rankings haben, sind aber im Allgemeinen gute Dinge, die man für die User Experience beheben sollte.

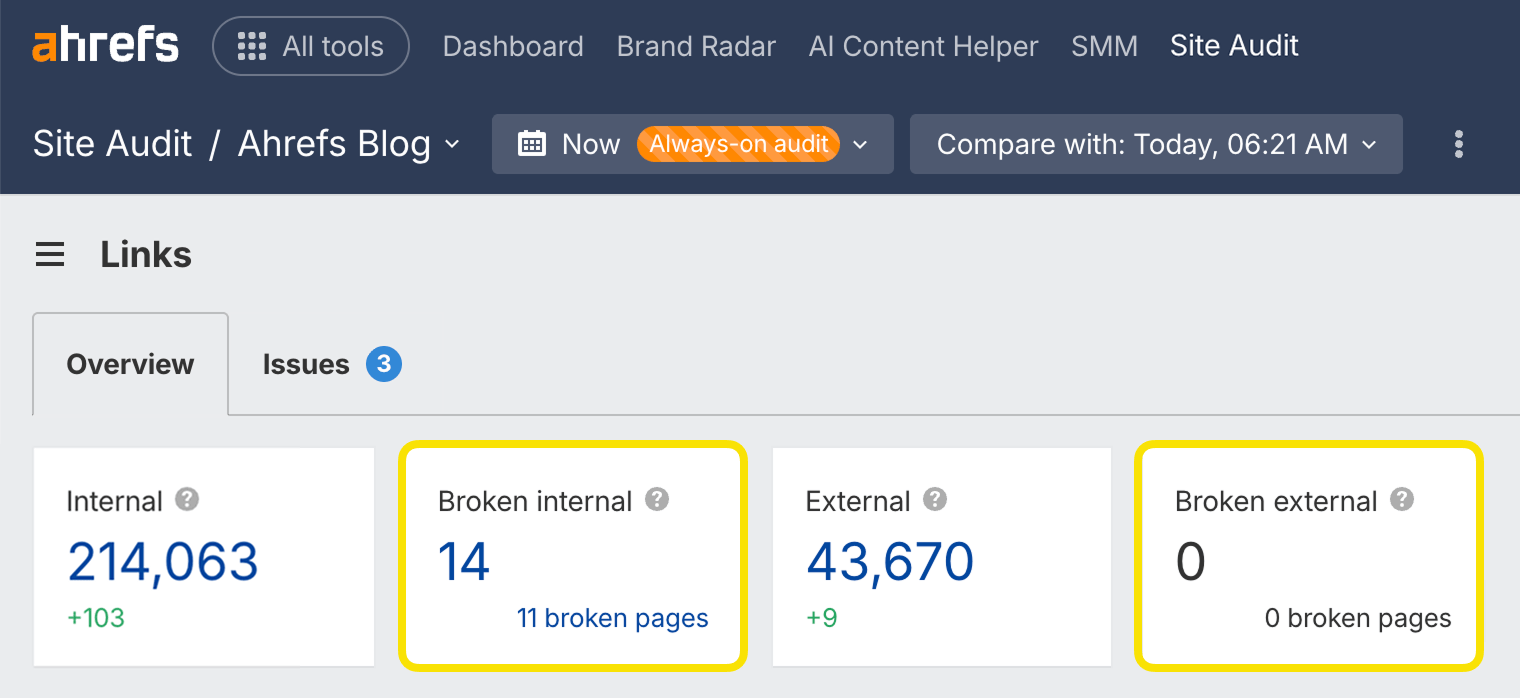

Defekte Links

Defekte Links sind Links auf deiner Website, die auf nicht existierende Ressourcen verweisen. Diese können entweder intern (d. h. auf andere Seiten deiner Domain) oder extern (d. h. auf Seiten anderer Domains) sein.

Du kannst Defekte Links auf deiner Website schnell mit Site Audit im Links-Report finden. Das ist kostenlos in Ahrefs Webmaster Tools.

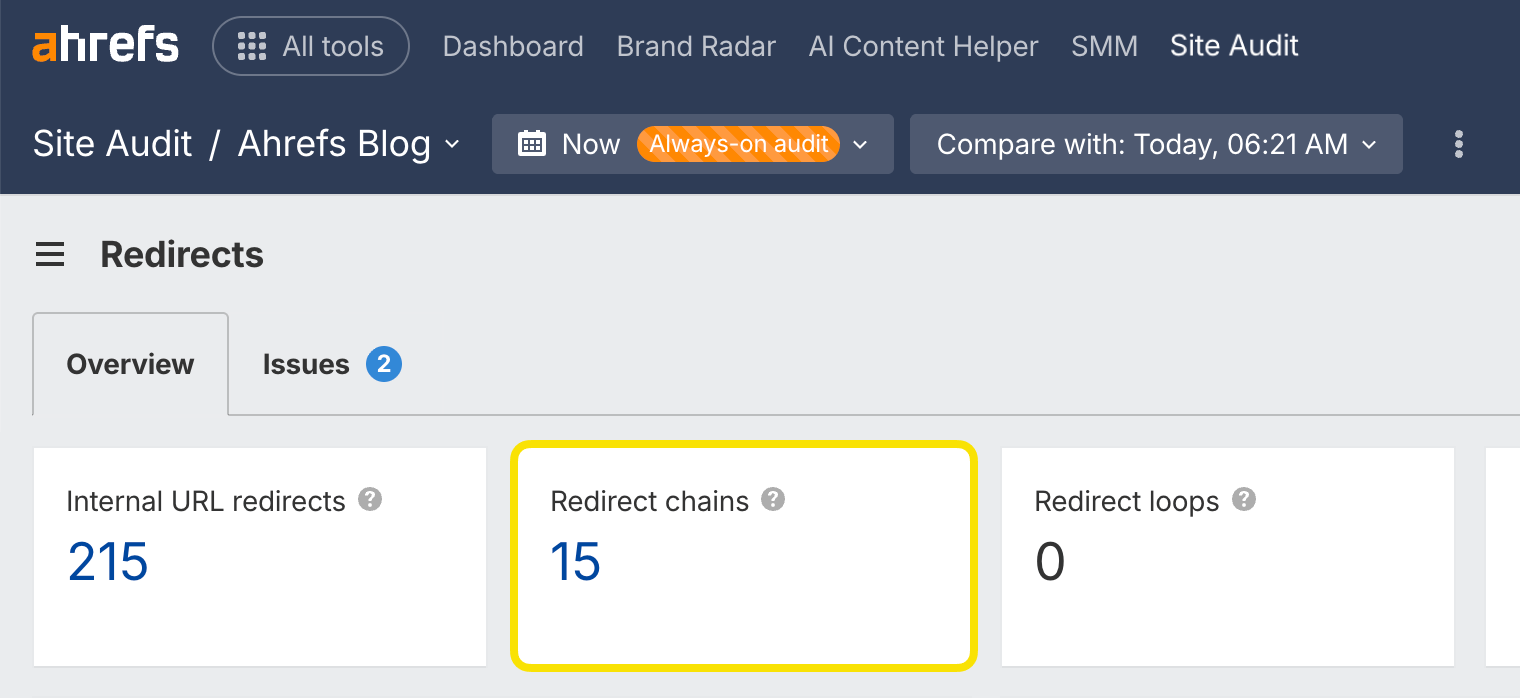

Weiterleitungsketten

Weiterleitungsketten sind eine Reihe von Weiterleitungen, die zwischen der ursprünglichen URL und der Ziel-URL stattfinden.

Du kannst Redirect-Ketten auf deiner Website schnell mit Site Audit im Report Redirects finden. Das ist kostenlos in Ahrefs Webmaster Tools.

Tools für technisches SEO

Diese Tools helfen dir, die technischen Aspekte deiner Website zu verbessern.

Google Search Console (früher Google Webmaster Tools) ist ein kostenloser Dienst von Google, der dir hilft, das Erscheinungsbild deiner Website in den Suchergebnissen zu überwachen und Probleme zu beheben.

Nutze es, um technische Fehler zu finden und zu beheben, Sitemaps einzureichen, Probleme mit strukturierten Daten zu sehen und mehr.

Bing und Yandex haben ihre eigenen Versionen, und Ahrefs auch. Ahrefs Webmaster Tools ist ein kostenloses Tool, das dir hilft, die SEO-Performance deiner Website zu verbessern. Damit kannst du:

- Überwache die SEO-Gesundheit deiner Website.

- Überprüfe mehr als 100 SEO-Probleme.

- Alle deine Backlinks anzeigen.

- Alle Keywords anzeigen, für die du rankst.

- Finde heraus, wie viel Traffic deine Seiten erhalten.

- Gelegenheiten für die interne Verlinkung finden.

Das ist unsere Antwort auf die Einschränkungen der Google Search Console.

Googles Mobile-Friendly Test prüft, wie leicht ein Besucher deine Seite auf einem Mobilgerät nutzen kann. Er identifiziert außerdem konkrete Probleme der mobilen Bedienbarkeit, etwa zu kleinen Text, die Verwendung inkompatibler Plugins und so weiter.

Der Mobile-Friendly Test zeigt, was Google sieht, wenn es die Seite crawlt. Du kannst auch den Rich-Suchergebnisse-Test nutzen, um den Content zu sehen, den Google auf Desktop- oder Mobilgeräten sieht.

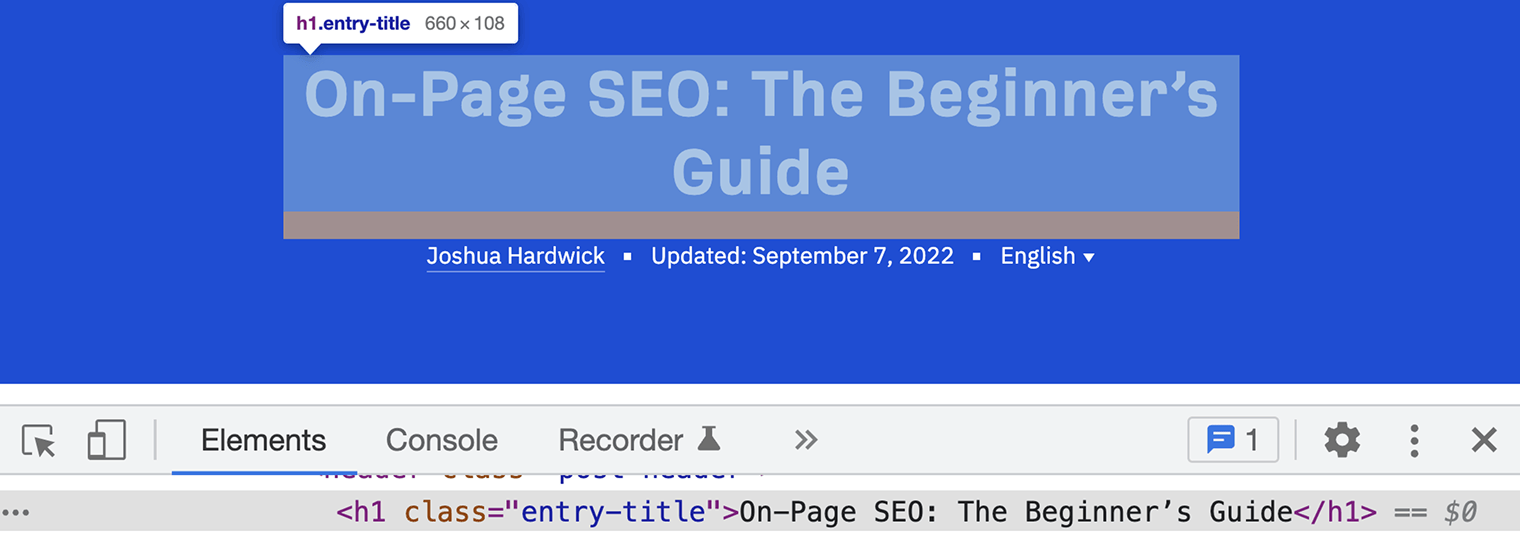

Chrome DevTools ist Chromes integriertes Debugging-Tool für Webseiten. Nutze es, um Probleme mit der Website-Geschwindigkeit zu debuggen, die Rendering-Performance von Webseiten zu verbessern und mehr.

Aus Sicht von technischem SEO hat es unendlich viele Einsatzmöglichkeiten.

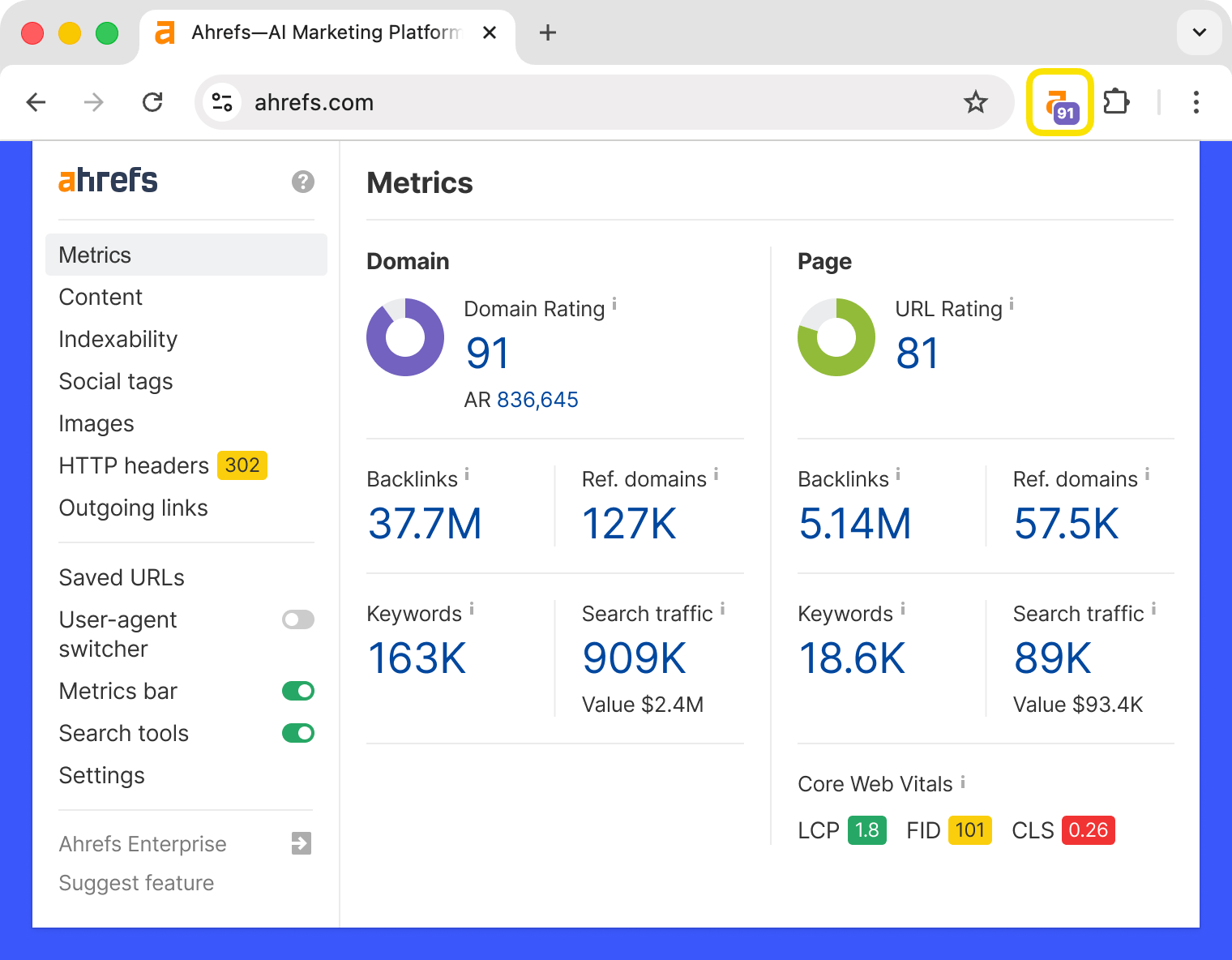

Ahrefs’ SEO Toolbar ist eine kostenlose Erweiterung für Chrome und Firefox, die nützliche SEO-Daten über die Seiten und Websites liefert, die du besuchst.

Die kostenlosen Funktionen sind:

- On-Page-SEO-Report

- Weiterleitungs-Tracker mit HTTP-Headern

- Prüffunktion für defekte Links

- Link-Highlighter

- SERP-Positionen

Außerdem erhältst du als Ahrefs-Nutzer:

- SEO-Metriken für jede Website und jede Seite, die du besuchst, sowie für die Google-Suchergebnisse

- Keyword-Kennzahlen wie Suchvolumen und Keyword-Schwierigkeit direkt in der SERP

- Export der SERP-Ergebnisse

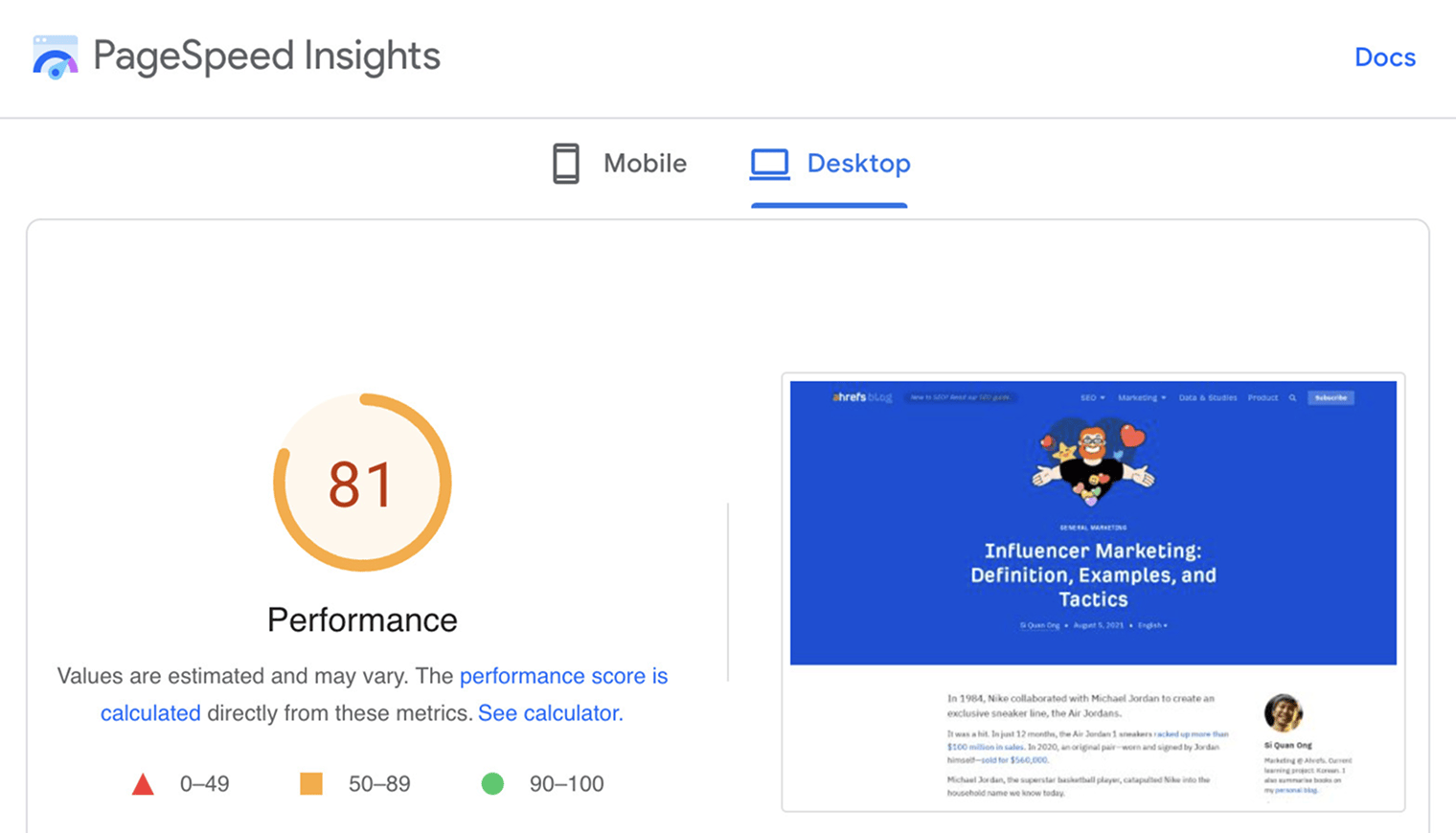

PageSpeed Insights analysiert die Ladegeschwindigkeit deiner Webseiten. Neben dem Performance-Score zeigt es auch umsetzbare Empfehlungen, um Seiten schneller laden zu lassen.

Wichtigste Erkenntnisse

- Wenn dein Inhalt nicht indexiert ist, wird er in Suchmaschinen nicht gefunden.

- Wenn etwas kaputt ist, das den Such-Traffic beeinträchtigt, kann es Priorität haben, es zu beheben. Aber für die meisten Websites ist es wahrscheinlich besser, Zeit in deine Inhalte und Links zu investieren.

- Viele der technischen Projekte mit der größten Wirkung drehen sich um Indexierung oder Links.

- Technisches SEO ist für die KI-Suche weiterhin wichtig. Gut strukturierte, crawlbare Seiten helfen KI-Systemen, deine Inhalte zu finden, zu verstehen und anzuzeigen.

Verweise

- „Is a crawl-delay rule ignored by Googlebot?“. Google Search Central. 21. Dezember 2017

- „Change Googlebot crawl rate“. Google. Abgerufen am 9. September 2022

- „30x-Weiterleitungen führen nicht mehr zu einem Verlust des PageRank“. Gary Illyes. 26. Juli 2016

Patrick Stox ist Product Advisor, Technisches SEO, & Brand Ambassador bei Ahrefs. Er war der Hauptautor für das SEO-Kapitel des Web Almanac 2021 und Reviewer für das SEO-Kapitel 2022. Außerdem hat er das „SEO Book For Beginners“ von Ahrefs mitverfasst und war Technical Review Editor für „The Art of SEO“, 4. Auflage. Er ist Organisator des Triangle SEO Meetup, der Konferenz Tech SEO Connect, betreibt eine Technisches-SEO-Slack-Gruppe und ist Moderator für /r/TechSEO auf Reddit.

SEO Schritt für Schritt meistern

So funktionieren Suchmaschinen

Wenn du SEO lernen willst, solltest du verstehen, wie Suchmaschinen funktionieren.

SEO-Grundlagen

Erfahre, wie du deine Website fit für die Suchmaschinenoptimierung machst, und mache dich mit den vier Grundpfeilern jeder SEO-Strategie vertraut.

Keyword-Recherche

Der Ausgangspunkt bei der SEO ist es, zu verstehen, wonach deine Zielkunden suchen.

SEO-Content

Lerne, wie du Content erstellst, der gut in Suchmaschinen rankt.

On-Page-SEO

Dabei optimierst du deine Seiten, damit Suchmaschinen sie besser verstehen.

Linkaufbau

Über Links entdecken Suchmaschinen weitere Seiten und schätzen deren „Autorität“ ein. Es ist schwierig, ohne Links für hart umkämpfte Suchbegriffe zu ranken.

Technisches SEO

Es ist wichtig sicherzustellen, dass du keine technischen Fehler begehst, die Google vom Zugriff oder Verstehen deiner Website abhalten könnten.

Local SEO

Erfahre, wie du deine Sichtbarkeit in lokalen Suchergebnissen verbessern und mehr Kunden aus deiner Umgebung gewinnen kannst.

Was KI für SEO bedeutet

Über SEO heute zu sprechen geht nicht ohne Erwähnung von generativer KI.