Zasil swój zespół najlepszym specjalistą ds. marketingu

Poradnik na temat technicznego SEO dla początkujących

Autor: Patrick Stox

Techniczne SEO w Ahrefs

Techniczne SEO jest najważniejszym elementem SEO… do pewnego stopnia. Aby mieć jakiekolwiek szansę na wysokie pozycjonowanie, strony muszą nadawać się do przeskanowania i zindeksowania przez roboty internetowe, jednak wiele innych działań technicznych będzie miało minimalny wpływ w porównaniu ze znaczeniem treści i linków.

Niniejszy przewodnik dla początkujących ma na celu pomóc Ci w zrozumieniu podstaw oraz wskazać, na co najlepiej przeznaczyć czas, aby zmaksymalizować wpływ.

Podstawy technicznego SEO

Czym jest techniczne SEO?

Techniczne SEO polega na zoptymalizowaniu Twojej strony w taki sposób, aby ułatwić wyszukiwarkom znalezienie, przeskanowanie, zrozumienie i zindeksowanie Twojej witryny. Pomaga poprawić widoczność i pozycjonowanie w wyszukiwarkach. Ma znaczenie także dla wyszukiwania AI.

Czy techniczne SEO jest bardzo skomplikowane?

To zależy. Podstawy nie są szczególnie trudne do opanowania, ale techniczne SEO może być złożone i trudne do zrozumienia. W tym przewodniku postaram się wyjaśnić te kwestie w tak prosty sposób, jak to tylko możliwe.

Czy techniczne SEO jest istotne dla wyszukiwania AI?

Tak. Wyszukiwanie AI nadal opiera się na stronach internetowych, które można zindeksować, są dobrze ustrukturyzowane i godne zaufania. Techniczne SEO odpowiada za to, że Twoja witryna jest szybka, dostępna i możliwa do zindeksowania, co zwiększa szanse na to, że Twoje treści będą wykorzystywane zarówno w odpowiedziach generowanych przez AI, jak i w tradycyjnym wyszukiwaniu.

Skanowanie witryn

W tym rozdziale wyjaśnimy, w jaki sposób upewnić się, że wyszukiwarki mogą efektywnie skanować Twoje treści.

Na czym polega skanowanie przez boty indeksujące

Indeksowanie polega na tym, że wyszukiwarki pobierają treści ze stron i używają znajdujących się na nich linków, aby odkrywać jeszcze więcej stron. Istnieje kilka sposobów, dzięki którym możesz kontrolować, co zostanie zindeksowane w Twojej witrynie. Poniżej przedstawiamy kilka opcji.

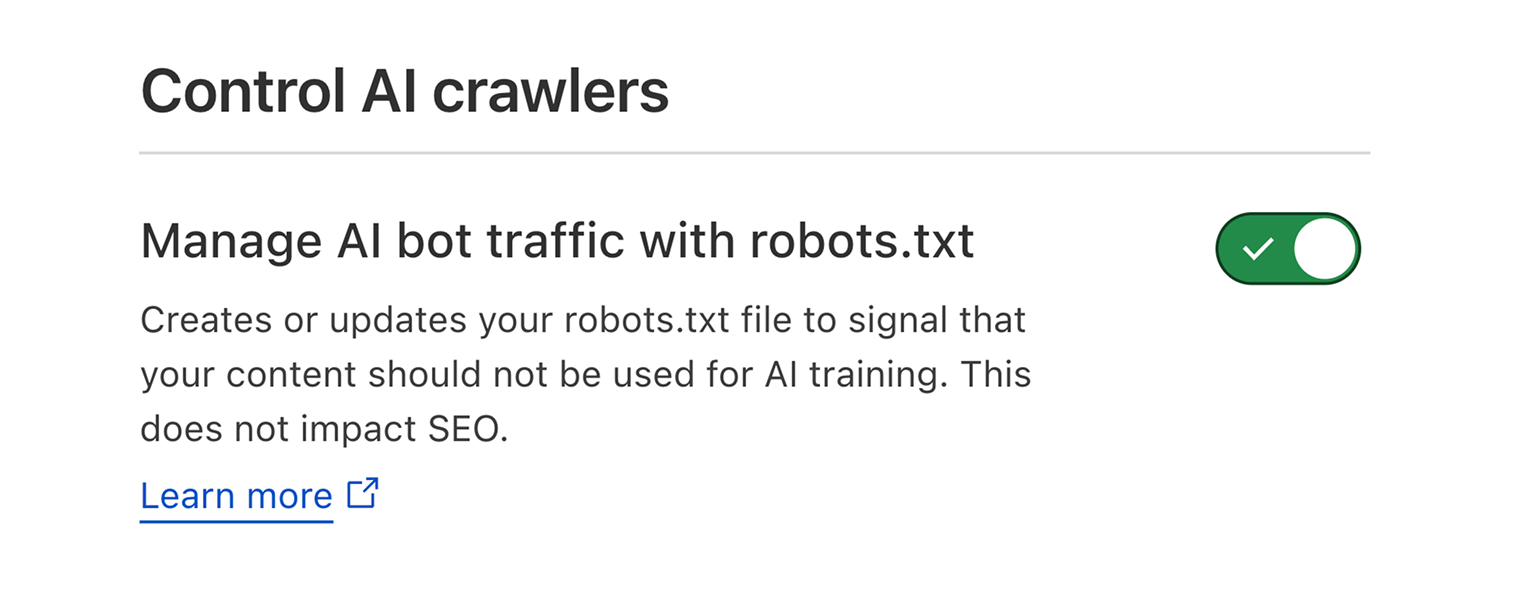

Plik robots.txt

Plik robots.txt wskazuje wyszukiwarkom i platformom AI, gdzie mogą, a gdzie nie mogą wchodzić w ramach Twojej witryny.

Większość wyszukiwarek i robotów internetowych AI stosuje się do ustawień zawartych w pliku robots.txt. Jeśli wyraźnie im tego zabronisz, podporządkują się i nie będą indeksować Twoich treści ani używać ich jako danych treningowych. Jednak blokując wyszukiwarkom i modelom językowym możliwość wykorzystywania Twojej strony jako materiału treningowego, ograniczasz też swoje szanse na uzyskanie widoczności w odpowiedziach generowanych przez te narzędzia.

Czy wiesz, że…

Google i niektóre modele językowe mogą indeksować strony z zablokowaną możliwością indeksowania przez roboty internetowe, jeśli prowadzą do nich linki. To może być dla Ciebie niezrozumiałe, ale jeśli chcesz zapobiec indeksowaniu stron, zapoznaj się z tym przewodnikiem i schematem blokowym, który przeprowadzi Cię przez ten proces.

Plik LLMs.txt

Plik LLMs.txt to dobrowolny standard służący do informowania dużych modeli językowych (LLM), w jaki sposób mogą wykorzystywać Twoje treści, ale jak już wyjaśniamy w naszym poradniku dotyczącym plików LLMs.txt, nie jest to szczególnie skuteczne i prawdopodobnie nie jest warte zachodu.

Jak dotąd nie ma dowodów na to, że plik LLMs.txt poprawia wyszukiwanie AI, napędza ruch lub poprawia dokładność modelu.

Częstotliwość indeksowania

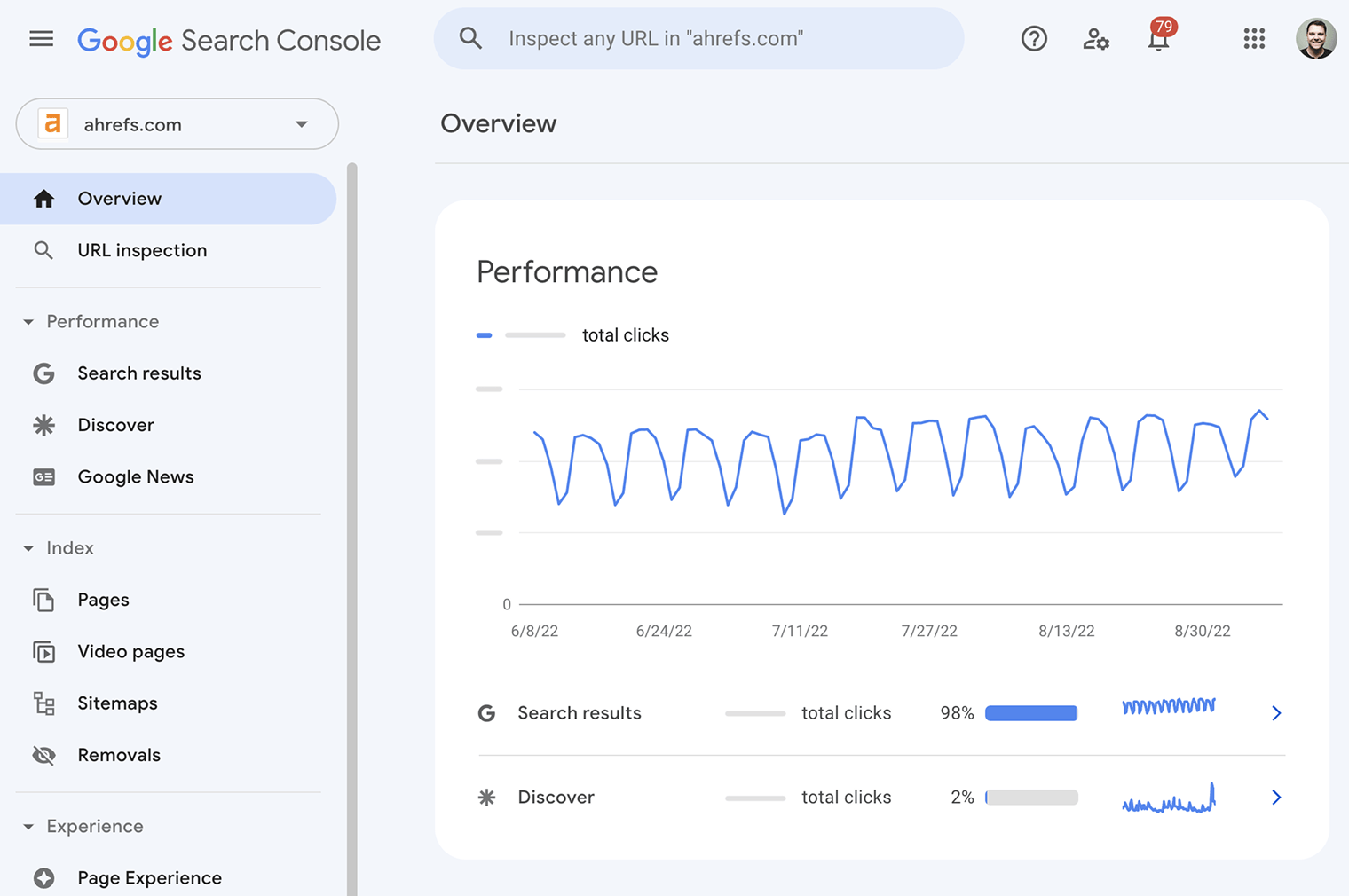

W pliku robots.txt możesz użyć polecenia crawl-delay obsługiwanego przez wiele robotów internetowych. Pozwala ono określić częstotliwość skanowania stron przez boty. Niestety Google go nie respektuje[1]. W przypadku Google częstotliwość indeksowania należy zmienić bezpośrednio w narzędziu Google Search Console[2].

Ograniczenia dostępu

Jeśli chcesz, aby strona była dostępna dla wybranych użytkowników, ale nie dla wyszukiwarek, najlepszym rozwiązaniem będzie jedna z trzech poniższych opcji:

- Jakiś rodzaj systemu logowania

- Uwierzytelnienie HTTP (w przypadku którego do uzyskania dostępu wymagane jest hasło)

- Biała lista adresów IP (która umożliwia dostęp do Twoich stron tylko z określonych adresów IP)

Tego typu konfiguracja najlepiej sprawdza się w przypadku np. sieci wewnętrznych, treści dostępnych wyłącznie dla członków, witryn stagingowych, testowych lub deweloperskich. Pozwala ona wybranej grupie osób na korzystanie z serwisu, jednocześnie uniemożliwiając wyszukiwarkom dostęp do stron i ich indeksowanie.

Jak sprawdzić aktywność robotów internetowych

W przypadku Google najprostszym sposobem na sprawdzenie, co jest skanowane, jest raport „Statystyki indeksowania” w Google Search Console, który dostarcza szczegółowych informacji o tym, jak boty poruszają się po Twojej witrynie.

Jeśli chcesz zobaczyć całą aktywność robotów internetowych w swojej witrynie, w tym pochodzącą od botów AI, musisz uzyskać dostęp do logów serwera i prawdopodobnie użyć narzędzia do ich analizy. Jest to nieco bardziej skomplikowane zadanie. Jeśli jednak Twój hosting ma panel sterowania, taki jak cPanel, prawdopodobnie masz dostęp do surowych logów i niektórych narzędzi do agregacji danych, takich jak AWstats i Webalizer.

Dostosowanie częstotliwości skanowania

Każda strona internetowa ma inny budżet indeksowania, który jest wypadkową tego, jak często Google chce skanować daną witrynę oraz na jak intensywne skanowanie pozwala sama witryna. Bardziej popularne strony oraz te, które są często aktualizowane, będą indeksowane częściej, natomiast strony, które są mniej popularne lub słabo podlinkowane, będą indeksowane rzadziej.

Jeśli roboty internetowe podczas skanowania Twojej witryny zauważą oznaki przeciążenia, zwykle zwolnią, a nawet całkowicie przerwą pracę do czasu poprawy wydajności witryny.

Gdy strony zostaną już zeskanowane, następuje ich renderowanie, a następnie trafiają one do indeksu. Indeks to główna lista wszystkich stron, które mogą zostać wyświetlone w odpowiedzi na zapytania użytkowników w wyszukiwarce. Porozmawiajmy teraz o samym indeksie.

Indeksowanie witryn

W tym rozdziale porozmawiamy o tym, jak upewnić się, że Twoje strony są zindeksowane, oraz jak sprawdzić sposób ich indeksowania.

Polecenia dla robotów

Znacznik meta robots to fragment kodu HTML, który wskazuje wyszukiwarkom, jak skanować lub indeksować daną stronę. Jest umieszczony w sekcji <head> strony internetowej i wygląda on następująco:

<meta name="robots" content="noindex" />

Kanonizacja

Gdy w witrynie występuje powielona treść tworząca wiele wersji tej samej strony, Google wybiera jedną z nich do przechowywania w swoim indeksie. Ten proces nosi nazwę kanonizacji, a adres URL wybrany jako kanoniczny będzie tym, który Google pokaże w wynikach wyszukiwania. Przy wyborze kanonicznego adresu URL Google wykorzystuje wiele różnych sygnałów, takich jak:

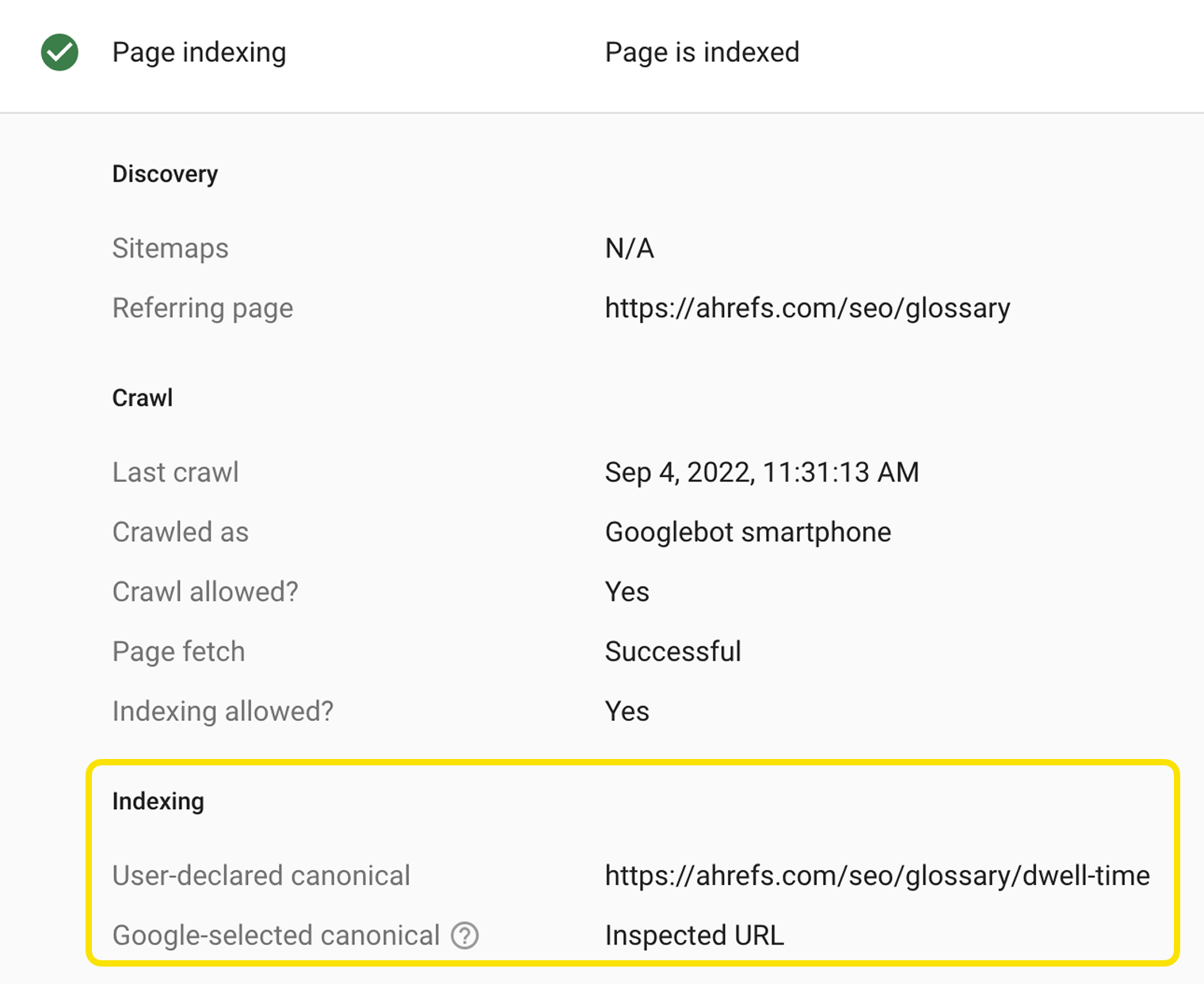

Najłatwiejszym sposobem na sprawdzenie, jak Google zindeksowało stronę, jest użycie narzędzia do sprawdzania adresów URL w Google Search Console. Pokaże ono wybrany przez Google kanoniczny adres URL.

Szybkie efekty technicznego SEO

Jedną z najtrudniejszych kwestii dla specjalistów ds. SEO jest ustalanie priorytetów. Opracowano wiele najlepszych praktyk, jednak niektóre modyfikacje będą mieć większy wpływ na Twoje pozycjonowanie i ruch niż inne. Oto kilka zadań, które warto zrealizować w pierwszej kolejności.

Sprawdź indeksowanie

Upewnij się, że strony, które mają być odnajdywane przez użytkowników, mogą zostać zindeksowane przez Google. Nie bez powodu dwa poprzednie rozdziały poświęciliśmy właśnie zagadnieniom skanowania i indeksowania.

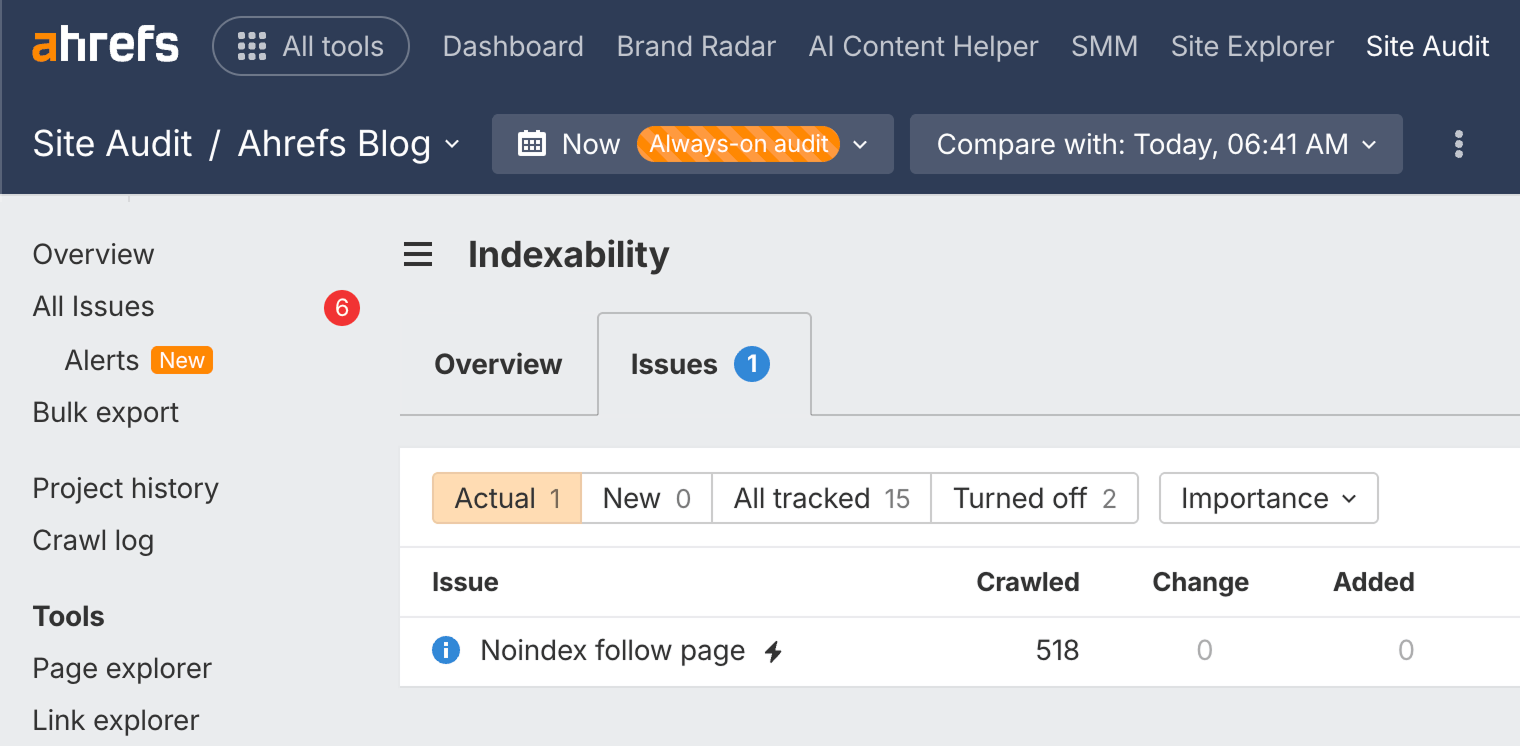

Aby znaleźć strony, których nie da się zindeksować, a także przyczyny tego stanu rzeczy, warto sprawdzić raport Indexability (Możliwość indeksowania) w narzędziu Site Audit. Jest dostępny w ramach Ahrefs Free.

Uruchom bezpłatny audyt strony pod kątem technicznego SEO

Rejestrując się tutaj, uzyskujesz dostęp do platformy Ahrefs Free ↗

Odzyskaj utracone linki

Witryny internetowe z biegiem lat często zmieniają swoje adresy URL. W wielu przypadkach te stare adresy URL mają linki prowadzące z innych stron. Jeśli nie zostaną one przekierowane na aktualne strony, ich siła zostaje utracona i nie będzie już sprzyjać pozycjonowaniu Twojej witryny. Nigdy nie jest za późno na wdrożenie tych przekierowań, dzięki czemu możesz szybko odzyskać utraconą wartość. Uznaj to za najszybszy sposób budowania linków, jaki kiedykolwiek uda Ci się przeprowadzić.

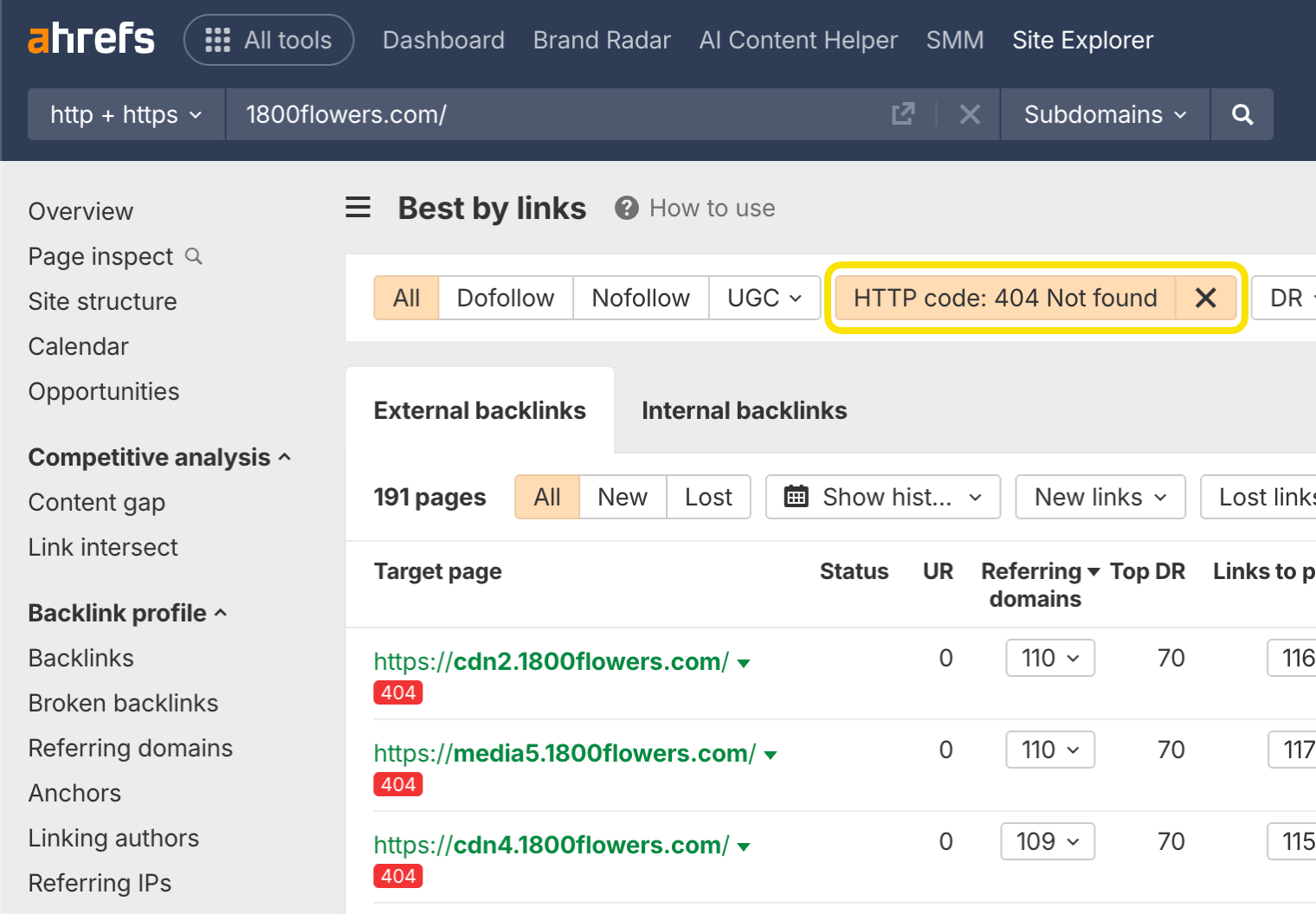

Możliwości odzyskania utraconych linków można sprawdzić za pomocą narzędzia Site Explorer firmy Ahrefs. Wpisz swoją domenę, przejdź do raportu Najlepsze według linków i zastosuj filtr odpowiedzi HTTP, który wyświetli strony zwracające komunikat „Błąd 404. Nie znaleziono strony”. Zwykle sortuję te wyniki według kolumny „Domeny odsyłające”.

Tak wygląda to w przypadku domeny 1800flowers.com:

Sprawdzając pierwszy z brzegu adres URL w archive.org, widzę, że wcześniej była to strona z okazji Dnia Matki. Przekierowując tę jedną konkretną stronę na jej aktualną wersję, odzyskasz 225 linków z 59 różnych witryn – a takich możliwości jest znacznie więcej.

Stworzyłem nawet skrypt, który pomoże Ci dopasować przekierowania. Bez obaw: wystarczy tylko pobrać kilka plików i je przesłać. Ten notatnik Google Colab przeprowadzi Cię przez cały proces i wykona za Ciebie najtrudniejszą robotę.

Aby odzyskać utraconą wartość, należy zastosować przekierowanie 301 ze wszystkich starych adresów URL do ich aktualnych lokalizacji.

Czy wiesz, że…

Przekierowanie 301 to przekierowanie na stałe. Z perspektywy Google wszystkie linki prowadzące do przekierowanego adresu URL będą zaliczane na konto nowego adresu[3].

Dodaj linki wewnętrzne

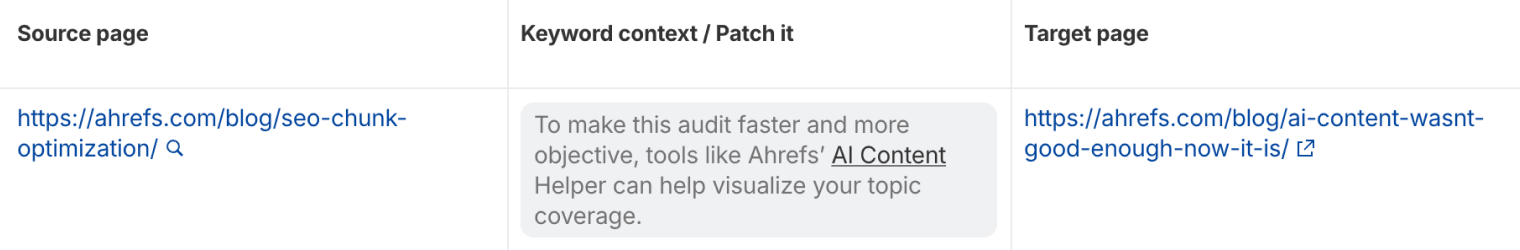

Linki wewnętrzne to odnośniki prowadzące z jednej podstrony na inną w obrębie tej samej witryny. Pomagają one odnajdywać Twoje treści, a także poprawiają pozycjonowanie stron. W narzędziu Site Audit znajdziesz funkcję o nazwie Internal Link Opportunities (Okazje do linkowania wewnętrznego), która pomaga szybko zlokalizować takie możliwości.

Działanie tej funkcji opiera się na wyszukiwaniu wzmianek słów kluczowych, na które Twoja witryna już się pozycjonuje. Następnie narzędzie sugeruje te miejsca jako odpowiednie na kontekstowe linki wewnętrzne.

Przykład: narzędzie pokazuje wzmiankę o „nawigacji fasetowej” w naszym poradniku dotyczącym zduplikowanych treści. Ponieważ narzędzie Site Audit wie, że mamy osobną stronę poświęconą nawigacji fasetowej, sugeruje dodanie linku wewnętrznego właśnie do tej strony.

Dodaj znacznik schematu (schema markup)

Znacznik schematu to kod, który pomaga wyszukiwarkom lepiej rozumieć Twoje treści. Wspiera on również wiele funkcji, dzięki którym Twoja strona może wyróżnić się w wynikach wyszukiwania. Może on także pomóc dużym modelom językowym poprawnie interpretować treść Twojej strony. Google udostępnia galerię funkcji dostępnych w wynikach wyszukiwania, która pokazuje różne funkcje wspierane przez wyszukiwarkę oraz typy danych strukturalnych wymaganych, aby Twoja witryna mogła pojawić się w tych funkcjach.

Techniczne SEO na potrzeby widoczności w wyszukiwaniach AI

Sztuczna inteligencja zmieniła sposób, w jaki treści są znajdowane i wyświetlane osobom wyszukującym, jednak podstawą jej działania nadal są strony internetowe, które można indeksować, są dobrze ustrukturyzowane i godne zaufania. AI przeobraża także sposób tworzenia i optymalizowania treści.

Zwrócenie uwagi na kilka konkretnych czynników technicznych związanych z AI może pomóc Ci zachować widoczność wszędzie tam, gdzie ludzie szukają informacji.

Zadbaj o dostępność Twojej witryny dla dużych modeli językowych

Podobnie jak wyszukiwarki, duże modele językowe muszą mieć możliwość przeskanowania Twojej strony oraz dostęp do jej treści. Jednak działają one nieco inaczej niż roboty internetowe wyszukiwarek.

Na przykład większość modeli językowych nie renderuje języka JavaScript – popularnego języka programowania używanego do tworzenia stron. Jeśli kluczowe treści lub nawigacja pojawiają się dopiero po załadowaniu JS, istnieje ryzyko, że niektóre roboty internetowe AI nie zobaczą tych treści. Dlatego najlepiej unikać używania tego języka w przypadku wszelkich krytycznych treści, które powinny być widoczne w wyszukiwaniu AI.

Warto też sprawdzić, czy narzędzia firm trzecich nie blokują robotom internetowym AI dostępu do Twojej strony.

Na przykład Cloudflare wprowadził nowe funkcje, które pozwalają właścicielom witryn kontrolować, czy platformy AI mogą pobierać treści do swoich zbiorów danych szkoleniowych.

Ustawienie domyślne blokuje boty AI przed dostępem do treści. Musisz jednak wyłączyć tę blokadę, jeśli chcesz, aby Twoje treści miały maksymalną widoczność w wynikach wyszukiwania AI.

Przekieruj adresy URL będące wytworem halucynacji

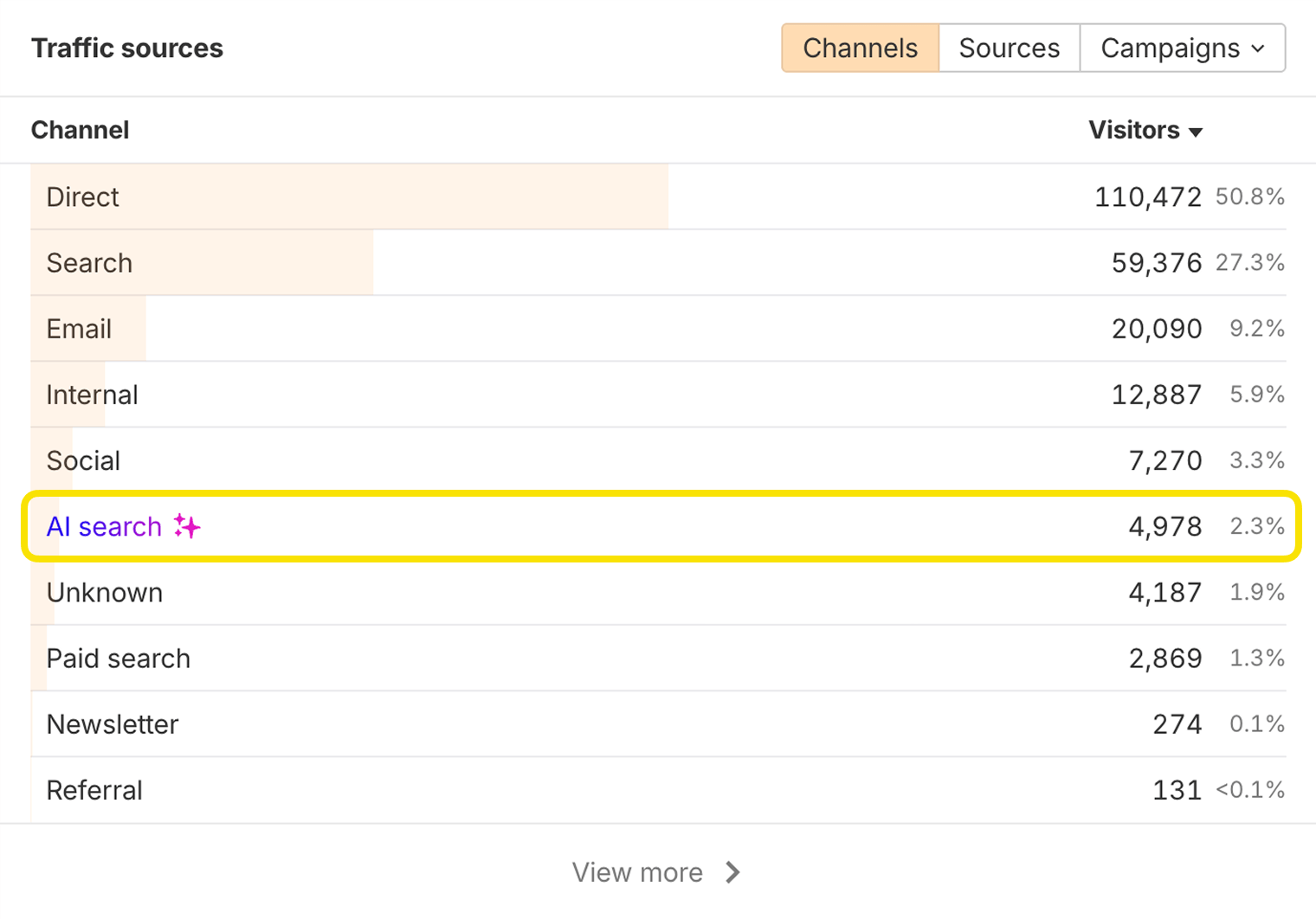

Systemy wyszukiwania AI mogą cytować nieistniejące adresy URL w Twojej domenie. Możesz znaleźć je w narzędziu Web Analytics firmy Ahrefs, sprawdzając strony, które otrzymują ruch z wyszukiwania AI:

Jeśli którakolwiek z tych stron zwraca błąd 404, oznacza to, że system AI mógł wygenerować adres URL, który jest wytworem halucynacji. Aby nie tracić ruchu, możesz przekierować taki adres URL na odpowiednią, działającą stronę w Twojej witrynie.

Regularne monitorowanie takich przypadków zapobiega frustracji użytkowników i chroni autorytet Twojej marki.

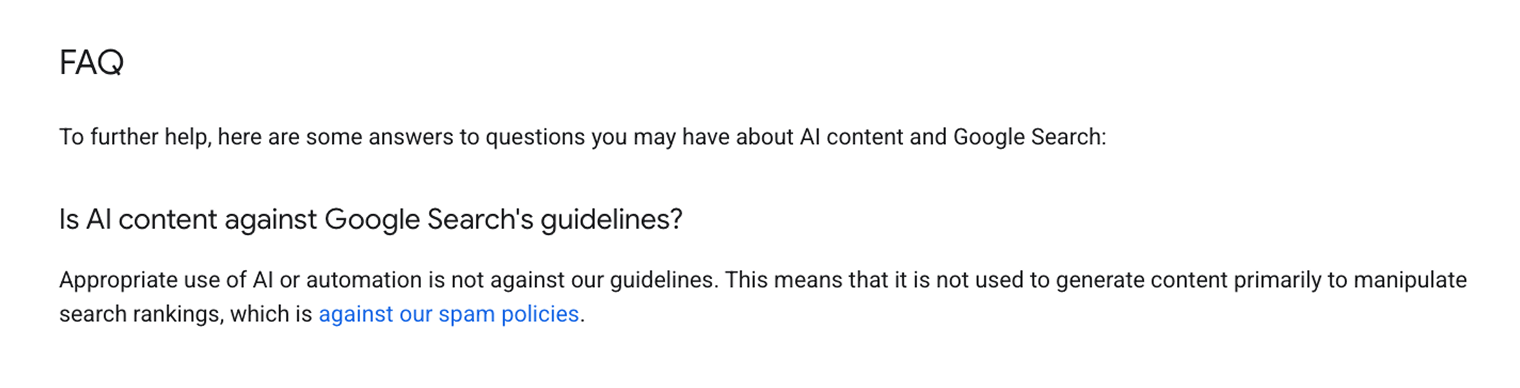

Wykrywanie treści wygenerowanych przez AI

Choć nie ma nic złego w korzystaniu z AI do tworzenia treści na stronie, zbyt duża ilość materiałów wygenerowanych automatycznie może być postrzegana jako oznaka spamu. A to z kolei może spowodować ograniczenie widoczności Twoich treści w tradycyjnych wyszukiwarkach oraz systemach wyszukiwania AI.

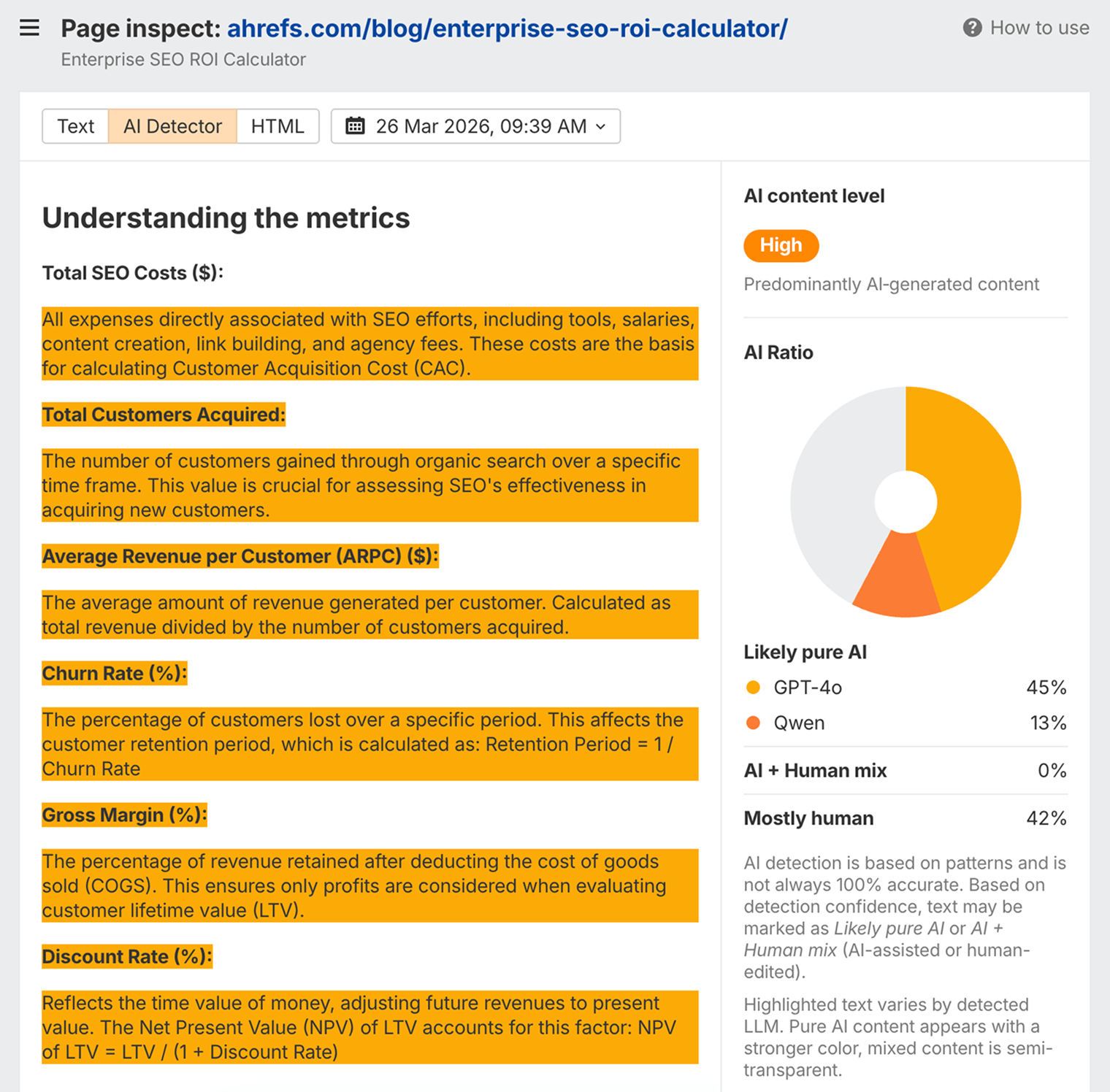

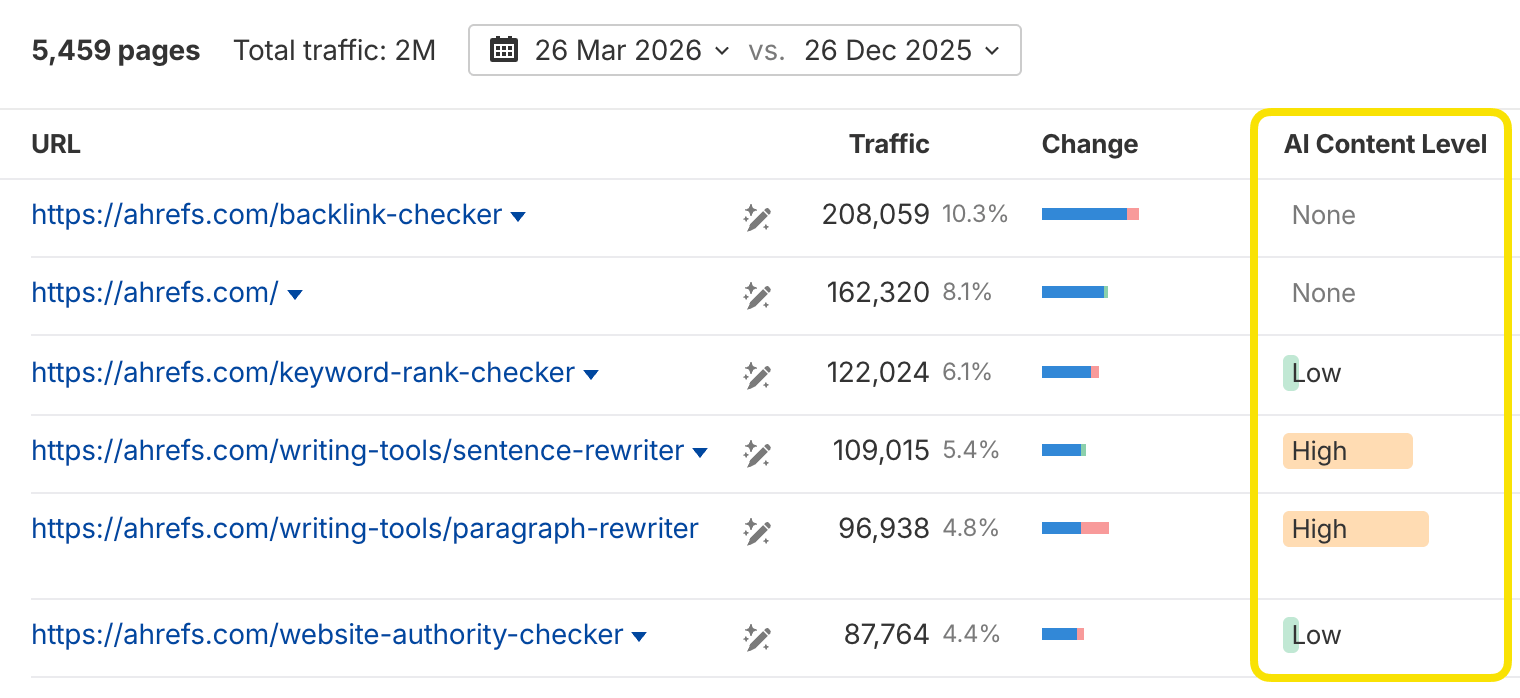

Aby sprawdzić, jak algorytmy mogą interpretować stopień wykorzystania sztucznej inteligencji w Twoich treściach, możesz skorzystać z funkcji wykrywania treści AI, przechodząc do narzędzia Site Explorer > Page Inspect.

Możesz też sprawdzić te metryki zbiorczo w raporcie Najlepsze strony, aby wyłapać strony, które mogą wymagać przeredagowania:

Kod wstrzyknięty przez narzędzia AI

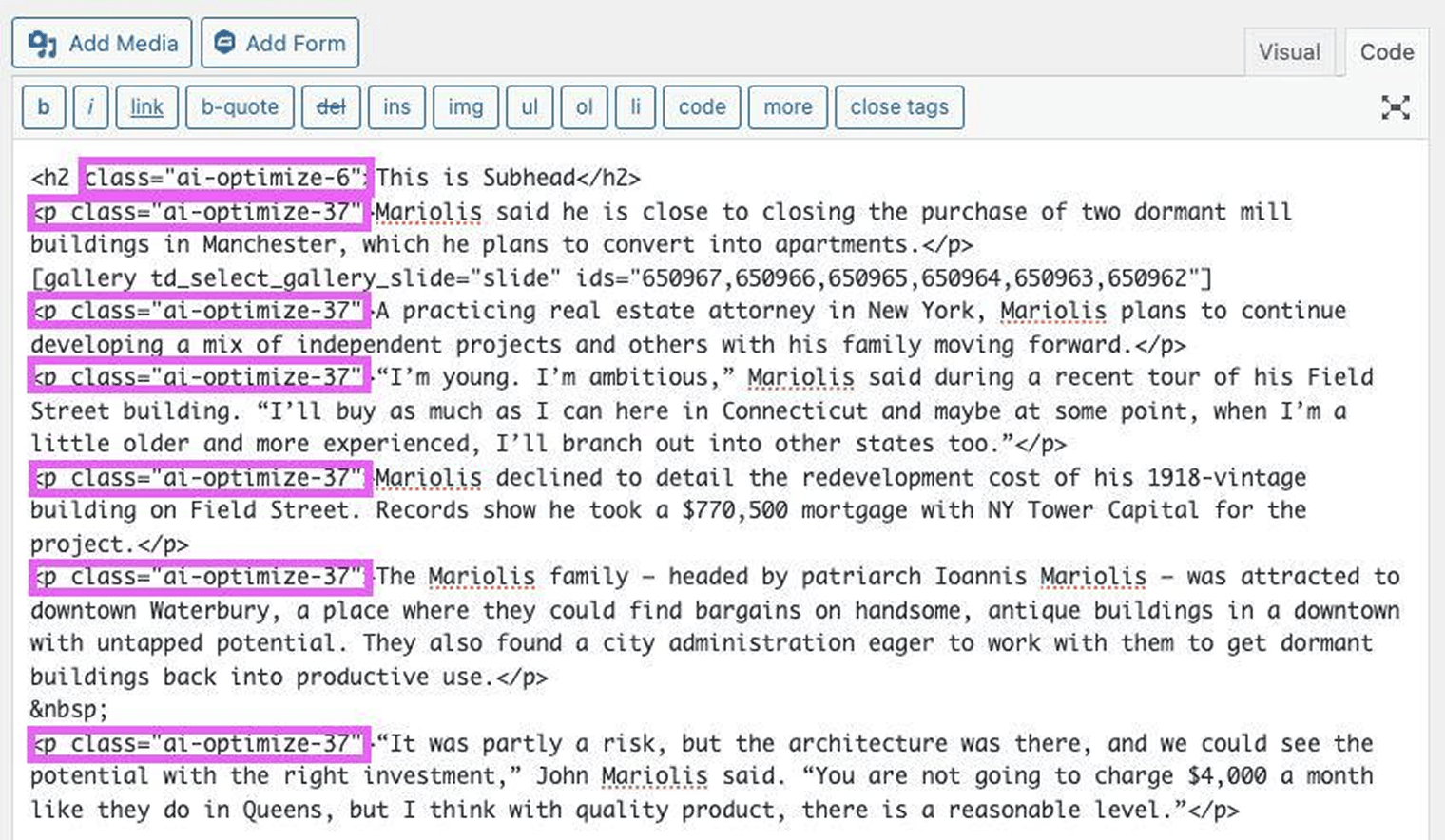

Jeśli przy budowie strony lub dodawaniu do niej nowych funkcji korzystano z pomocy sztucznej inteligencji, narzędzia te mogły dodać nadmiarowy kod HTML, który ujawnia użycie AI.

Zdarzyło się na przykład, że błąd wtyczki Yoast SEO powodował wstawianie do stron ukrytych klas powiązanych z AI, przez co dla wyszukiwarek było oczywiste, iż w proces tworzenia zaangażowana była sztuczna inteligencja.

Jeśli używasz narzędzi AI do wprowadzania zmian na stronie, sprawdź kod źródłowy witryny, aby upewnić się, że nie dodano tam niechcianych fragmentów. Ukrytych „odcisków palców” tego typu można uniknąć dzięki regularnym przeglądom kodu oraz przeprowadzaniu testów przed publikacją aktualizacji.

Dodatkowe zadania w obszarze technicznego SEO

Zadania, o których opowiemy w tym rozdziale, są warte uwagi, jednak mogą wymagać więcej pracy i przynosić mniejsze korzyści niż „szybkie efekty” przedstawione w poprzedniej części. Nie oznacza to jednak, że nie należy się nimi zajmować. Ten podział ma jedynie ułatwić Ci zrozumienie, w jaki sposób ustalać priorytety poszczególnych działań.

Sygnały dotyczące doświadczenia użytkownika na stronie

To czynniki o mniejszym znaczeniu dla pozycjonowania, ale którymi i tak warto się zająć ze względu na dobro użytkowników. Obejmują one te aspekty witryny, które wpływają na doświadczenie użytkownika (UX).

Sygnały wyszukiwarki Google dotyczące doświadczenia użytkowników na stronie

https://ahrefs.com/blog/core-web-vitals/

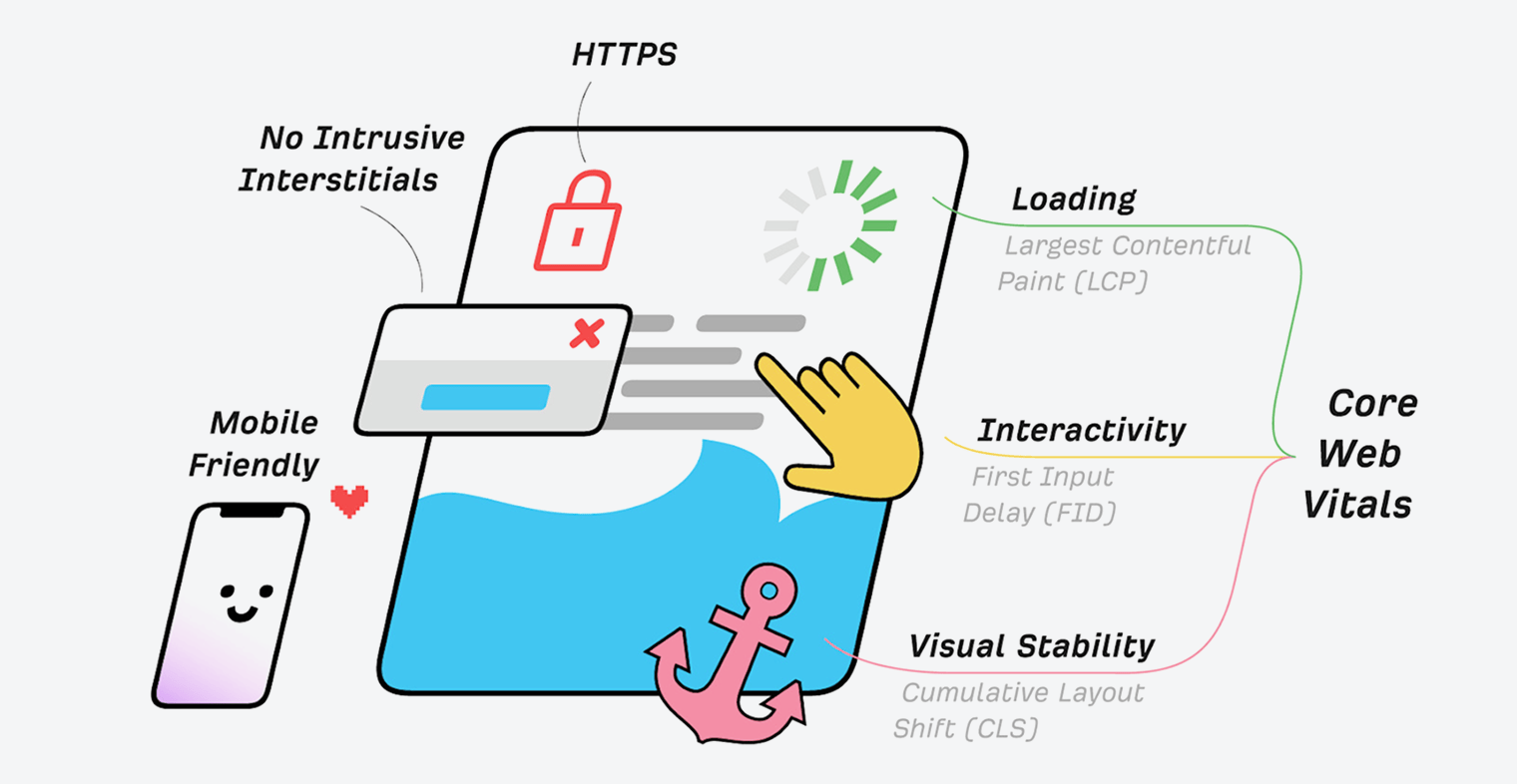

Podstawowe wskaźniki internetowe (Core Web Vitals)

Core Web Vitals to wskaźniki szybkości, które są jednymi z sygnałów Google dotyczących jakości strony (Page Experience), służącymi do pomiaru doświadczenia użytkownika. Wskaźniki te mierzą: czas ładowania widocznej treści za pomocą metryki LCP – Largest Contentful Paint (czas ładowania największego elementu); stabilność wizualną za pomocą metryki CLS – Cumulative Layout Shift (skumulowane przesunięcie układu); a także interaktywność za pomocą metryki FID – First Input Delay (opóźnienie przy pierwszym działaniu).

Protokół HTTPS

HTTPS chroni komunikację między Twoją przeglądarką a serwerem przed przechwyceniem i ingerencją przez atakujących. Zapewnia on poufność, integralność i uwierzytelnianie dla zdecydowanej większości dzisiejszego ruchu w sieci WWW. Ważne jest, aby Twoje strony ładowały się przez protokół HTTPS, a nie HTTP.

Każda strona internetowa, która wyświetla ikonkę kłódki na pasku adresu, korzysta z protokołu HTTPS.

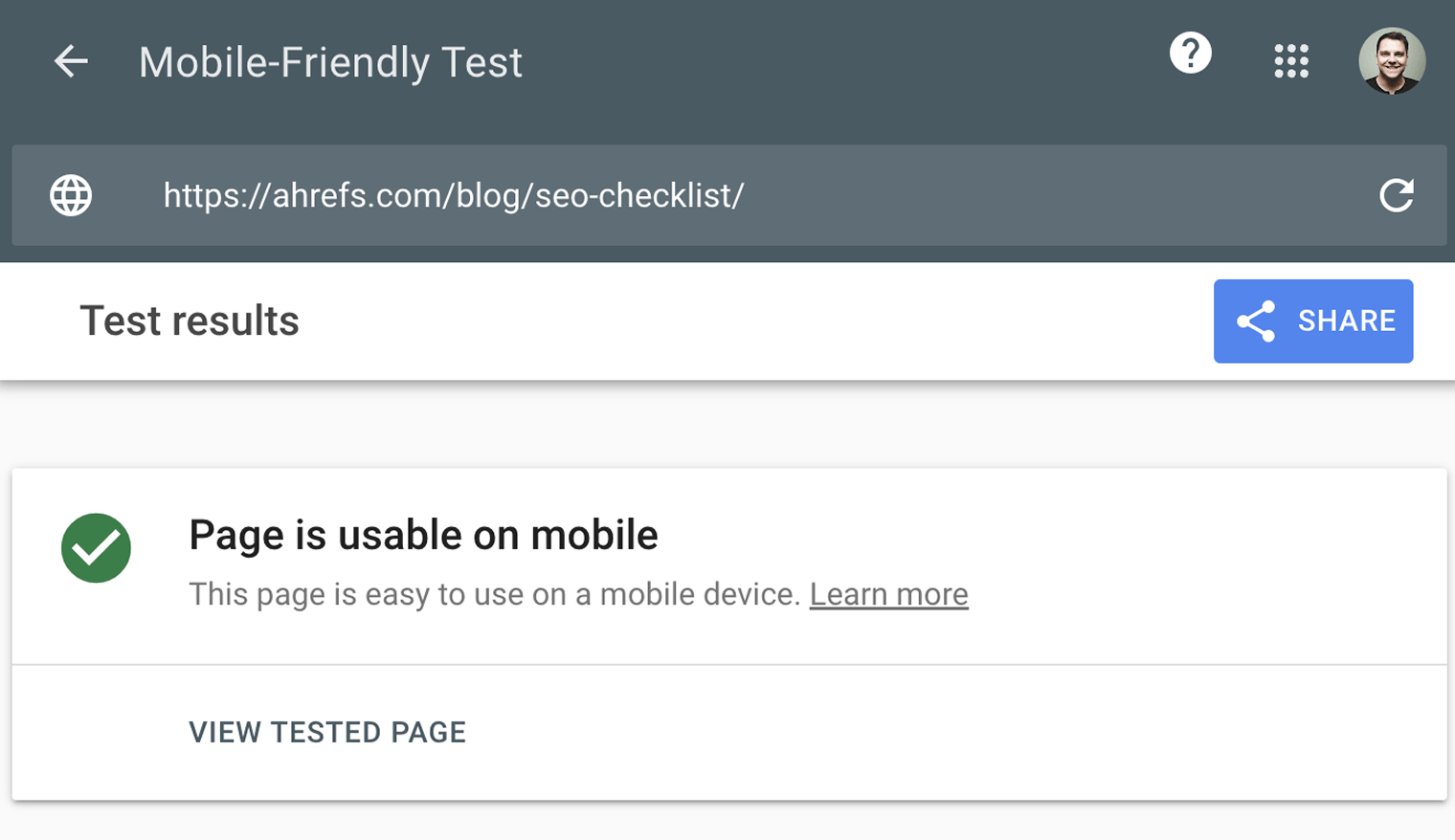

Dostosowanie do urządzeń mobilnych

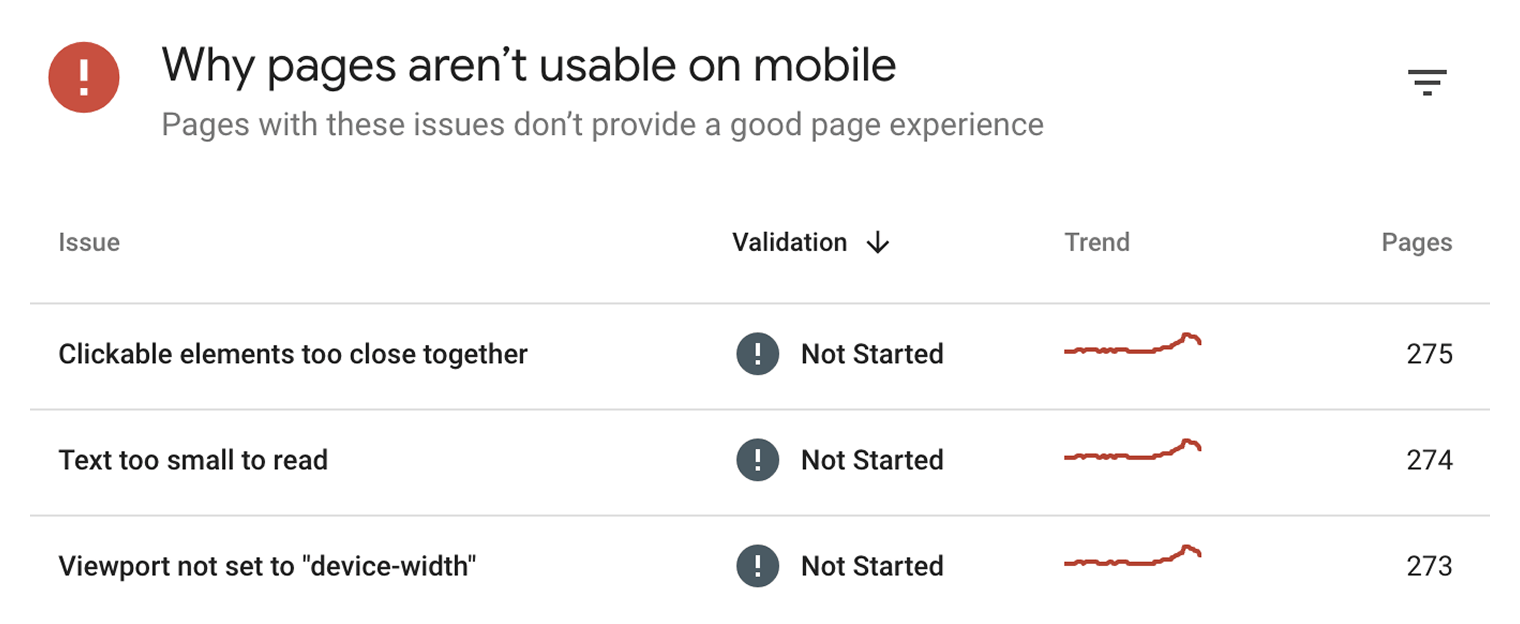

Mówiąc prosto, wskaźnik ten sprawdza, czy strony internetowe wyświetlają się poprawnie i czy mogą być łatwo obsługiwane na urządzeniach mobilnych.

Jak sprawdzić, w jakim stopniu Twoja witryna jest dostosowana do urządzeń mobilnych? Zobacz raport „Obsługa na urządzeniach mobilnych” w Google Search Console.

Raport ten informuje Cię, czy któraś z Twoich stron ma problemy dotyczące dostosowania do urządzeń mobilnych.

Reklamy pełnoekranowe (interstitiale)

Reklamy pełnoekranowe (interstitiale) blokują wyświetlanie treści. Chodzi o wyskakujące okienka, które zakrywają główną treść i z którymi użytkownicy często muszą wejść w interakcję, zanim reklamy te znikną.

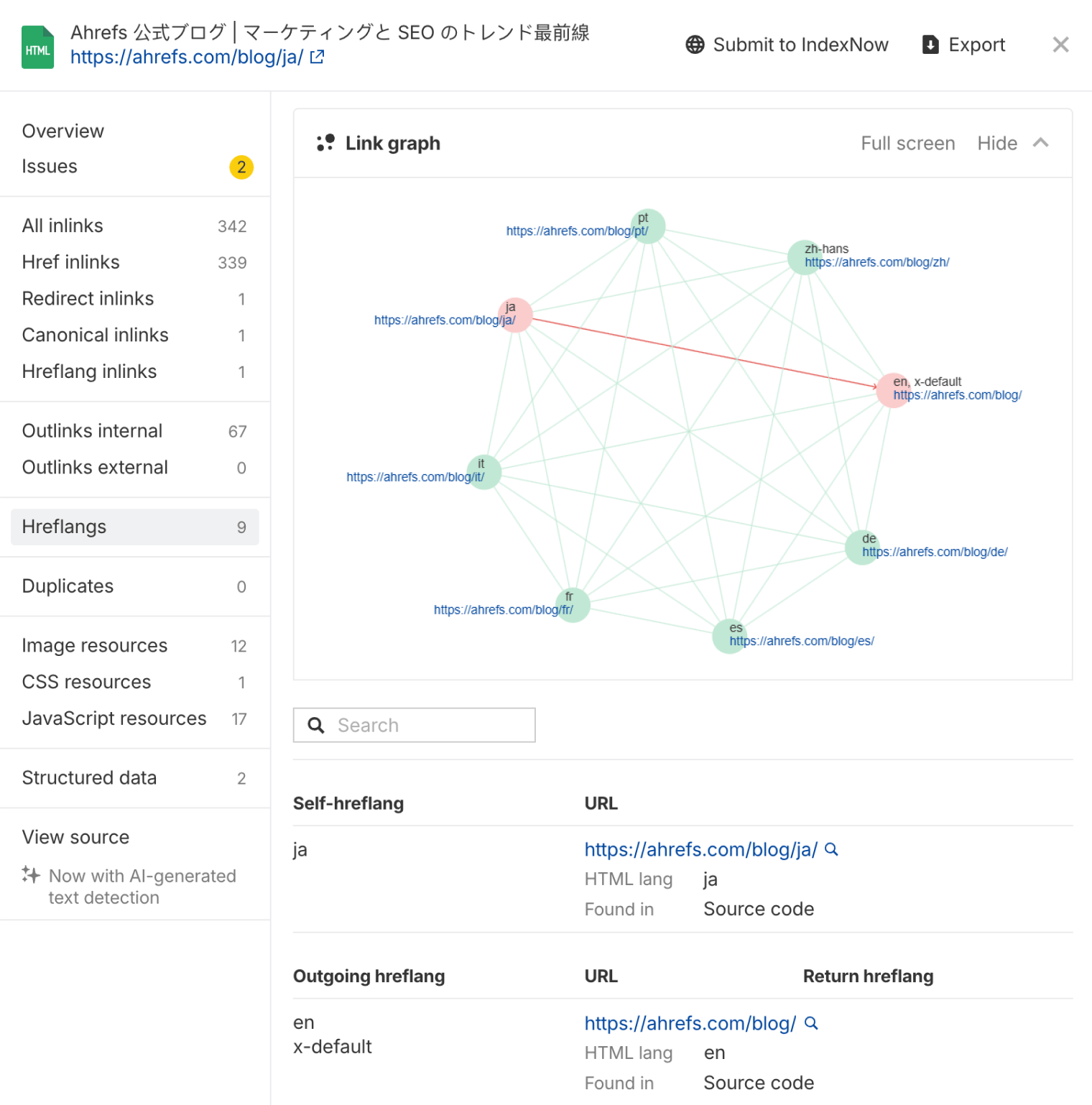

Hreflang — w przypadku wielu wersji językowych

Hreflang to atrybut HTML służący do określania języka oraz kierowania geograficznego danej strony internetowej. Jeśli masz wiele wersji tej samej strony w różnych językach, możesz użyć tagu hreflang, aby poinformować wyszukiwarki (np. Google) o tych wariantach. Dzięki temu mogą wyświetlać użytkownikom właściwą wersję.

Dzięki Ahrefs teraz wdrażanie atrybutów hreflang jest łatwiejsze za sprawą wizualnego wykresu powiązań w narzędziu Site Audit.

Ten wykres hreflang pokazuje wszystkie warianty językowe danej strony i podświetla wszelkie problemy z konfiguracją. Dodatkowo oznacza błędy – takie jak nieprawidłowe kody języków, brak linków zwrotnych do tej samej strony (self-links) oraz brak wzajemnych powiązań między tagami (reciprocal tags) – jednocześnie dając jasne wskazówki, jak je naprawić.

Ogólne utrzymanie i stan techniczny strony

Te zadania raczej nie będą miały dużego wpływu na Twoje pozycjonowanie, ale ogólnie warto je wykonać, aby zapewnić lepsze doświadczenia użytkownika.

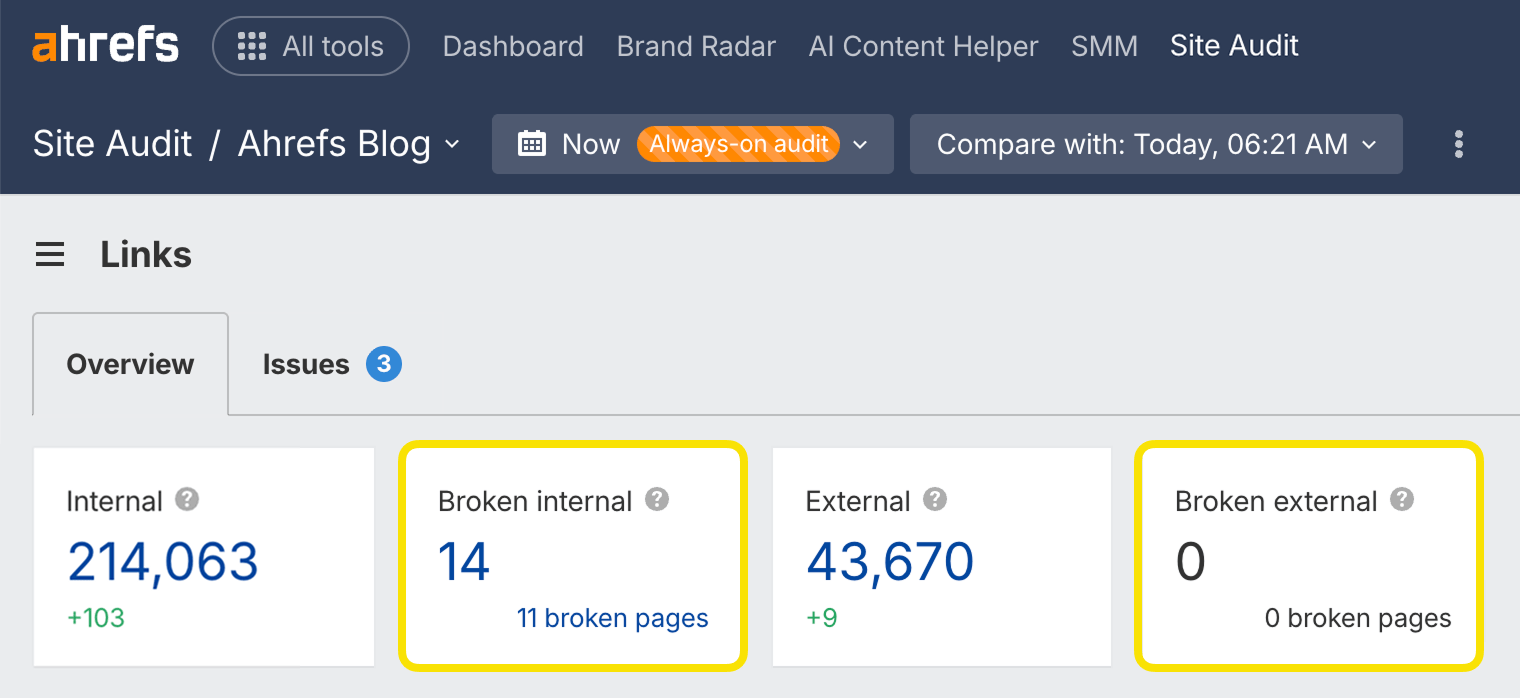

Uszkodzone linki

Uszkodzone linki to linki w Twojej witrynie, które prowadzą do nieistniejących zasobów. Mogą to być linki wewnętrzne (tj. odsyłające do innych stron w Twojej domenie) lub zewnętrzne (tj. prowadzące do stron w innych domenach).

Uszkodzone linki w Twojej witrynie można szybko znaleźć za pomocą raportu Linki w narzędziu Site Audit. Jest ono dostępne w ramach Ahrefs Free.

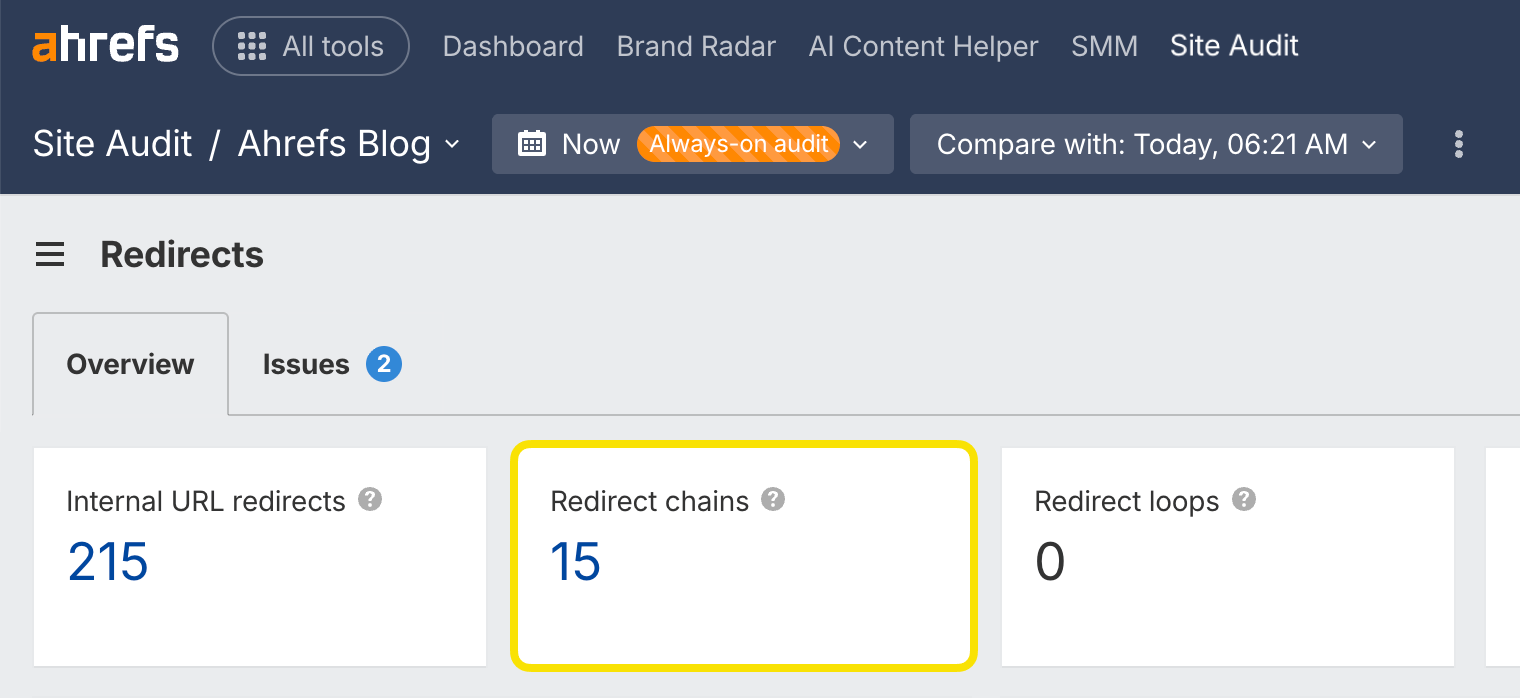

Łańcuchy przekierowań

Łańcuchy przekierowań to seria przekierowań, które następują między początkowym adresem URL a docelowym adresem URL.

Aby szybko znaleźć łańcuchy przekierowań na swojej stronie, możesz skorzystać z raportu Przekierowania w narzędziu Site Audit. Jest ono dostępne w ramach Ahrefs Free.

Przydatne narzędzia w obszarze technicznego SEO

Te narzędzia pomogą Ci usprawnić techniczne aspekty Twojej witryny.

Google Search Console (dawniej Google Webmaster Tools) to bezpłatna usługa Google, która pomaga monitorować i rozwiązywać problemy związane z wyświetlaniem Twojej strony w wynikach wyszukiwania.

Używaj jej do wykrywania i naprawiania błędów technicznych, przesyłania map witryn, sprawdzania problemów z danymi strukturalnymi oraz wielu innych zadań.

Wyszukiwarki Bing i Yandex mają własne wersje tego narzędzia, podobnie jak Ahrefs. Ahrefs Free pomoże Ci poprawić skuteczność SEO Twojej strony. Umożliwia ono:

- Monitorowanie stanu technicznego SEO Twojej strony.

- Sprawdzanie ponad 100 problemów związanych z SEO.

- Przeglądanie wszystkich Twoich linków zwrotnych.

- Sprawdzanie wszystkich słów kluczowych, na które pozycjonuje się Twoja strona.

- Sprawdzenie, jak duży ruch generują Twoje podstrony.

- Wyszukiwanie odpowiednich miejsc dla linków wewnętrznych.

To nasza odpowiedź na ograniczenia Google Search Console.

Test Google dotyczący optymalizacji pod kątem urządzeń mobilnych sprawdza, jak łatwo można korzystać z Twojej strony na urządzeniu mobilnym. Identyfikuje też konkretne problemy dotyczące użyteczności na urządzeniach mobilnych, np. tekst napisany zbyt małą czcionką, użycie niekompatybilnych wtyczek itp.

Test optymalizacji pod kątem urządzeń mobilnych pokazuje to, co widzi Google, gdy skanuje stronę. Możesz też użyć testu wyników rozszerzonych (Rich Results Test), aby sprawdzić, jak Google widzi treść na urządzeniach stacjonarnych i mobilnych.

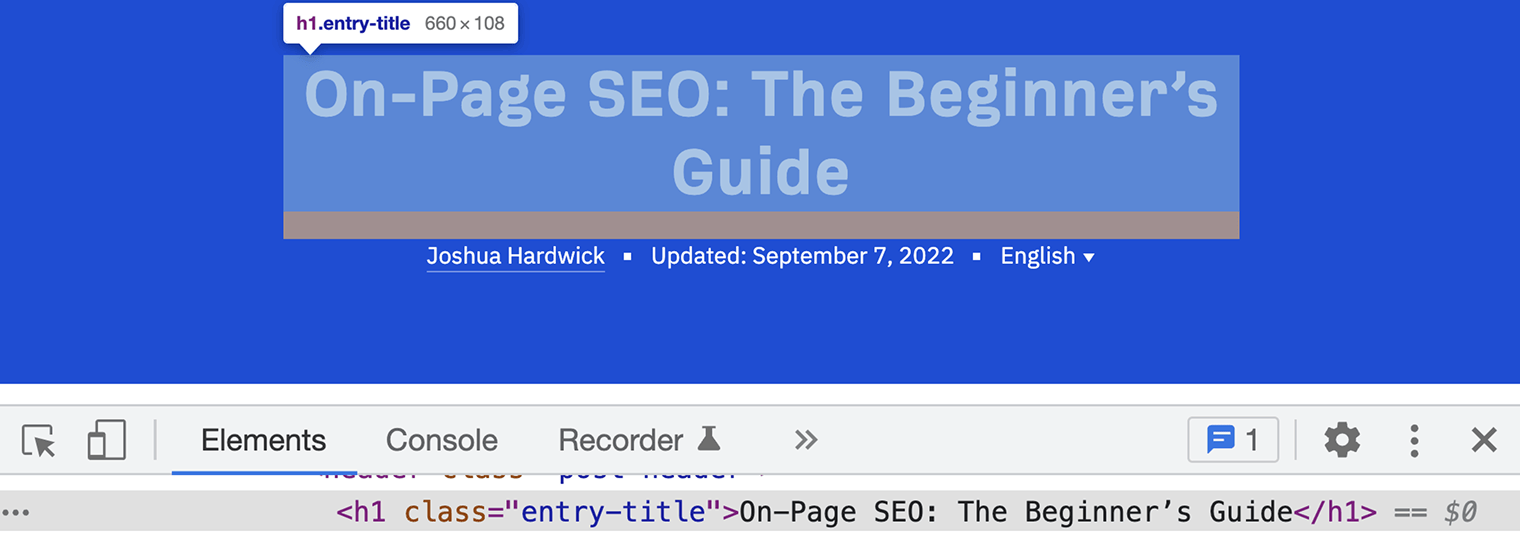

Chrome DevTools to narzędzie wbudowane w przeglądarkę Chrome, przeznaczone do debugowania stron internetowych. Służy do diagnozowania problemów z prędkością ładowania strony, poprawy wydajności renderowania stron i wielu innych zadań.

Z punktu widzenia technicznego SEO ma ono nieskończenie wiele zastosowań.

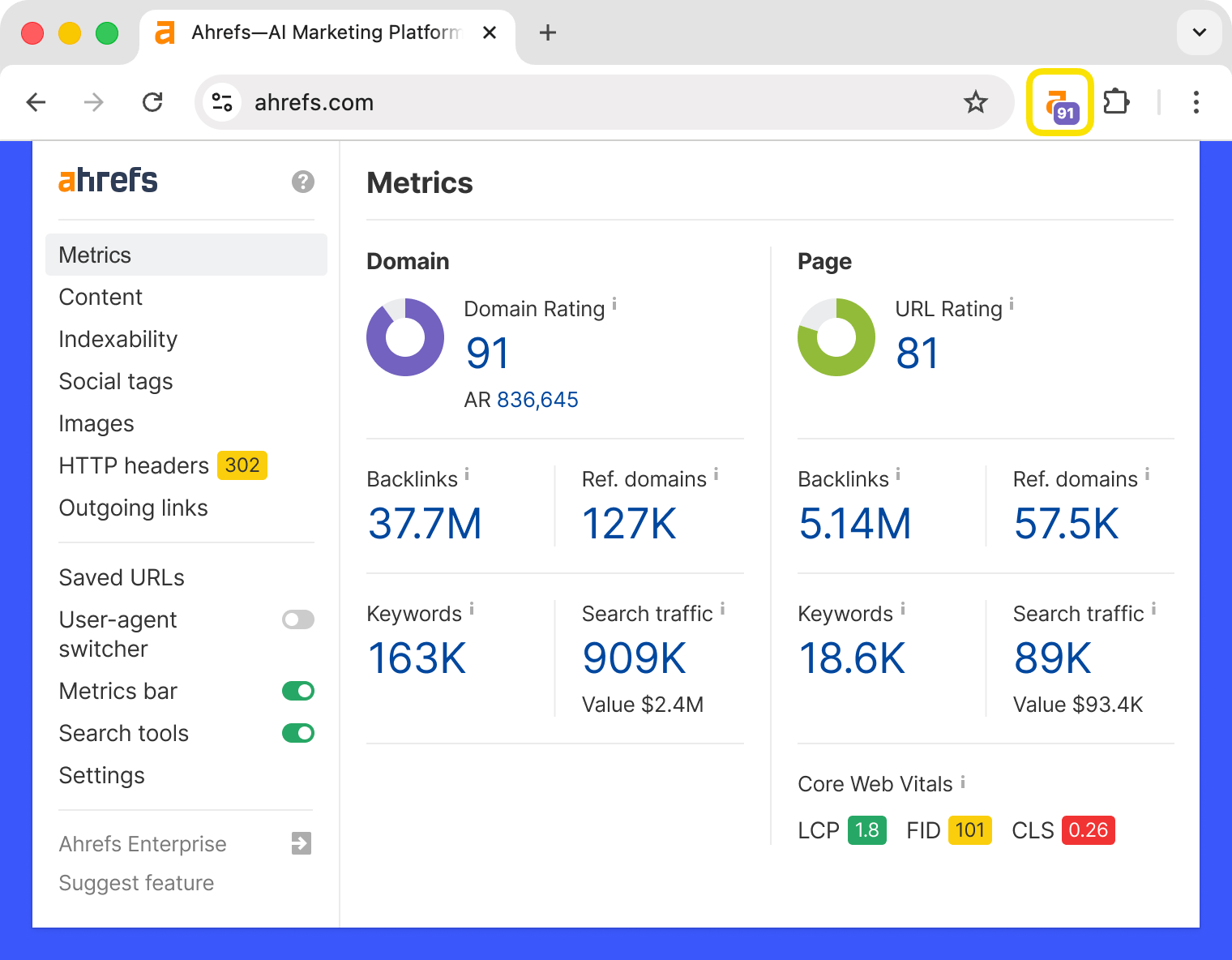

SEO Toolbar firmy Ahrefs to bezpłatne rozszerzenie dla przeglądarek Chrome i Firefox, które udostępnia użyteczne dane SEO dotyczące odwiedzanych stron i witryn.

Jego bezpłatne funkcje to:

- Raport dotyczący on-page SEO

- Śledzenie przekierowań z nagłówkami HTTP

- Sprawdzanie uszkodzonych linków

- Podświetlanie linków

- Pozycje w SERP

Ponadto jako użytkownik Ahrefs masz do dyspozycji:

- Wskaźniki SEO dotyczące każdej odwiedzanej strony oraz wyników wyszukiwania w Google

- Metryki słów kluczowych, takie jak wolumen wyszukiwań i trudność słowa kluczowego, widoczne bezpośrednio w wynikach wyszukiwania

- Eksport wyników SERP

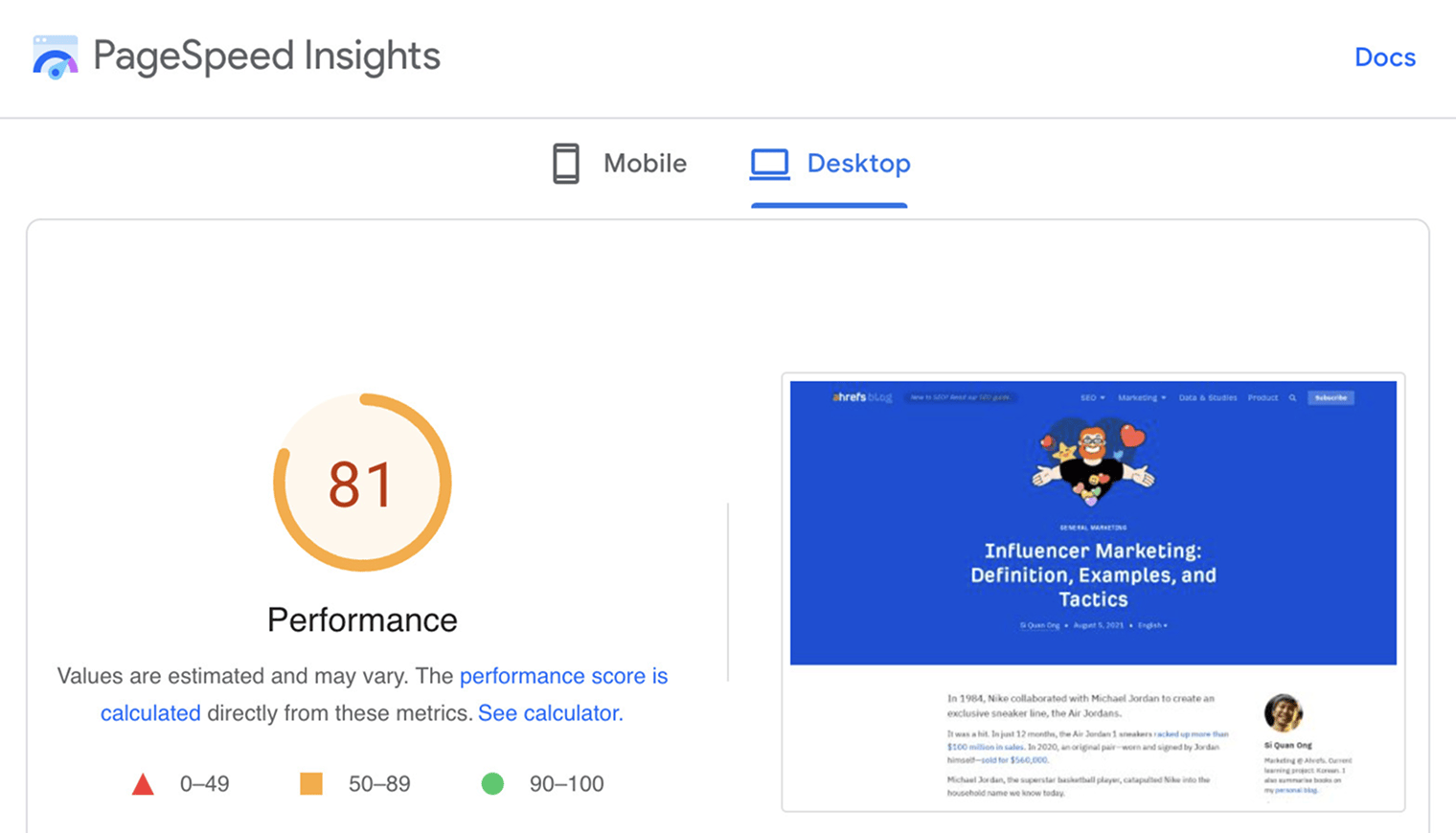

Narzędzie PageSpeed Insights analizuje szybkość ładowania Twoich stron internetowych. Oprócz ogólnej oceny wydajności pokazuje też praktyczne zalecenia, które pomogą przyspieszyć ładowanie Twoich stron.

Najważniejsze wnioski

- Jeśli Twoje treści nie zostaną zindeksowane, nie będzie można ich znaleźć w wyszukiwarkach.

- Gdy pojawia się usterka techniczna wpływająca bezpośrednio na ruch z wyszukiwarek, jej naprawa staje się priorytetem. Jednak na ogół lepiej poświęcić czas na dopracowanie treści i budowanie linków.

- Wiele zadań technicznych, które mają największy wpływ, dotyczy indeksowania lub linków.

- Techniczne SEO nadal ma znaczenie w dobie wyszukiwania AI. Dobrze ustrukturyzowane, łatwe do przeskanowania strony pomagają systemom sztucznej inteligencji odnajdywać, rozumieć i wyświetlać Twoje treści użytkownikom.

Odniesienia

- „Is a crawl-delay rule ignored by Googlebot?”. Google Search Central. 21 grudnia 2017 r.

- „Change Googlebot crawl rate”. Google. Data dostępu: 9 września 2022 r.

- „30x redirects don’t lose PageRank anymore”. Gary Illyes. 26 lipca 2016 r.

Patrick Stox pełni funkcję doradcy ds. produktu, specjalisty ds. technicznego SEO oraz ambasadora marki w Ahrefs. Był głównym autorem rozdziału poświęconego SEO w raporcie Web Almanac 2021, a także recenzentem rozdziału dotyczącego SEO w roku 2022. Jest również współautorem sygnowanej przez Ahrefs książki „SEO Book For Beginners” oraz redaktorem technicznym 4. wydania publikacji „The Art of SEO” (polskie wydanie zostało opublikowane pod tytułem „SEO, czyli sztuka optymalizacji witryn dla wyszukiwarek”). Patrick jest organizatorem cyklicznego wydarzenia „Triangle SEO Meetup”, konferencji „Tech SEO Connect”, prowadzi grupę „Technical SEO” na Slacku, a także jest moderatorem kanału /r/TechSEO na Reddicie.

Opanuj SEO krok po kroku

Jak działają wyszukiwarki

Zanim zaczniesz uczyć się SEO, musisz zrozumieć, jak działają wyszukiwarki.

Podstawy SEO

Dowiedz się, jak skonfigurować witrynę pod kątem skuteczności SEO, i zapoznaj się z czterema głównymi aspektami SEO.

Analiza słów kluczowych

Punktem wyjścia w SEO jest zrozumienie, czego szukają Twoi klienci docelowi.

Treści SEO

Dowiedz się, jak tworzyć treści, które zajmują wysokie pozycje w wyszukiwarkach.

SEO na stronie

W tym miejscu optymalizujesz swoje strony, aby pomóc wyszukiwarkom je zrozumieć.

Budowanie linków

Dowiedz się, jak tworzyć treści, które zajmują wysokie pozycje w wyszukiwarkach.

SEO techniczne

Zapobiegaj problemom technicznym, które uniemożliwiają Google'owi dostęp do Twojej witryny i jej zrozumienie.

Lokalne SEO

Dowiedz się, jak poprawić widoczność w lokalnych wynikach wyszukiwania i pozyskiwać więcej klientów z okolicy.

Co oznacza AI dla SEO

Dzisiaj nie można mówić o SEO bez wspomnienia o generatywnej AI.

Jak działają wyszukiwarki AI?

Dowiedz się dokładnie, w jaki sposób wyszukiwarki AI, takie jak ChatGPT, generują odpowiedzi i wybierają, które marki i produkty zostaną uwzględnione we wzmiankach.