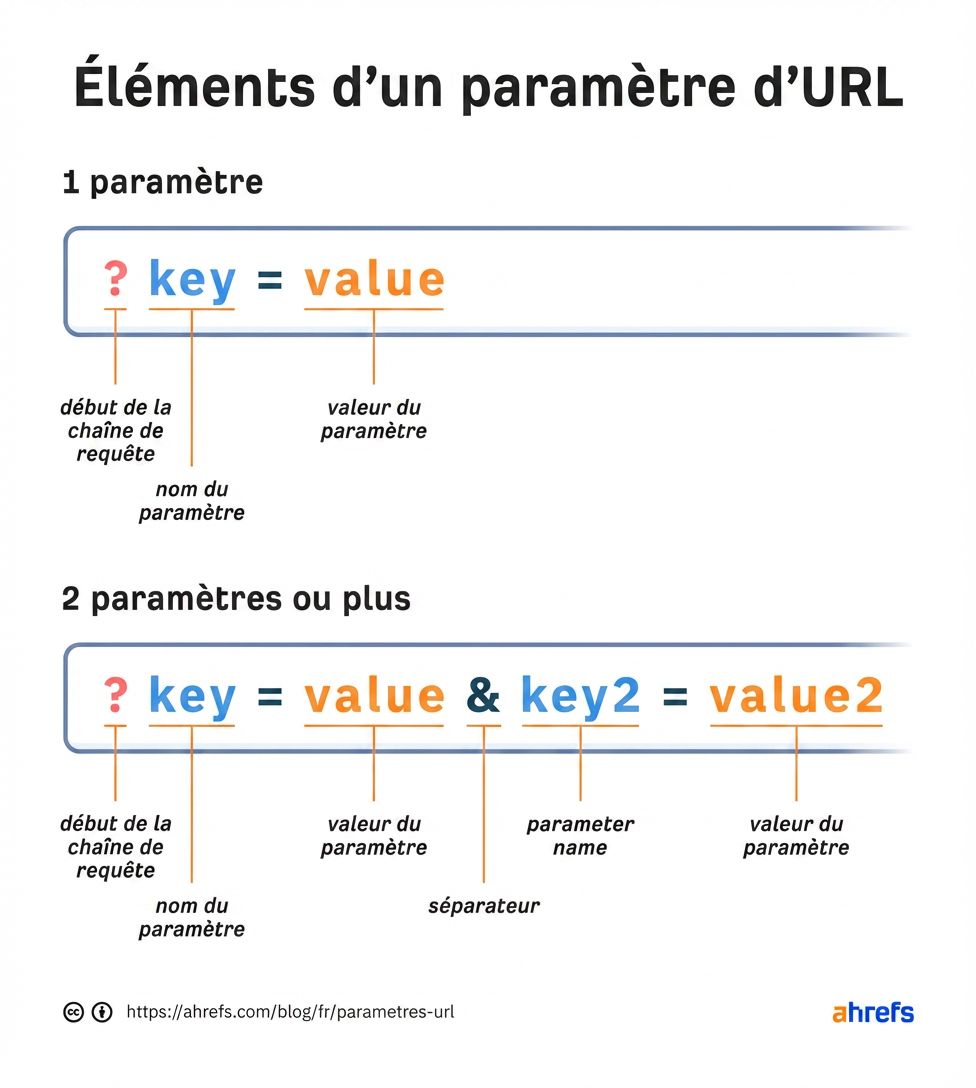

Les paramètres URL sont composés de paires clé-valeur, où la clé indique quel type de donnée est transmis et la valeur correspond à la donnée elle-même, comme un identifiant. Ils se présentent sous la forme ?clé=valeur et peuvent être séparés par des esperluettes (&) comme ?clé=valeur&clé2=valeur2 lorsqu’il y en a plusieurs.

Dans ce guide, on vous explique tout ce que vous devez savoir sur les paramètres URL en SEO.

Les paramètres peuvent être actifs ou passifs, je vous en donne des exemples pour chaque catégorie.

5 paramètres URL actifs

Les paramètres actifs modifient le contenu de la page d’une façon ou d’une autre.

- Filtrer : Réduit le contenu affiché pour ne montrer que les résultats spécifiques qu’un utilisateur souhaite voir. Un exemple courant est la navigation à facettes dans le e-commerce.

?color=yellow Trier : Réorganise le contenu selon un critère précis, comme le prix ou la note.

?sort=highest_ratedAjouter une pagination : Divise le contenu en une série de pages liées entre elles.

?p=2Traduire : Change la langue du contenu affiché.

?lang=deRechercher. Interroge un site web pour trouver l’information qu’un utilisateur recherche.

Sur notre moteur de recherche yep.com, on utilise la clé « q » pour la requête, et la valeur contient les informations sur ce que l’utilisateur cherche.

?q=ahrefs

4 paramètres URL passifs

Les paramètres passifs ne modifient pas le contenu de la page. Ils sont généralement utilisés à des fins de suivi. Voici quelques exemples.

- Identifiants d’affiliation. Transmettent un identifiant permettant de suivre l’origine des ventes et des inscriptions.

?id=ahrefs - Tags publicitaires. Permettent de suivre les campagnes publicitaires.

?utm_source=newsletter Identifiants de session. Permettent d’identifier un utilisateur spécifique. Il est rare que les sites web modernes utilisent encore des identifiants de session pour suivre les utilisateurs.

?sessionid=12345- Horodatage vidéo. Permet d’accéder directement à un moment précis dans une vidéo.

?t=135

Les paramètres URL peuvent générer plusieurs problèmes en SEO, surtout quand plusieurs paramètres se cumulent dans une même URL. Voici les principaux écueils à connaître.

Les paramètres passifs peuvent créer des problèmes de contenu dupliqué. En général, vous voulez qu’ils soient crawlés, et chaque page doit avoir une balise canonical pointant vers la version principale.

Il peut arriver que vous souhaitiez bloquer ces paramètres pour qu’ils ne soient pas crawlés via le robots.txt, mais uniquement si vous rencontrez des problèmes de budget de crawl. On y reviendra plus en détail.

Google choisit une version de la page à indexer via un processus appelé canonicalisation. Les signaux, comme les liens, se consolident ensuite vers cette version indexée.

Les paramètres actifs peuvent générer des pages au contenu quasi-identique ou très similaire à d’autres pages existantes. Mais ils peuvent aussi produire des contenus entièrement différents. Il est donc indispensable de vérifier à quoi servent réellement vos paramètres.

Les erreurs liées aux liens internes

Évitez d’utiliser des paramètres passifs (comme ceux utilisés pour le tracking) dans vos liens internes (les liens d’une page de votre site vers une autre).

C’est une pratique encore trop répandue sur les grands sites, mais il faut être clair : c’est une vieille habitude dépassée qu’il faut abandonner.

La plupart des outils d’analyse proposent un suivi par événements, qui permet d’enregistrer les mêmes données sans ajouter de paramètres dans vos URL.

En revanche, utiliser des paramètres actifs dans les liens internes est tout à fait acceptable dans la plupart des cas.

Les erreurs de paramètres URL liées au crawl

Des chemins d’URL potentiellement infinis avec des paramètres, ou un trop grand nombre de combinaisons possibles, peuvent poser des problèmes de crawl. Maintenez un ordre cohérent et évitez les chemins qui permettent d’ajouter des paramètres à l’infini.

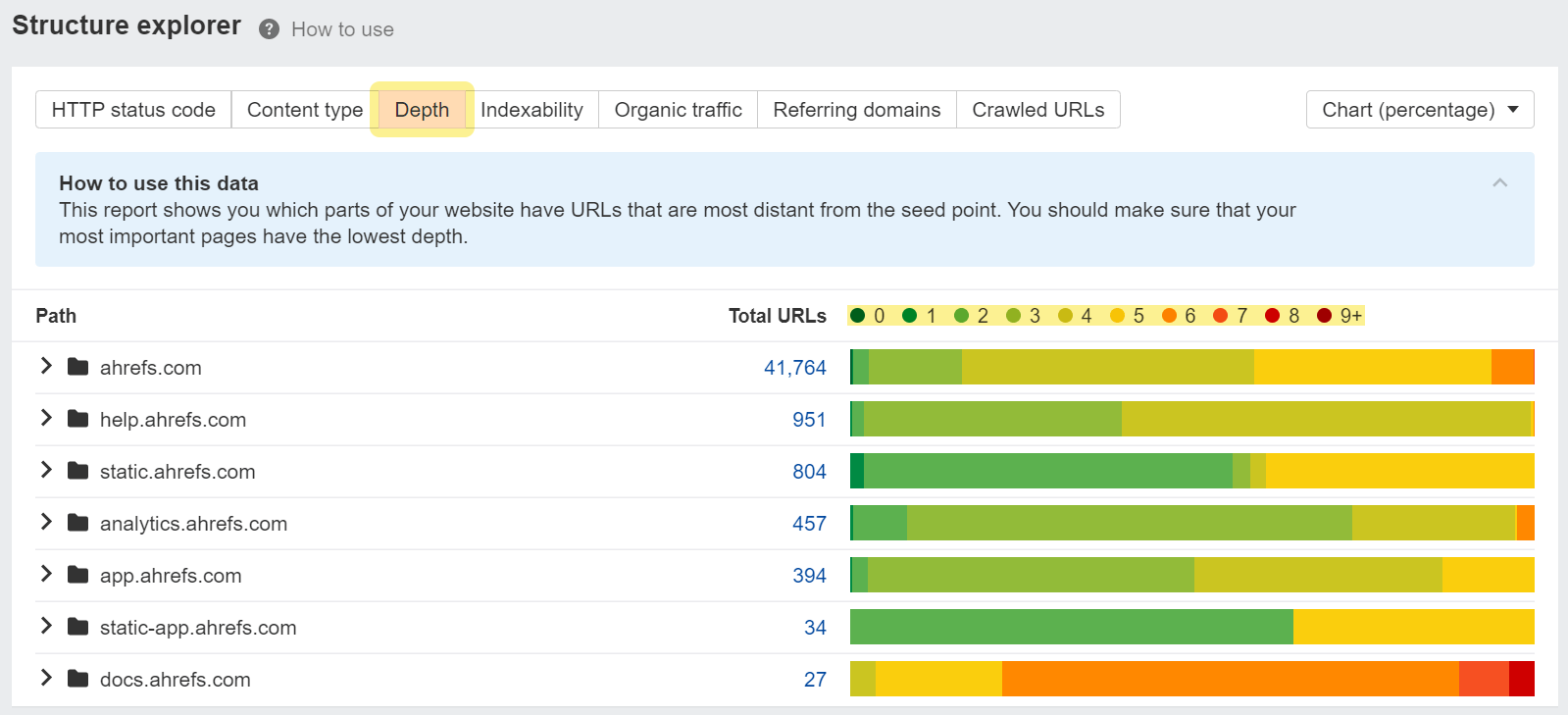

Vous pouvez facilement repérer ces chemins potentiellement infinis grâce au rapport Depth (pour “profondeur”, n’essayez pas de prononcer ce mot en anglais si vous n’êtes pas un professionnel) dans l’outil Structure Explorer de Site Audit. Il est rare qu’un site ait plus de 9 niveaux de profondeur. C’est donc un signal fort qu’il existe peut-être des chemins infinis ou un autre problème.

Google s’adapte au fur et à mesure qu’il détecte des chemins infinis ou certains patterns lors du crawl. Il cherche à limiter le crawl des URL qu’il juge inutiles ou répétitives.

Les paramètres pour l’internationalisation

Les paramètres URL sont parfois utilisés pour les sites internationaux. Ils sont mentionnés comme une option parmi d’autres pour les URL spécifiques à une langue ou une région. Mais même Google déconseille cette approche. Elle ajoute une couche de complexité supplémentaire où les risques d’erreur augmentent. De plus, vous ne pourrez pas cibler géographiquement ces URL dans Google Search Console.

Paramètres e-commerce

Les paramètres sont couramment utilisés dans le e-commerce pour tout : du tracking à la pagination, en passant par la navigation à facettes. Ces sujets peuvent être assez complexes. Je vous recommande de lire les articles que j’ai liés pour mieux les comprendre :

Paramètres URL et JavaScript

On observe une tendance croissante à utiliser # plutôt que ? comme identifiant de fragment, notamment pour les paramètres passifs utilisés au tracking. C’est généralement une mauvaise idée. Dans certains cas très précis, cela peut être acceptable pour remplacer des paramètres inutiles, mais je déconseille cette pratique en raison de tous les problèmes qu’elle entraîne.

Le problème : tout ce qui suit un # est ignoré par les serveurs, et beaucoup de systèmes ne reconnaissent tout simplement pas les paramètres utilisant un #.

Par ailleurs, le # a déjà une fonction bien définie : faire défiler la page jusqu’à une section précise. Cette action se produit côté client, et les développeurs JavaScript l’utilisent aussi pour le « routing » vers une page avec un contenu différent.

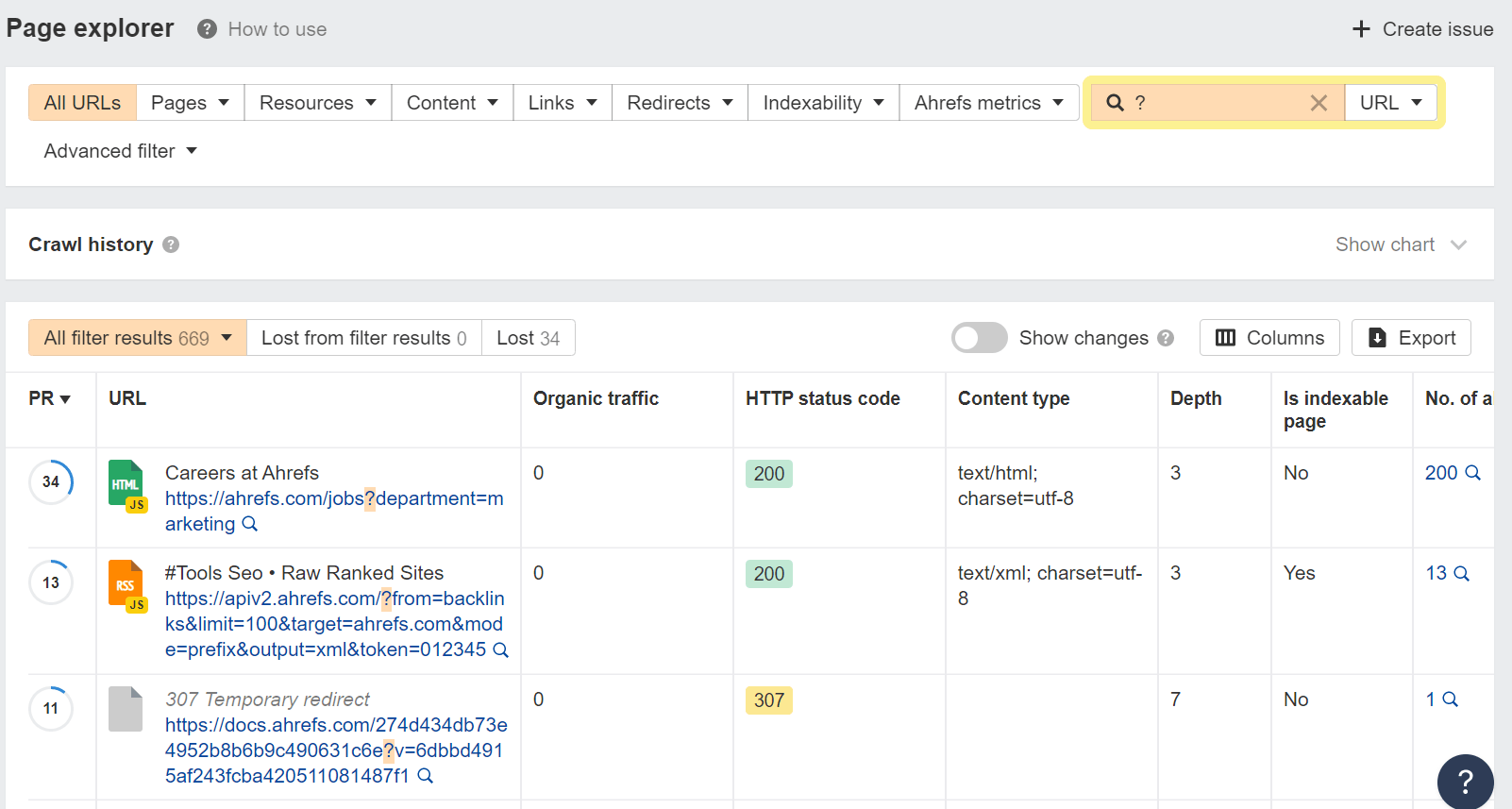

C’est une bonne idée de vérifier quels paramètres URL sont utilisés sur votre site. Dans l’outil Page Explorer de Site Audit, vous pouvez rechercher les URL qui contiennent un point d’interrogation (?).

Utilisez les filtres avancés pour trouver les pages avec plusieurs paramètres, ou commencez à exclure certains paramètres pour identifier l’ensemble des paramètres utilisés sur votre site.

Une fois que vous connaissez les paramètres utilisés, je vous recommande de vérifier quelques pages pour comprendre ce que ces paramètres font concrètement.

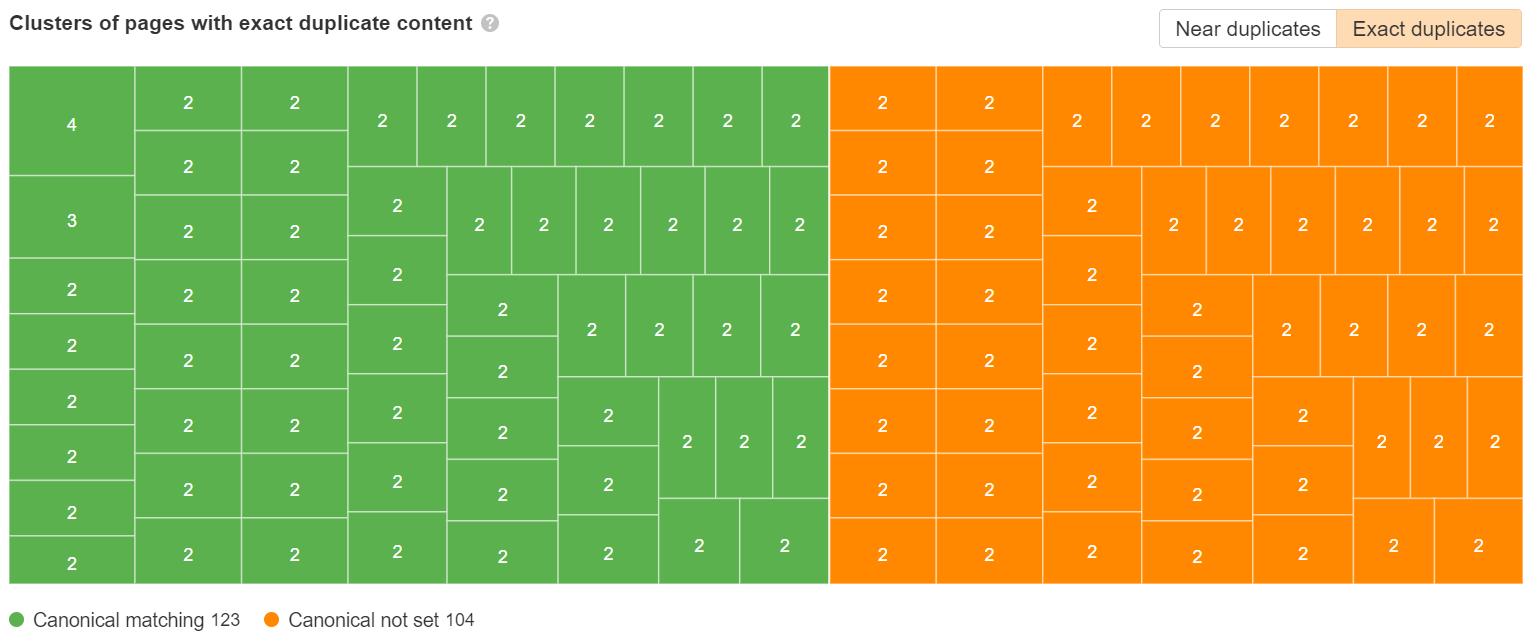

Vous pouvez également consulter le rapport Duplicates (doublon) pour repérer les duplicatas exacts ou quasi-identiques. La visualisation permet de voir facilement si vous avez de nombreuses versions d’une même page ou de pages similaires, et si elles ont des balises canonical correspondantes pour désigner une version préférée. Vous pouvez cliquer sur chaque cluster pour obtenir plus d’informations.

Il existe aussi une option d’export en masse qui vous permet d’exporter en une seule fois l’ensemble du contenu dupliqué. Je trouve cette option plus pratique pour traiter de grands volumes de données.

Auparavant, Google proposait un outil dédié aux paramètres URL dans Google Search Console, qui permettait de définir comment traiter chaque paramètre selon qu’il modifiait ou non le contenu de la page. Cet outil a été supprimé début 2022. Voici ce que Google a déclaré à ce sujet :

« Lorsque l’outil Paramètres URL a été lancé en 2009 dans Search Console (qui s’appelait alors Webmaster Tools), le web était un endroit bien plus chaotique qu’aujourd’hui. Les paramètres de session étaient très courants, les CMS avaient du mal à organiser les paramètres, et les navigateurs cassaient souvent les liens. Grâce à cet outil, les propriétaires de sites pouvaient contrôler avec précision la façon dont Google crawlait leur site en indiquant comment certains paramètres affectaient le contenu.

Au fil des années, Google est devenu beaucoup plus efficace pour identifier quels paramètres sont utiles sur un site et lesquels ne le sont pas. En réalité, seulement 1 % environ des configurations de paramètres actuellement définies dans l’outil sont utiles pour le crawl. En raison de la faible valeur de cet outil, tant pour Google que pour les utilisateurs de Search Console, on supprime l’outil Paramètres URL dans 1 mois. »

Google Search Central

Sans que cela soit mentionné explicitement, je soupçonne que certains utilisateurs se nuisaient à eux-mêmes avec cet outil. J’ai moi-même rencontré cette situation par le passé : quelqu’un avait renseigné un mauvais paramètre en indiquant que le contenu ne changeait pas, alors qu’il changeait bel et bien. Résultat : plusieurs centaines de milliers de pages ont été désindexées. Aïe !

Vous pouvez laisser Google crawler votre site et déterminer lui-même comment gérer les paramètres, mais vous disposez aussi de plusieurs leviers. Voici vos options.

Balises canonical

Une balise canonique permet de consolider les signaux vers une URL choisie, mais elle nécessite que chaque version supplémentaire d’une page soit crawlée. Comme mentionné plus tôt, Google peut s’adapter au fur et à mesure qu’il détecte des patterns, et ces URL canonicalisées peuvent être crawlées moins fréquemment avec le temps.

C’est l’option que je recommande par défaut. Mais si un site présente de nombreux problèmes et que les paramètres sont hors de contrôle, je peux envisager d’autres options.

Noindex

Une balise noindex dans la balise meta robots retire une page de l’index. Cela nécessite que la page soit crawlée, mais elle peut l’être moins fréquemment avec le temps. Si vous avez besoin de consolider des signaux vers d’autres pages, évitez d’utiliser noindex.

Blocage dans le robots.txt

Bloquer des paramètres dans le robots.txt n’empêche pas forcément les pages d’être indexées. Elles ont peu de chances d’apparaître dans les résultats de recherche habituels.

Le problème : ces pages ne seront pas crawlées et ne pourront pas consolider les signaux. Si vous souhaitez consolider des signaux, évitez de bloquer les paramètres via le robots.txt.

Site Audit

Lors de la configuration d’un projet dans Site Audit, il existe une option dans les paramètres de crawl appelée « Supprimer les paramètres URL » qui permet d’ignorer toutes les URL contenant des paramètres.

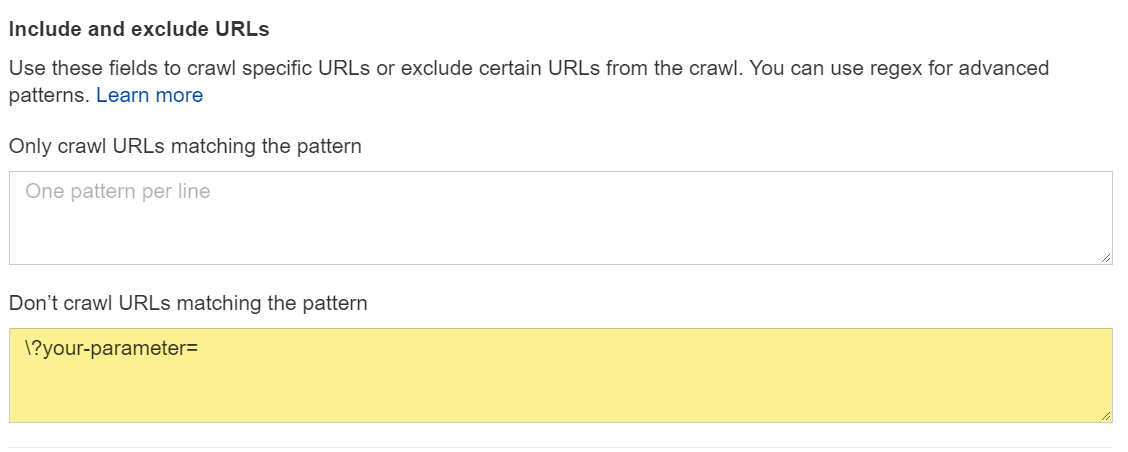

Vous pouvez aussi exclure les URL paramétrées lors de la configuration du crawl en utilisant le filtrage par pattern.

En résumé, les paramètres URL ont de nombreux cas d’usage et peuvent, ou non, poser des problèmes sur votre site. Tout dépend du contexte.

Contactez-moi sur X (Twitter) si vous avez des questions.