最強のマーケターがあなたのチームの一員に

初心者のための テクニカル SEO ガイド

Patrick Stox 作成

Ahrefs のテクニカル SEO 対策

テクニカル SEO は、SEO の初期段階においてのみ最も重要な部分となります。ページがクロール可能でインデックス可能であることが、ランキング上位を目指すための条件となりますが、コンテンツ作成やリンク構築以外の施策の多くは、パフォーマンスに与える影響がかなり小さい場合が多いです。

この初心者向けガイドは、基本を理解し、効果を最大化するために特に時間を割いて取り組むべき対策を理解していただくために作成しました。

テクニカル SEO の基本

テクニカル SEO とは?

テクニカル SEO とは、検索エンジンがウェブサイトのページを見つけ、クロールし、理解し、インデックス登録できるようにウェブサイトを最適化する手法です。検索エンジンでの可視性とランキングの向上に役立ちます。AI 検索における可視性アップのためにも重要です。

テクニカル SEO は、複雑で難しいものですか?

場合によります。基礎を習得するのはそれほど難しくありませんが、テクニカル SEO は複雑で理解しにくい場合があります。このガイドでは、できるだけ分かりやすく説明していきます。

テクニカル SEO は AI 検索に重要ですか?

はい。AI 検索は依然として、クロール可能で適切に構造化され、内容が信頼できるウェブページに大きく頼っています。テクニカル SEO は、サイトの読み込みスピード、アクセスしやすさ、インデックス化のしやすさを向上させ、AI 回答だけでなく従来の検索でもコンテンツが引用・参照される可能性を高めます。

クロールを理解する

この章では、検索エンジンがコンテンツを効率的にクロールできるようにする方法について説明します。

クロールの仕組み

クロールとは、検索エンジンがページからコンテンツを取得し、そこに掲載されたリンクをたどってさらに多くのページを発見するプロセスのことです。ウェブサイト上でクロールされる情報を制限することも可能で、以下にそのいくつかの方法をご紹介します。

Robots.txt

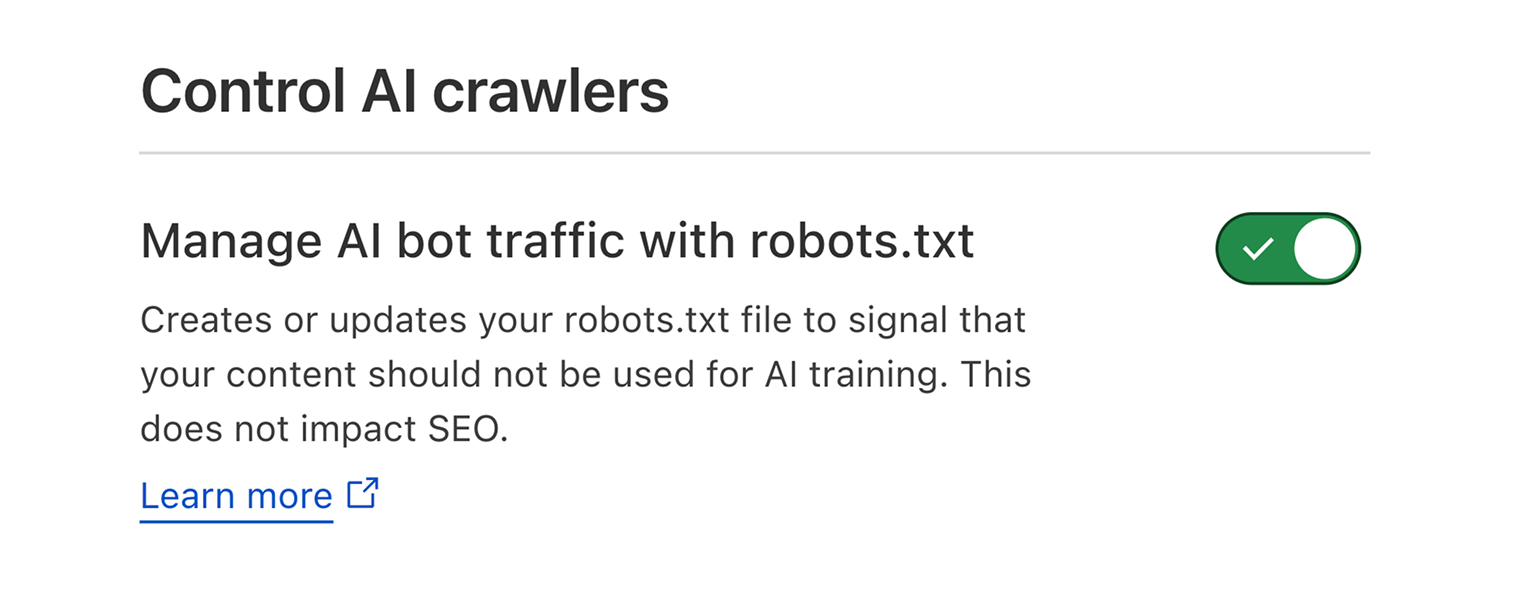

robots.txt ファイルは、検索エンジンと AI プラットフォームに対し、サイト上でアクセスできる場所とできない場所を伝えます。

ほとんどの検索エンジンや AI クローラーは、robots.txt の設定を尊重します。明示的に拒否すれば、それに従い、コンテンツをクロールしたり、学習データに含めたりすることはありません。しかし、検索エンジンや LLM にあなたのウェブサイトがトレーニングの素材として使用されることを拒絶すると、検索結果に表示される可能性も低くなります。

ご存じですか?

Google や一部の LLM は、クロールできないページに飛ぶリンクが貼られていると、そのページをインデックス登録してしまうことがあります。そのため、特定のページがインデックス登録されないようにしたい場合は、このガイドとフローチャートをご覧ください。手順をご案内します。

LLMs.txt

LLMs.txt は、大規模言語モデル(LLM)にコンテンツの利用方法を伝えるための任意の標準規格ですが、LLMs.txt ガイドで説明しているように、特に効果的ではなく、労力をかける価値はないでしょう。

LLMs.txt が AI による検索性能を向上させたり、トラフィックを増加させたり、モデルの精度を高めたりするという証拠は今のところありません。

クロールレート

アクセス制限

一部のユーザーのみがページにアクセスでき、検索エンジンにはアクセスできないようにしたい場合は、次の 3 つのいずれかの施策が必要です:

- 何らかのログインシステム

- HTTP 認証(アクセスにパスワードが必要)

- IP アドレスのホワイトリスト登録(特定の IP アドレスのみがページにアクセスできるようにする)

このタイプの設定は、社内ネットワーク、会員限定コンテンツ、ステージングサイト、テストサイト、開発サイトなどに最適です。特定のユーザーグループのみがページにアクセスでき、検索エンジンはアクセスできず、インデックス登録もされません。

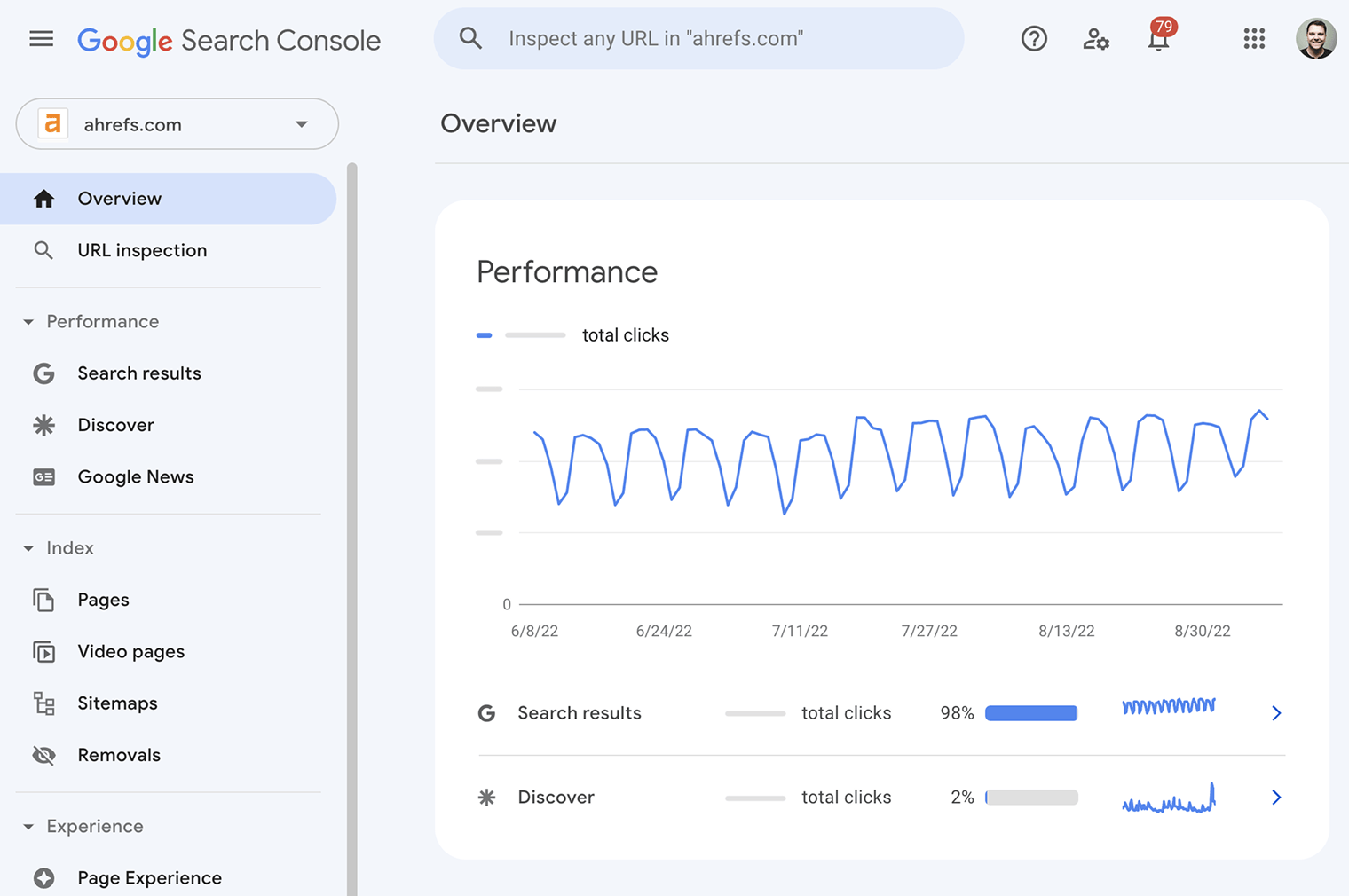

クロール活動の確認方法

特に Google の場合、クロール状況をチェックする最も簡単な方法は、Google Search Console の「クロール統計」レポートを確認することです。これにより、ウェブサイトのクロール方法についての情報が得られます。

AI クローラーによるものも含め、ウェブサイト上のすべてのクロール活動を確認したい場合は、サーバーログにアクセスし、場合によってはデータをより詳細に分析するためのツールを使用する必要があります。これはかなり高度な作業になる可能性があります。しかし、ホスティングサービスに cPanel のようなコントロールパネルがある場合は、生ログや AWstats、Webalizer などのアグリゲーターにアクセスできるはずです。

クロール調整

各ウェブサイトには異なるクロールバジェットがあり、これは Google がサイトをクロールしたい頻度と、サイト側が許可するクロール量が組み合わさって決まるものです。人気のページや頻繁に変更されているページはより頻繁にクロールされ、人気がない、あるいはリンクが少ないページはあまりクロールされません。

クローラーがサイトのクロール中に負荷や問題の兆候を検知すると、通常はクロール速度を落としたり、状況が改善するまでクロールを停止したりします。

ページがクロールされた後、レンダリングされてインデックスに送信されます。インデックスとは、検索クエリに対して返されるページのマスターリストです。ここからは、インデックスについてご説明していきます。

インデックス化を理解する

この章では、ページがインデックスに登録されていることを確かめる方法と、インデックス登録の状態を確認する方法について説明します。

ロボットに対する指示

robots メタタグは、検索エンジンに特定のページをクロールまたはインデックスする方法を指示する HTML スニペットです。ウェブページの <head> セクションに配置され、次のようになります。

<meta name="robots" content="noindex" />

テクニカル SEO のすぐに実行できる改善策

SEO 担当者にとって最も判断が難しいことの一つが、対策の優先順位付けです。SEO には多くのベストプラクティスが存在しますが、検索順位やトラフィックに大きな影響を与える変更もあれば、そうでないものもあります。ここでは、筆者が優先的に取り組むことをおすすめする施策をいくつかご紹介します。

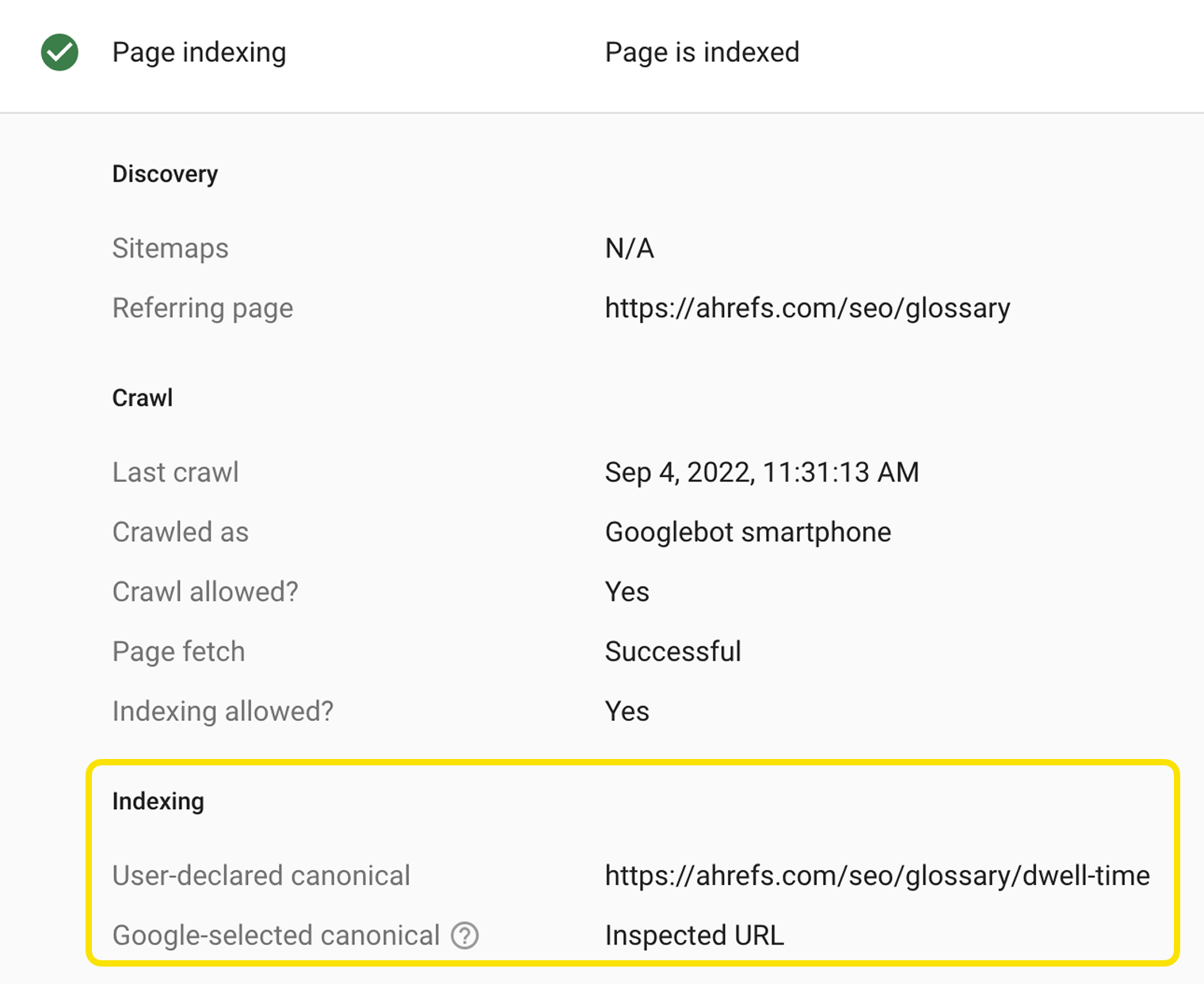

インデックス登録の確認

ネットユーザーに見つけてもらいたいページが Google にインデックスされるようにしてください。前の 2 章がどちらもクロールとインデックスについての内容だったのは、偶然ではありません。

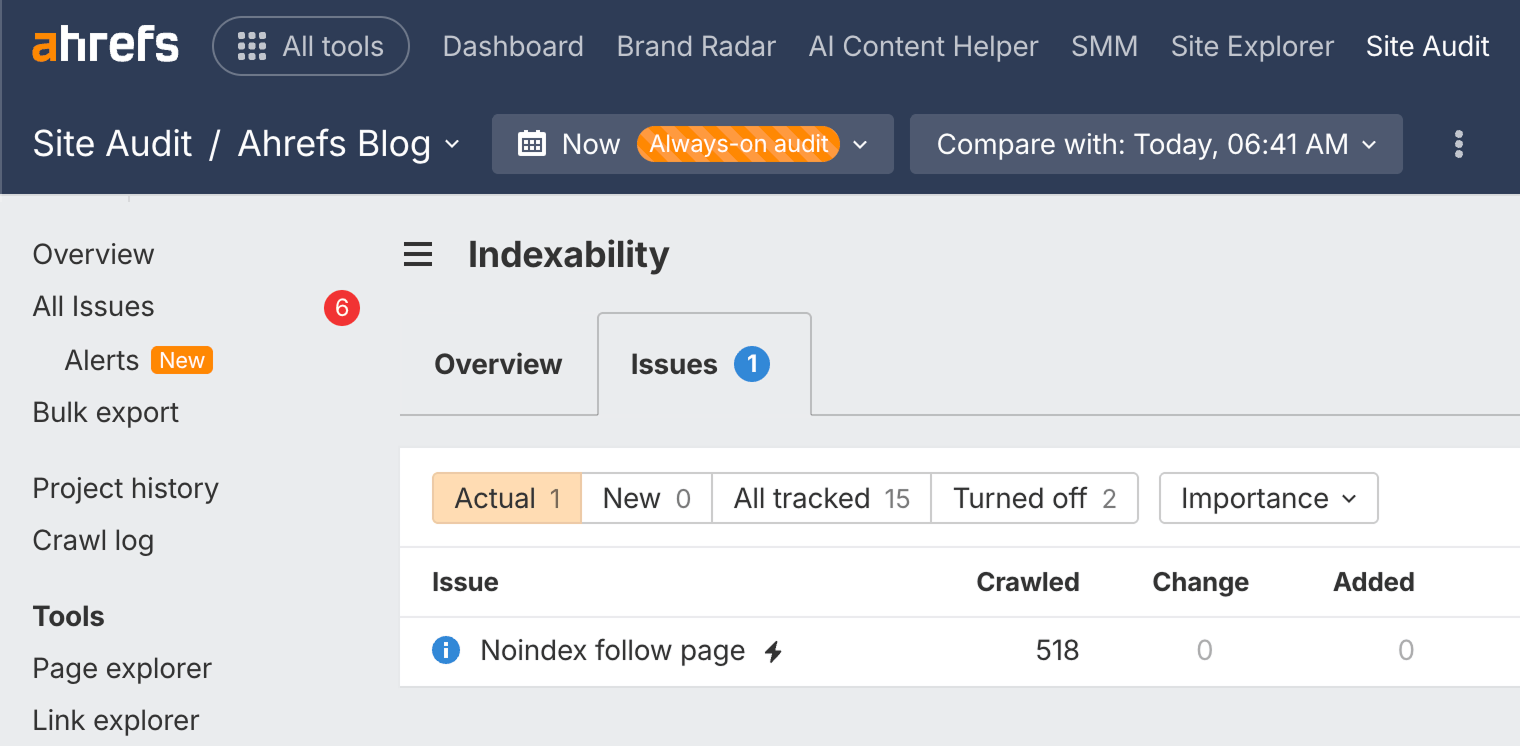

サイト監査の Indexability レポートで、インデックスできないページとその理由を確認できます。Ahrefs Free で利用できます。

無料でテクニカル SEO 監査を実施

ここから利用登録すると、Ahrefs Free ↗ をご利用いただけます

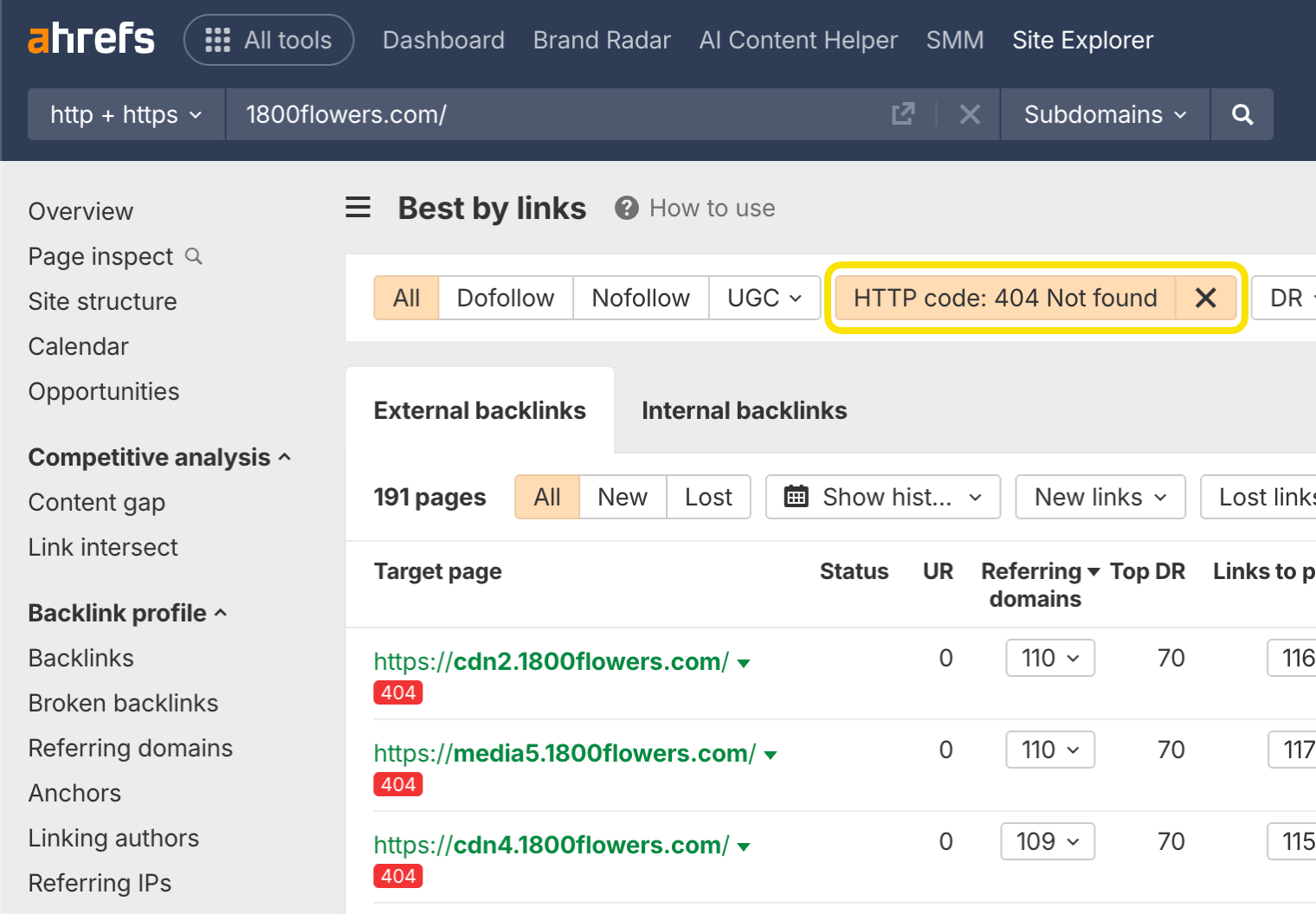

失われたリンクを回復

ウェブサイトは年月の経過とともに URL を変更する傾向があります。ところが多くの場合、これらの古い URL は他のウェブサイトにリンクとして掲載されています。古いリンクが現在のページにリダイレクトされていない場合、そのリンクは失われ、ページの価値も失われてしまいます。リダイレクトを行うのに遅すぎるということはなく、リンクの価値をすぐに取り戻すことができます。これが、リンク構築の中で最も手が付けやすい対策だと思ってください。

Ahrefsのサイトエクスプローラーを使って、失われたリンクを取り戻す機会を見つけることができます。ウェブサイトのドメインを入力し、被リンク数の多いページレポートに移動して、HTTP レスポンスフィルターの「404 Not Found」を追加します。筆者は通常、「参照ドメイン」で並べ替えます。

1800flowers.com の場合は以下のようになります。

archive.org の最初の URL を見てみると、以前は「母の日」専用ページだったことがわかります。このページを現在のバージョンにリダイレクトするだけで、59 のウェブサイトからの 225 件のリンクを回復させることができます。そして、他にも多くの改善の余地があります。

リダイレクトのマッチングを支援するスクリプトまで作成しました。難しく考える必要はありません。いくつかのファイルをダウンロードしてアップロードするだけです。Colab ノートブックが手順を案内し、面倒な作業はすべて自動で行ってくれます。

この失われた価値を取り戻すには、古い URL を現在のページに 301 リダイレクトするといいでしょう。

ご存じですか?

301 リダイレクトは恒久的なリダイレクトです。リダイレクト先の URL を指すリンクはすべて、Google には新しい URL としてカウントされます。[3]

内部リンクを追加

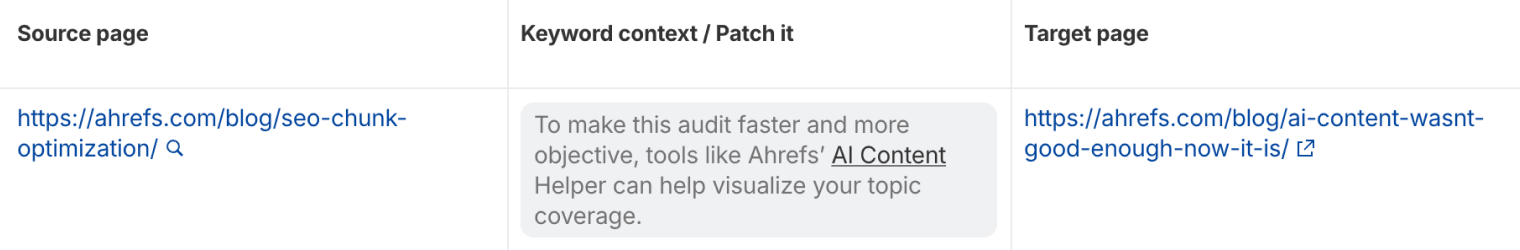

内部リンクは、サイト内のページから別のページに飛ぶリンクのことです。ページが見つけやすくなるだけでなく、検索順位の向上にも役立ちます。サイト監査には、内部リンクを構築できる箇所を素早く特定できる Internal Link Opportunities(内部リンク機会)というツールがあります。

このツールは、あなたのサイトが既に検索上位のキーワードの言及箇所を検索します。そして、それらをコンテキストに基づいた内部リンクの候補として提案します。

例えば、このツールは、重複コンテンツに関するガイドの中で「ファセットナビゲーション」という用語が言及されていることを表示しています。サイト監査ツールは、ファセットナビゲーションに関するページが存在することを把握しているため、そのページへの内部リンクを追加することを提案しています。

スキーママークアップを追加

スキーママークアップは、検索エンジンによるコンテンツの理解を助け、検索結果でウェブサイトを際立たせる多くの機能を実現するためのコードです。また、LLM にページコンテンツを正しく解釈してもらうのにも役立ちます。Google には、さまざまな検索機能と、サイトが表示対象となるために必要なスキーマが確認できる検索ギャラリーという機能があります。

AI 検索に合わせたテクニカル SEO

AI は、検索ユーザーのコンテンツの検索方法や回答の表示を変えましたが、依然としてクロール可能で構造が整っており、信頼できるウェブページの存在に大きく頼っています。また、コンテンツの作成方法や最適化方法も変えつつあります。

AI ツールに合わせて最適化するためのテクニカル要因に重点的に取り組むことで、人々が情報を検索するあらゆる場所で、サイトを目立つ存在にすることができます。

サイトを LLM にアクセスしやすい構造にする

検索エンジンと同様に、LLM に対してもウェブサイトのクロールとコンテンツへのアクセスを可能にする必要があります。ただし、検索エンジンのクローラーとは少し動作が異なります。

例えば、ほとんどの LLM は、ウェブサイト構築によく使われるプログラミング言語である JavaScript をレンダリングしません。重要なコンテンツやナビゲーションが JavaScript の読み込み後にしか表示されない場合、一部の AI クローラーにはそれらを認識できないというリスクがあります。そのため、AI 検索で表示させたい重要なコンテンツには、JavaScript の使用を避けるのが最善です。

サードパーティのツールが AI クローラーによるウェブサイトへのアクセスをブロックしていないかどうかも確認しておくと良いでしょう。

例えば、Cloudflare は、AI プラットフォームがトレーニングデータセットのためにコンテンツをスクレイピングできるかどうかをウェブサイトの所有者が制御できる新機能を導入しました。

デフォルト設定では、AI クローラーがコンテンツにアクセスするのをブロックしています。しかし、AI 検索結果における可視性を最大化したい場合は、これをオフにする必要があります。

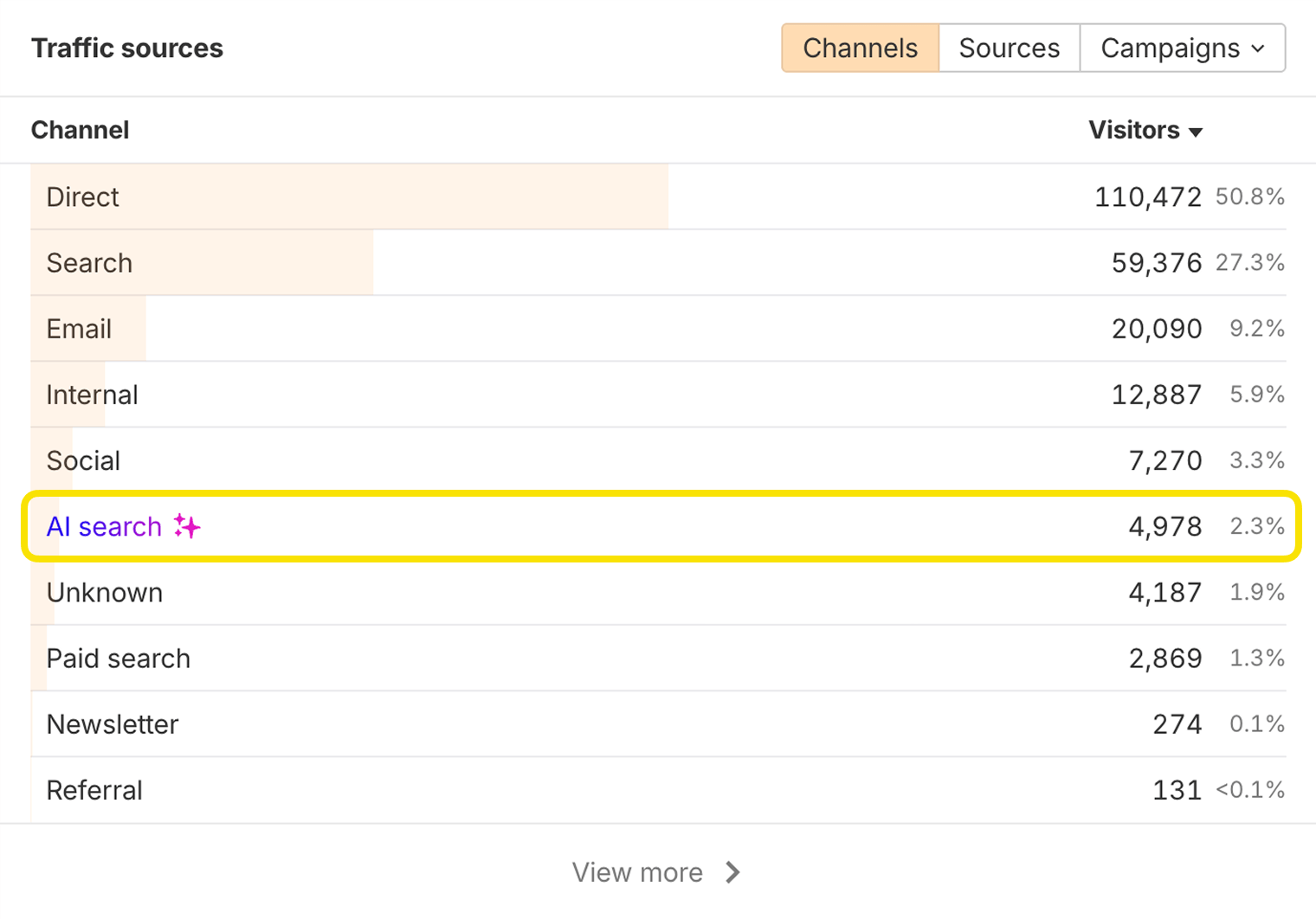

幻覚 URL をリダイレクト

AI 検索システムは、実際には存在しないあなたのドメイン内の URL を引用してしまう場合があります。Ahrefs のウェブアナリティクスで、AI 検索からトラフィックが流入しているページを確認することで、こういった URL を検出できます。

これらのページのいずれかが 404 エラーを返す場合、AI システムが URL を誤って認識した可能性があります。トラフィックの損失を防ぐため、その URL を関連する他の有効なページにリダイレクトしてください。

定期的なモニタリングにより、ユーザーの利用満足度を維持し、ブランドの信頼性を守ることができます。

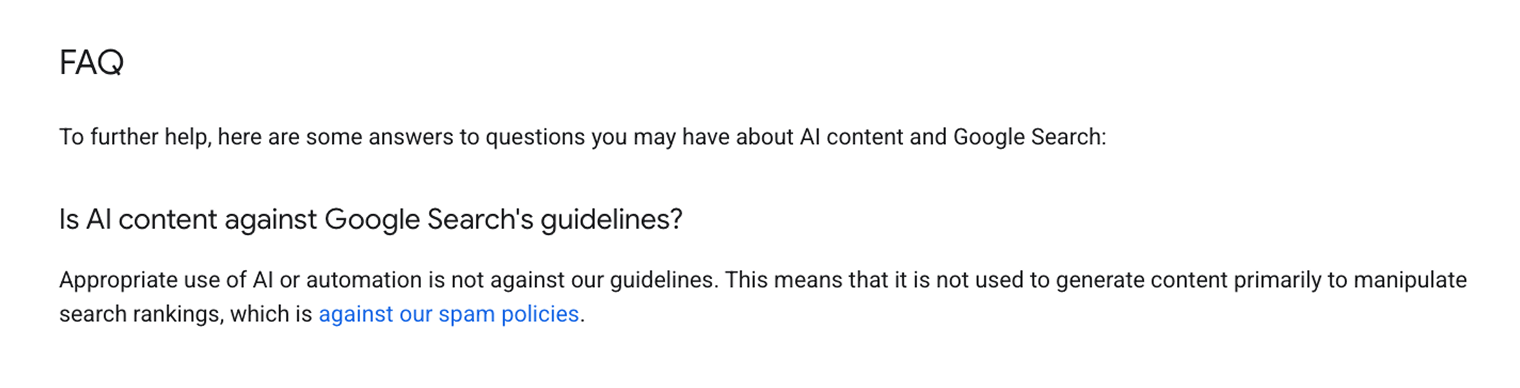

AI コンテンツ検出

ウェブサイトのコンテンツ作成に AI を使用することは問題ありませんが、AI コンテンツが多すぎると、スパムシグナルと見なされ、従来の検索エンジンや AI 検索におけるコンテンツの可視性が低下する可能性があります。

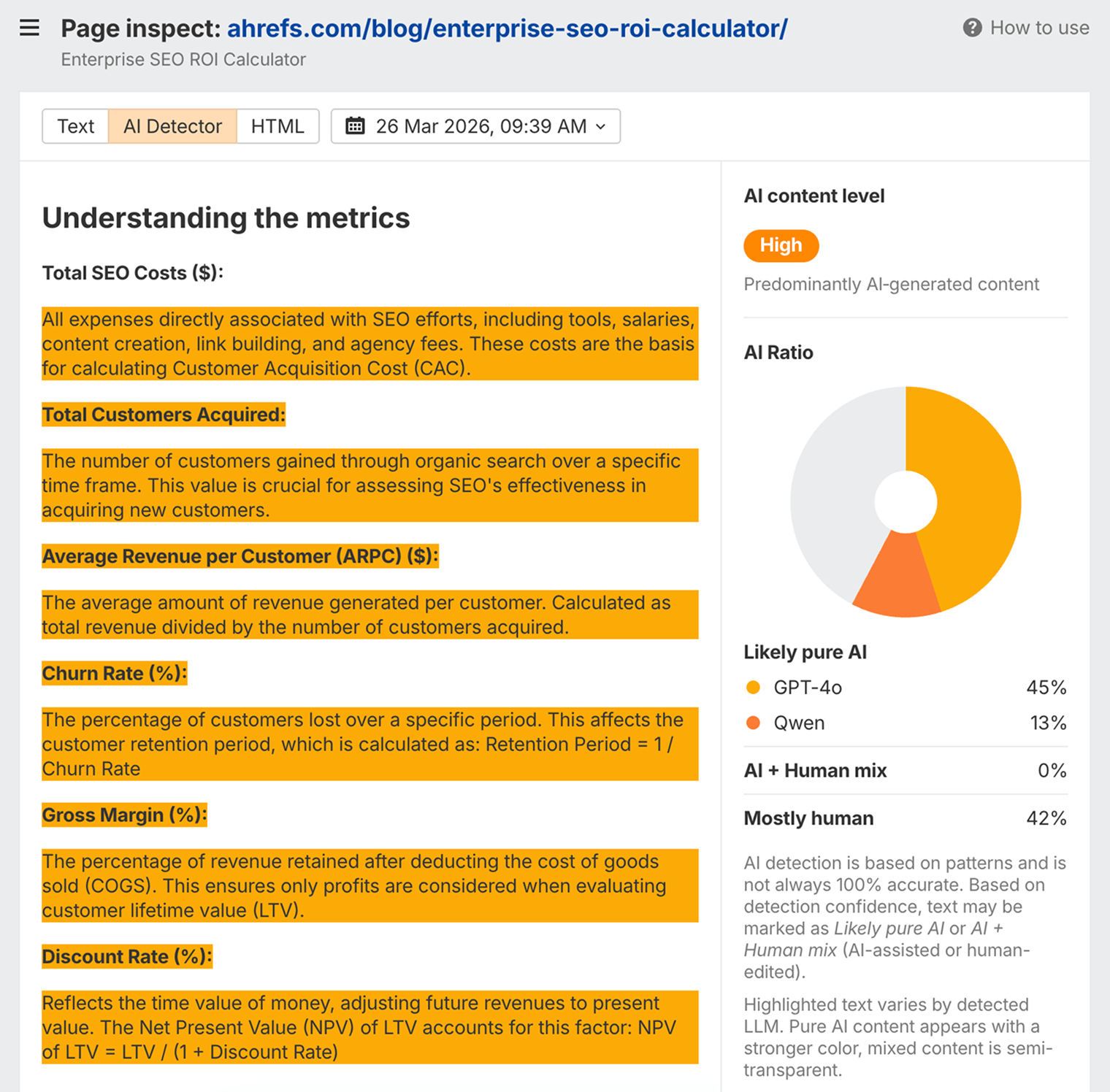

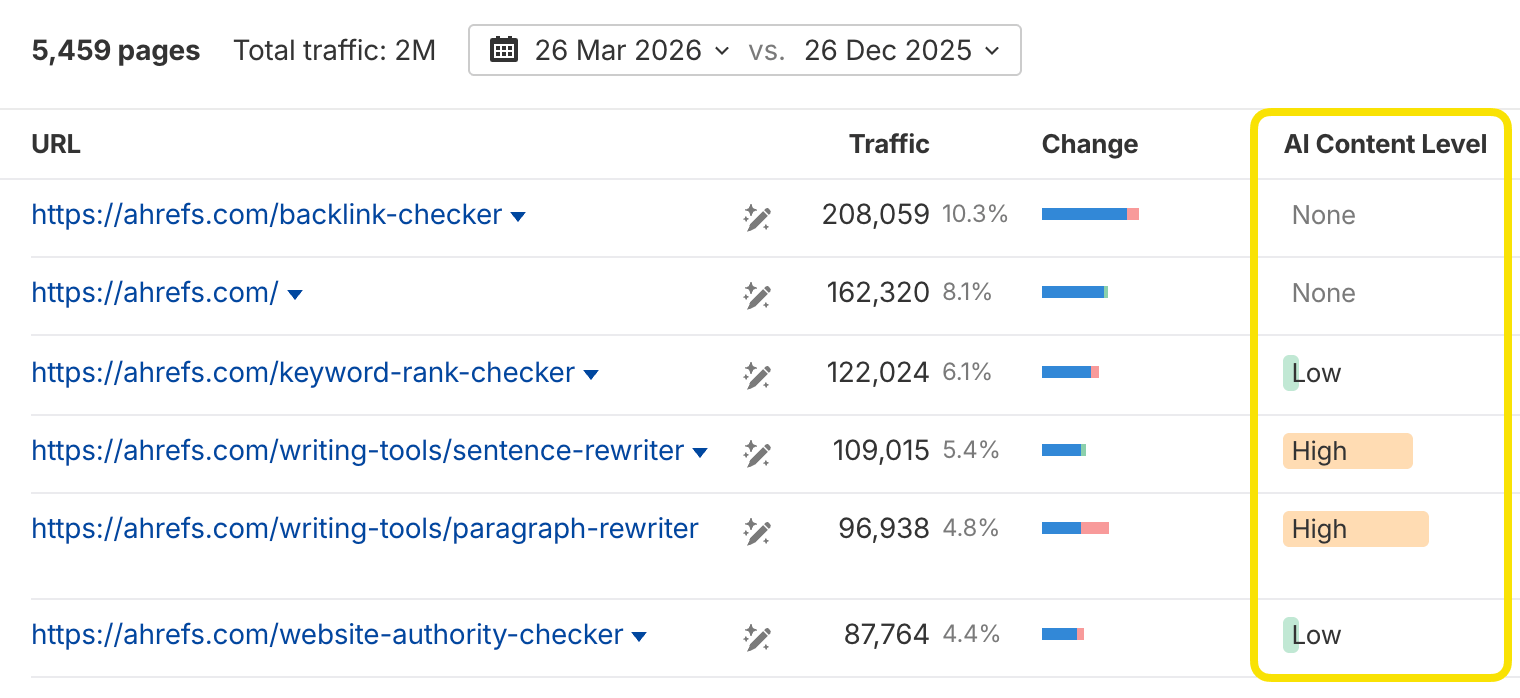

サイトエクスプローラー > ページ検査 内の AI 検出機能を使えば、コンテンツ作成に AI が使用された割合を確認できます。

上位ページレポートで一括確認して、書き直しが必要な既存のページを特定することもできます。

AI ツールによって注入されたコード

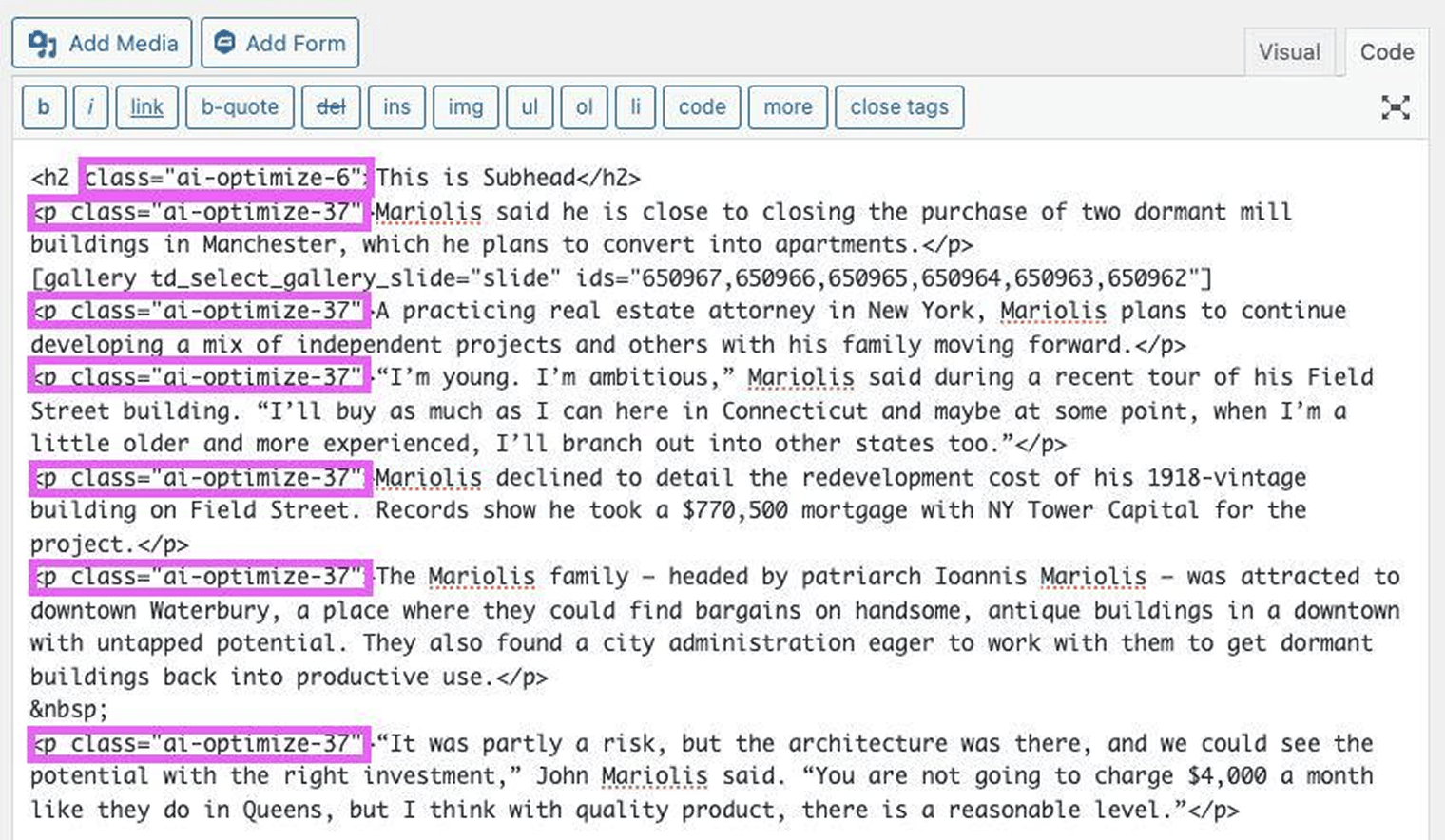

ウェブサイトの構築や新機能の追加に AI を利用した場合、AI が使用されたことを示す追加の HTML コードが生成されることがあります。

あるケースでは、Yoast SEO のバグにより、ページに AI 関連の非表示クラスが挿入され、検索エンジンに AI が関与していることが明らかになってしまいました。

AI ツールを使用してページ上の変更を行う場合は、サイトのソースコードを確認し、予期しないコードが追加されていないことを確認してください。このような隠れた「痕跡」は、定期的なコードレビューとアップデート公開前のテストによって回避できます。

追加のテクニカル SEO プロジェクト

この章で取り上げる手法はどれも優れたものですが、前の章で紹介した「すぐに成果が出る」対策に比べると、より多くの労力が必要で、得られる成果も少ないかもしれません。だからといって、これらの方法は避けるべきだいうことではありません。様々な手法を知り、どのように優先順位を付けて取り組むべきかを考えつつ、読み進めていってください。

ページ体験の評価指標

これらはランキング要因としては重要度は低いものの、ユーザーのためにも確認しておきたい点です。ウェブサイトのユーザーエクスペリエンス(UX)を左右するポイントを網羅しています。

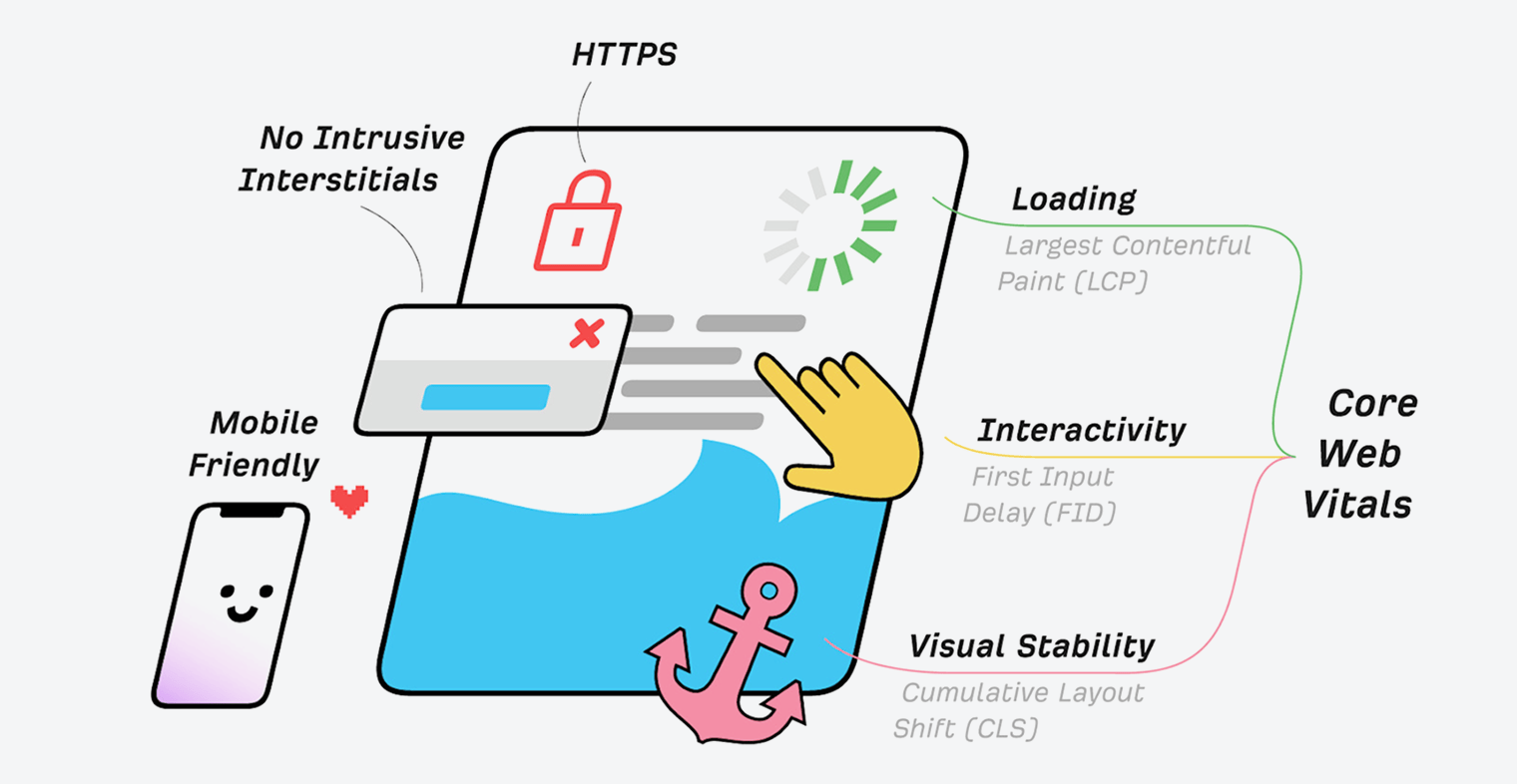

Google のページエクスペリエンスに関する検索シグナル

https://ahrefs.com/blog/core-web-vitals/

コアウェブバイタル

コアウェブバイタルとは、ユーザーエクスペリエンスを測定するために使用される Google のページエクスペリエンスシグナルの一部である速度指標です。指標は、Largest Contentful Paint(LCP)で視覚的な負荷を、Cumulative Layout Shift(CLS)で視覚的な安定性を、First Input Delay(FID)でインタラクティブ性を測定します。

HTTPS

HTTPSは、ブラウザとサーバー間の通信を攻撃者による傍受や改ざんから保護します。これにより、現在のウェブ通信の大部分において、機密性・完全性・認証が確保されます。ページは HTTP ではなく HTTPS で読み込むようにしてください。

アドレスバーに「鍵」アイコンが表示されているウェブサイトは、HTTPS を使用しています。

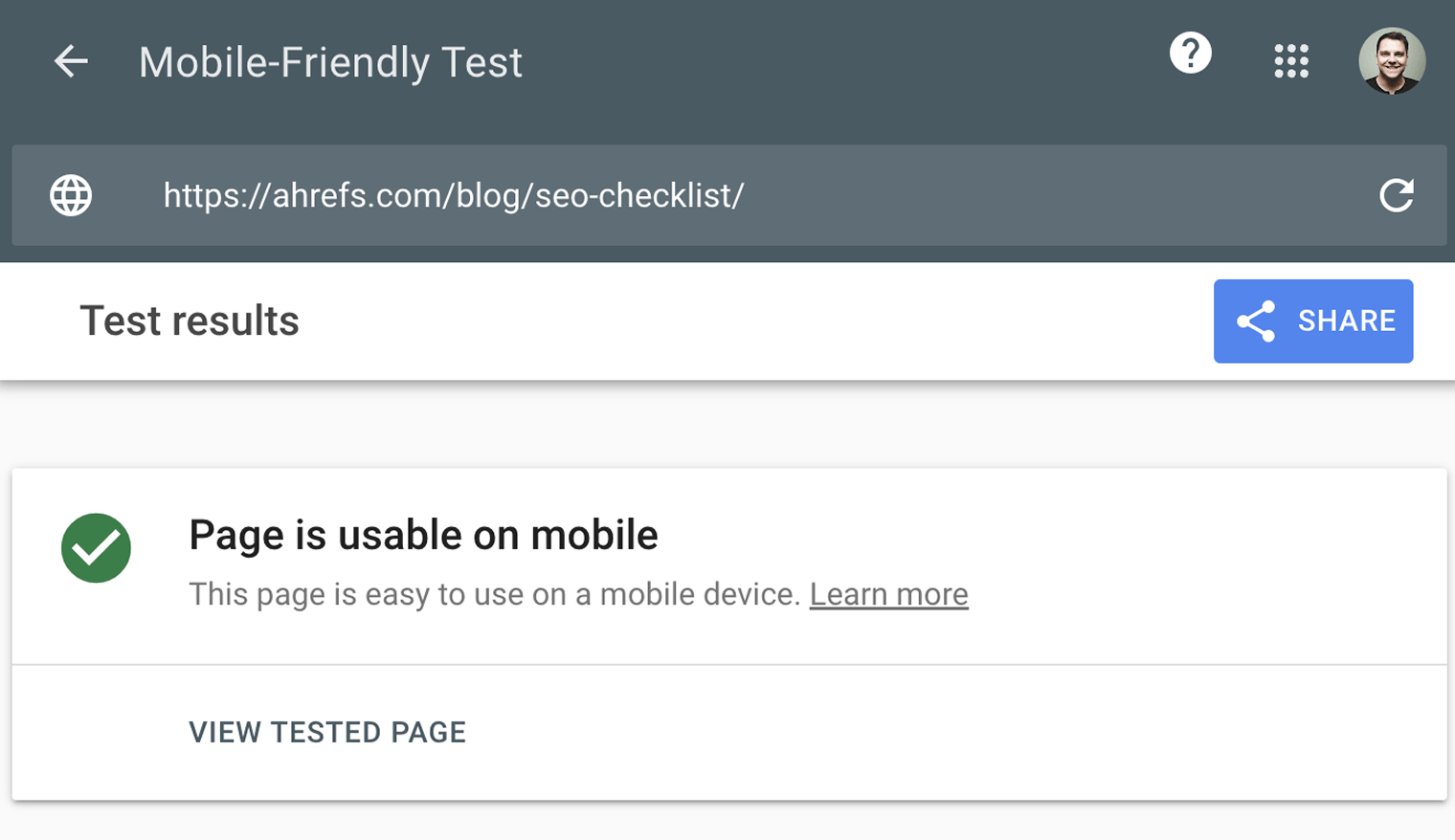

モバイル対応性

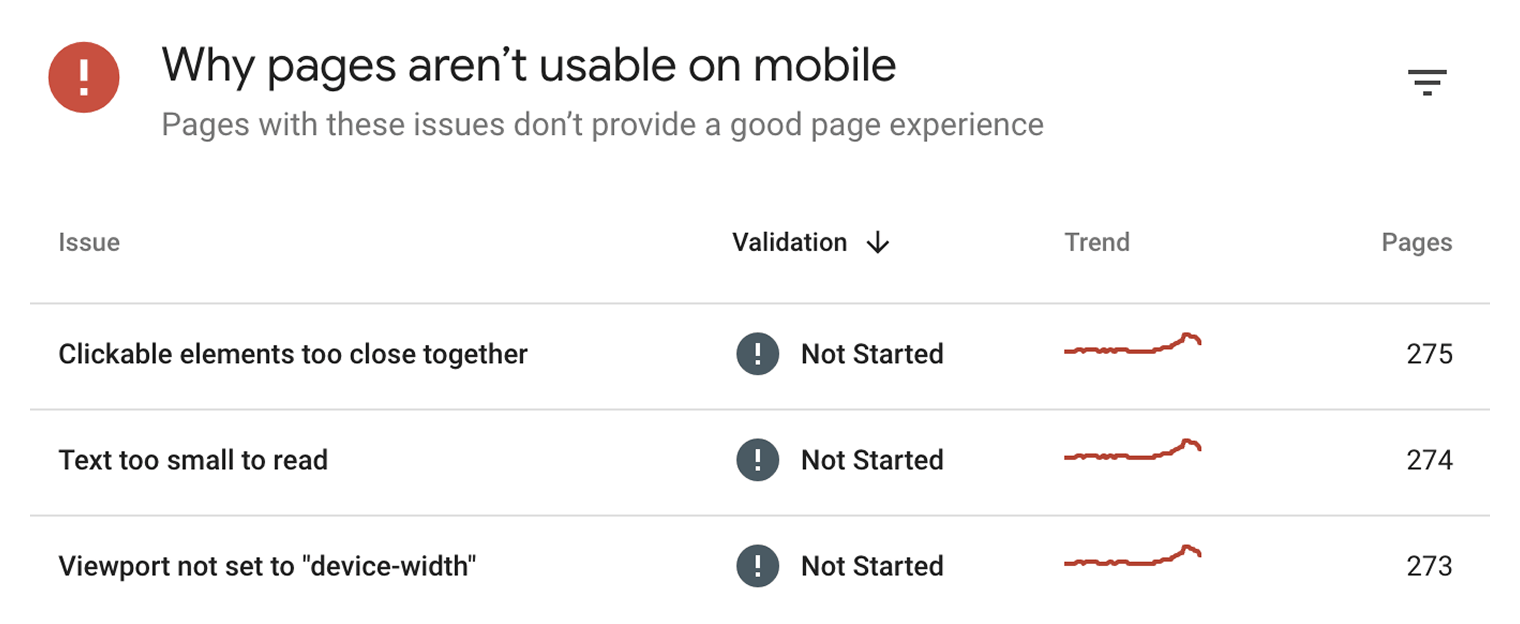

簡単に言うと、これはウェブページが正しく表示され、モバイル端末ユーザーが簡単に利用できるかどうかを確認するものです。

あなたのサイトがモバイルフレンドリーかどうか、どうやって判断していますか?Google Search Console の「モバイルユーザビリティ」レポートを活用しましょう。

このレポートでは、あなたのウェブサイト上のページにモバイルフレンドリー性に関する問題があるかどうかを確認できます。

インタースティシャル

インタースティシャル広告はコンテンツを見づらくします。これらは主要コンテンツを覆うように表示されるポップアップで、消すためには操作が必要な場合があります。

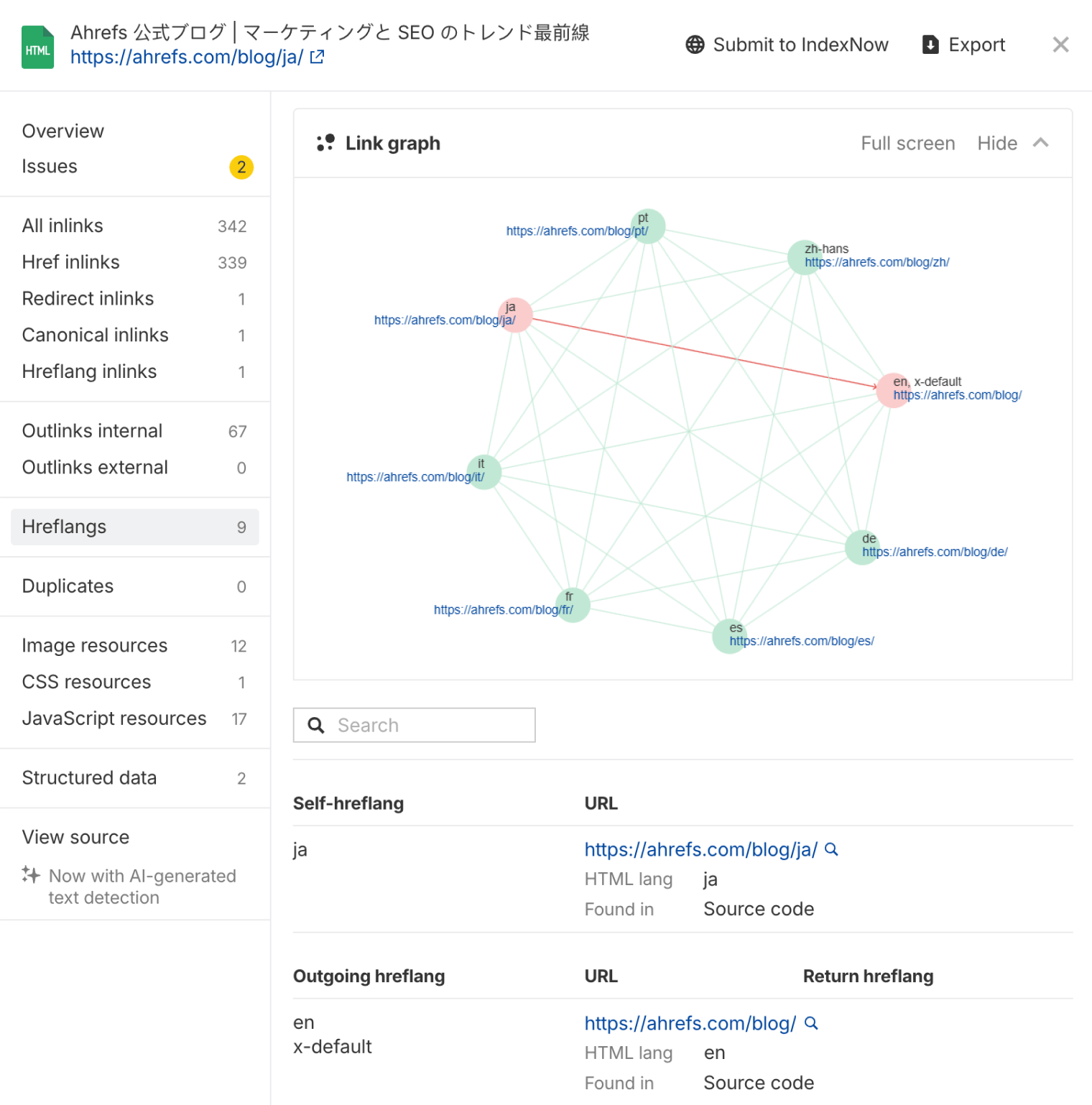

Hreflang — 多言語対応

Hreflang は、ウェブページのターゲット言語と地域を指定するために使用される HTML 属性です。同じページが異なる言語で存在する場合、hreflang タグを使用して、Google などの検索エンジンにこれらの複数バージョンの存在を知らせることができます。これにより、検索エンジンはユーザーに対して適切なバージョンを表示できるようになります。

Ahrefs は現在、サイト監査の視覚的な hreflang リンクグラフにより、hreflang の実装がより簡単になっています。

この hreflang グラフでは、ページのすべての言語バージョンが表示され、設定上の問題点がハイライト表示されます。さらに、無効な言語コード、自己参照リンクの欠落、相互タグの不足といったエラーを指摘し、それらを修正するための明確なガイダンスが提供されます。

一般的なメンテナンス/ウェブサイトの健全性

これらの作業は順位に大きな影響を与える可能性は低いですが、ユーザーエクスペリエンスを向上させるために、一般的には推奨されます。

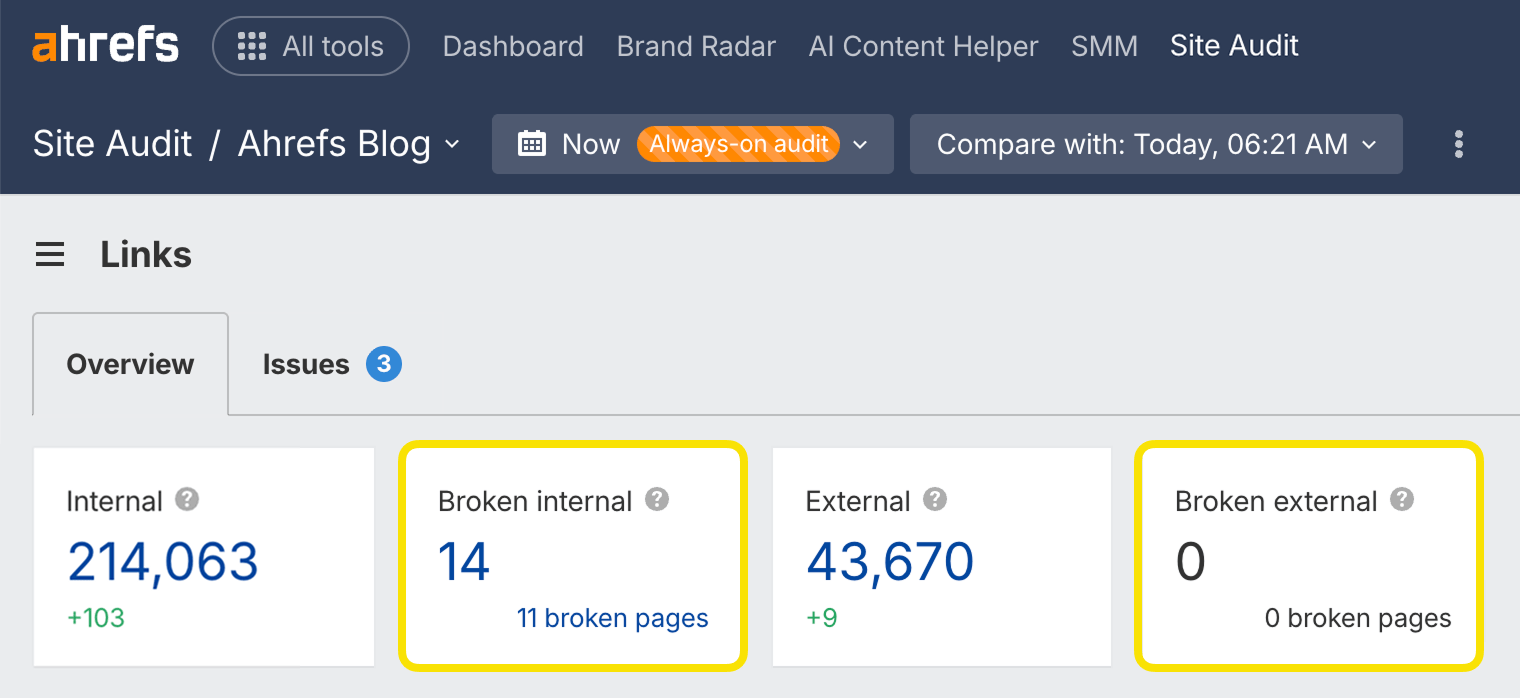

リンク切れ

リンク切れとは、自社サイト上にある、存在しないリソースに飛ぶリンクのことです。これは、内部リンク(つまり、同じドメイン内の他のページへのリンク)の場合も、外部リンク(つまり、他のドメイン上のページへのリンク)である場合もあります。

サイト監査のリンクレポートでウェブサイトのリンク切れを素早く見つけることができます。Ahrefs Free で利用が可能です。

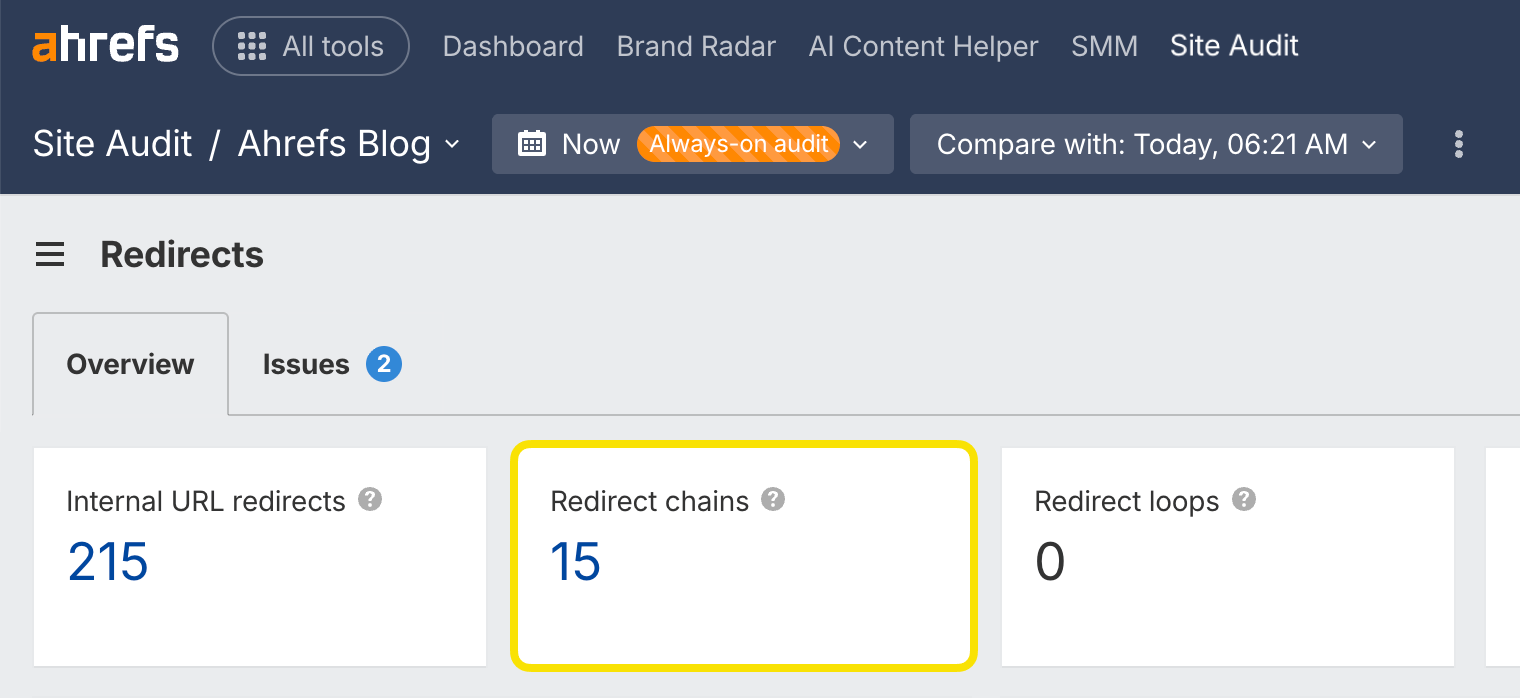

リダイレクトチェーン

リダイレクトチェーンとは、最初の URL と宛先 URL の間で発生する一連のリダイレクトのことです。

サイト監査のリダイレクトレポートでウェブサイトのリダイレクトチェーンを素早く見つけることができます。Ahrefs Free で利用できます。

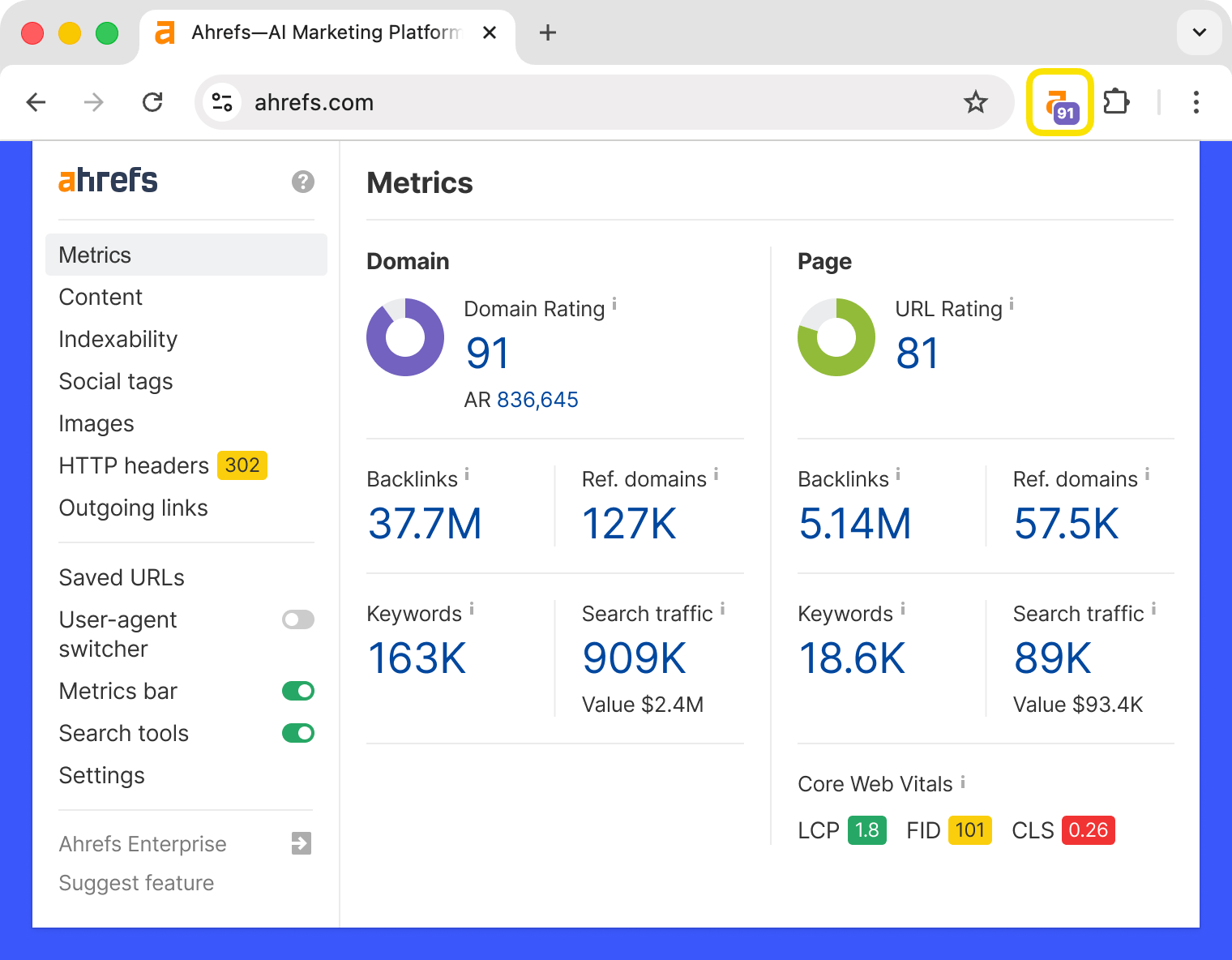

テクニカル SEO ツール

これらのツールは、ウェブサイトの技術面を改善するのに役立ちます。

Google Search Console(旧称:Google Webmaster Tools)は Google が提供する無料サービスで、ウェブサイトが検索結果でどのように表示されているかを調査したり、トラブルシューティングを行ったりするのに便利です。

技術的なエラーを見つけて修正し、サイトマップを提出し、構造化データの問題の確認などに使用します。

Bing と Yandex にはそれぞれ独自のバージョンを提供しており、Ahrefs も同様です。Ahrefs Free はウェブサイトの SEO パフォーマンス向上に役立ちます。以下のことが可能です。

- ウェブサイトの SEO の健全性を継続的にチェック。

- 100 種類以上の SEO の問題を調査。

- すべての被リンクを確認。

- 検索上位にランクインしているすべてのキーワードを表示。

- サイト上のページがどれくらいのトラフィックを獲得しているかを確認しましょう。

- 内部リンク構築の機会を見つける。

これが、Google Search Console の制限の問題に対して私たちが提示する解決策です。

Google のモバイルフレンドリーテストは、モバイル端末でのページの利用のしやすさをチェックするものです。文字が小さすぎて読みにくい、互換性のないプラグインを使用しているなど、ユーザー体験を低下させる問題点も特定します。

モバイルフレンドリーテストでは、Google がクロールした際にページがどのように表示されるかを確認できます。また、リッチリザルトテストを使用すると、Google がデスクトップ端末またはモバイル端末でどのようにコンテンツを表示しているかを確認できます。

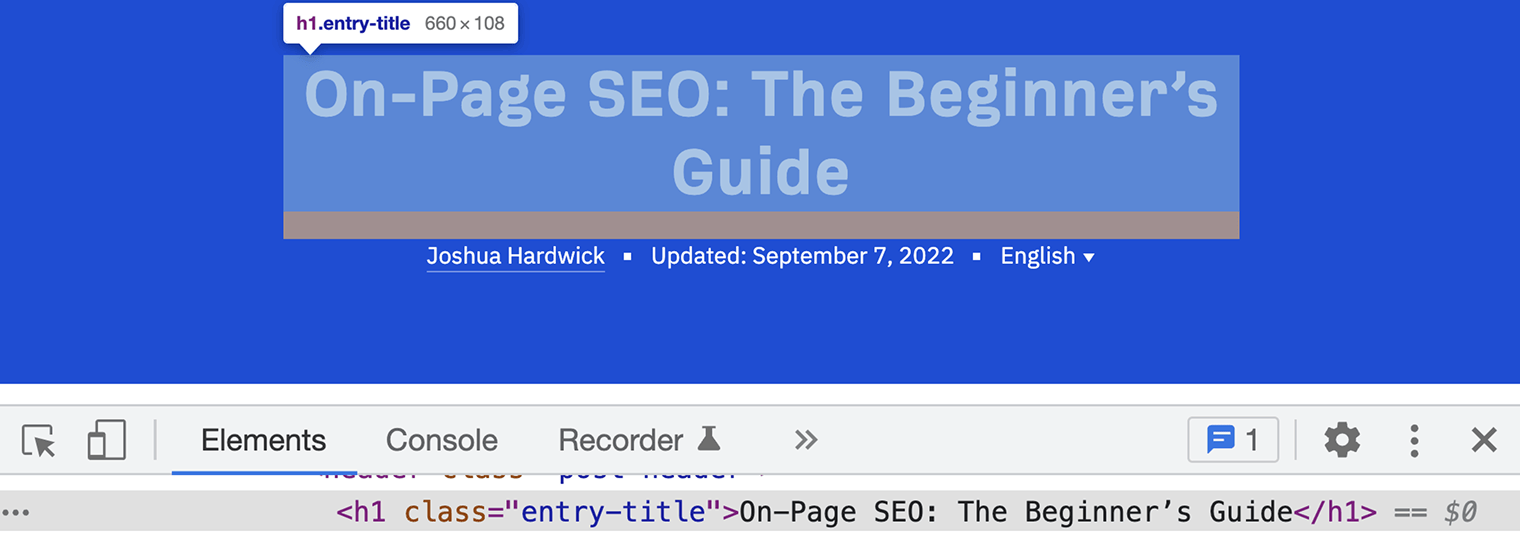

Chrome DevTools は、Chrome に組み込まれているウェブページデバッグツールです。これを使って、ページの表示速度の問題をデバッグしたり、ウェブページのレンダリングパフォーマンスを向上させたりすることができます。

テクニカル SEO の観点から、無限の用途があります。

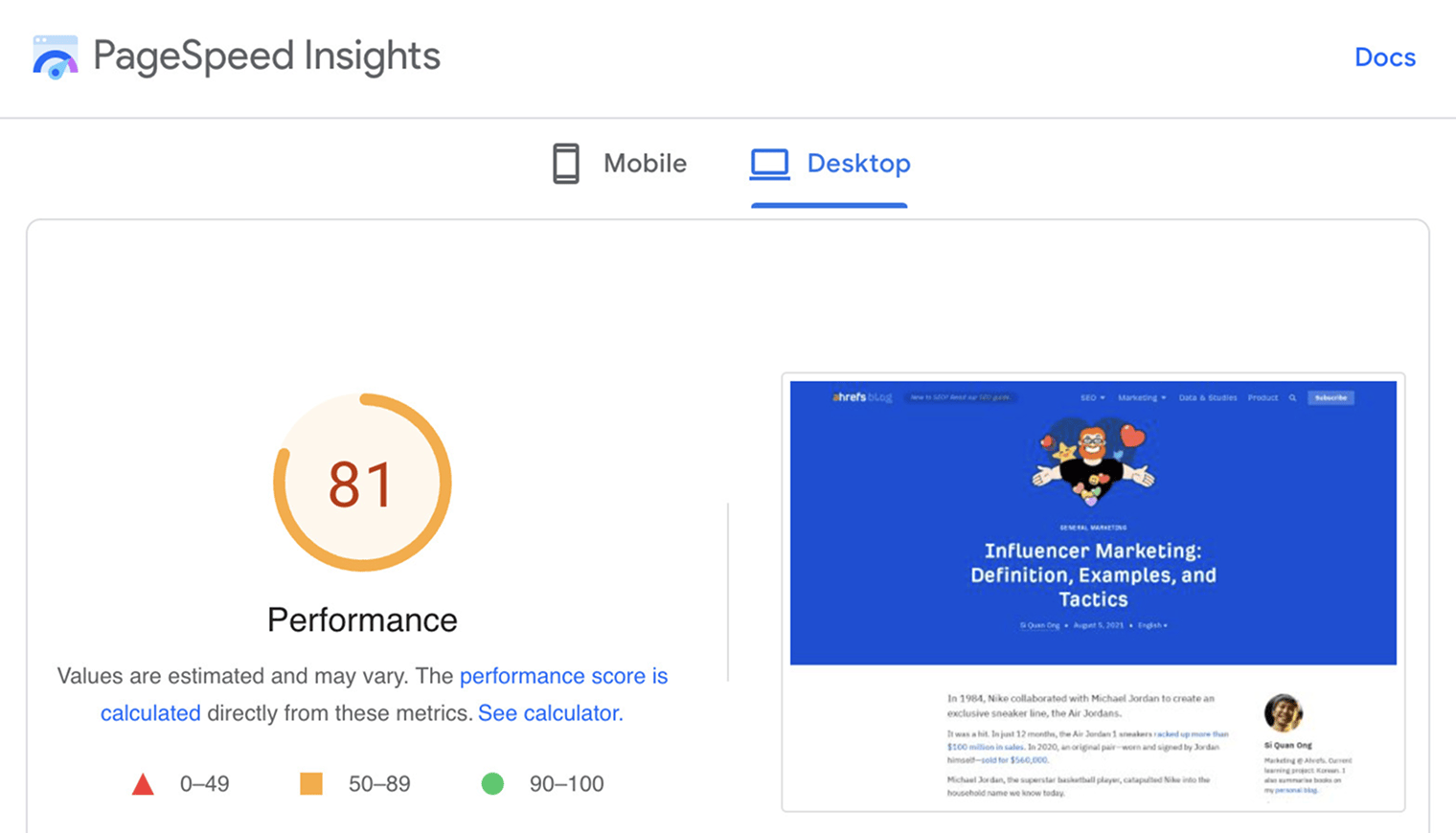

PageSpeed Insights は、ウェブページの読み込み速度を分析します。パフォーマンススコアとあわせて、ページの読み込みを高速化するために実行可能な推奨事項も表示します。

重要なポイント

- コンテンツがインデックスされていない場合、検索エンジンで見つけることができません。

- 検索トラフィックに影響を与えるような不具合が発生した場合は、それを優先的に修正すべきでしょう。しかし、ほとんどのサイトにとっては、コンテンツの改善やリンク構築に時間を費やす方が賢明です。

- 最も大きな影響を与えるテクニカル施策の多くは、インデックス化やリンク構築に関わるものです。

- テクニカル SEO は、AI 検索においても依然として重要です。構造が適切でクロールしやすいページにすることで、AI システムがコンテンツを見つけ、内容を理解し、参照・引用しやすくなります。

参照

- 「クロール遅延ルールは Googlebot によって無視されるのか?」。Google Search Central。2017 年 12 月 21 日

- 「Google ボットのクロールレートを変更」。Google。2022 年 9 月 9 日取得

- 「30x リダイレクトを使っても、もうページランクは失われない」。Gary Illyes。2016 年 7 月 26 日

パトリック・ストックスは、Ahrefs のプロダクトアドバイザー、テクニカル SEO 担当、およびブランドアンバサダーです。彼は 2021 年版 Web Almanac の SEO 関連章の主執筆者であり、2022 年版の SEO 関連章のレビューも担当しました。また、Ahrefs 制作「初心者のための SEO ブック」の共著者であり、SEO 解説書籍「The Art of SEO 第 4 版」のテクニカルレビューおよび編集も担当しました。Triangle SEO ミートアップと Tech SEO Connect カンファレンスの主催者であり、テクニカル SEO の Slack グループを運営し、Reddit の /r/TechSEO スレッドのモデレーターでもあります。

SEO をステップバイステップでマスター

検索エンジンの仕組み

SEO について学習する前に、まず検索エンジンの仕組みを理解しましょう。

SEO の基本

SEO を成功させるウェブサイト作りを学び、SEO における 4 つの主要な側面を理解します。

キーワードリサーチ

SEO の出発点は、ターゲットとなるお客様が何を求めて検索しているのかを理解することです。

SEO コンテンツ

検索エンジンで上位に表示されるコンテンツの作り方をご紹介します。

オンページ SEO

そして、検索エンジンが理解できるようにページを最適化することです。

リンク構築

検索エンジンで上位に表示されるコンテンツの作り方をご紹介します。

テクニカル SEO

Google がウェブサイトにアクセスしてサイトの内容を理解するのを妨げる技術的な問題を未然に防ぎましょう。

ローカル SEO

ローカル検索結果での可視性を向上させ、拠点地域でより多くの顧客を獲得する方法を学びましょう。

AI が SEO にもたらす変化

現在、生成 AI に触れずに SEO について語るのは、もはや不可能です。

AI 検索エンジンの仕組み

ChatGPT のような AI 検索エンジンが、どのように回答を生成し、どのブランドや商品に言及するかをどうやって決めているのかを理解しましょう。