Définition : des métriques d’expérience utilisateur selon Google

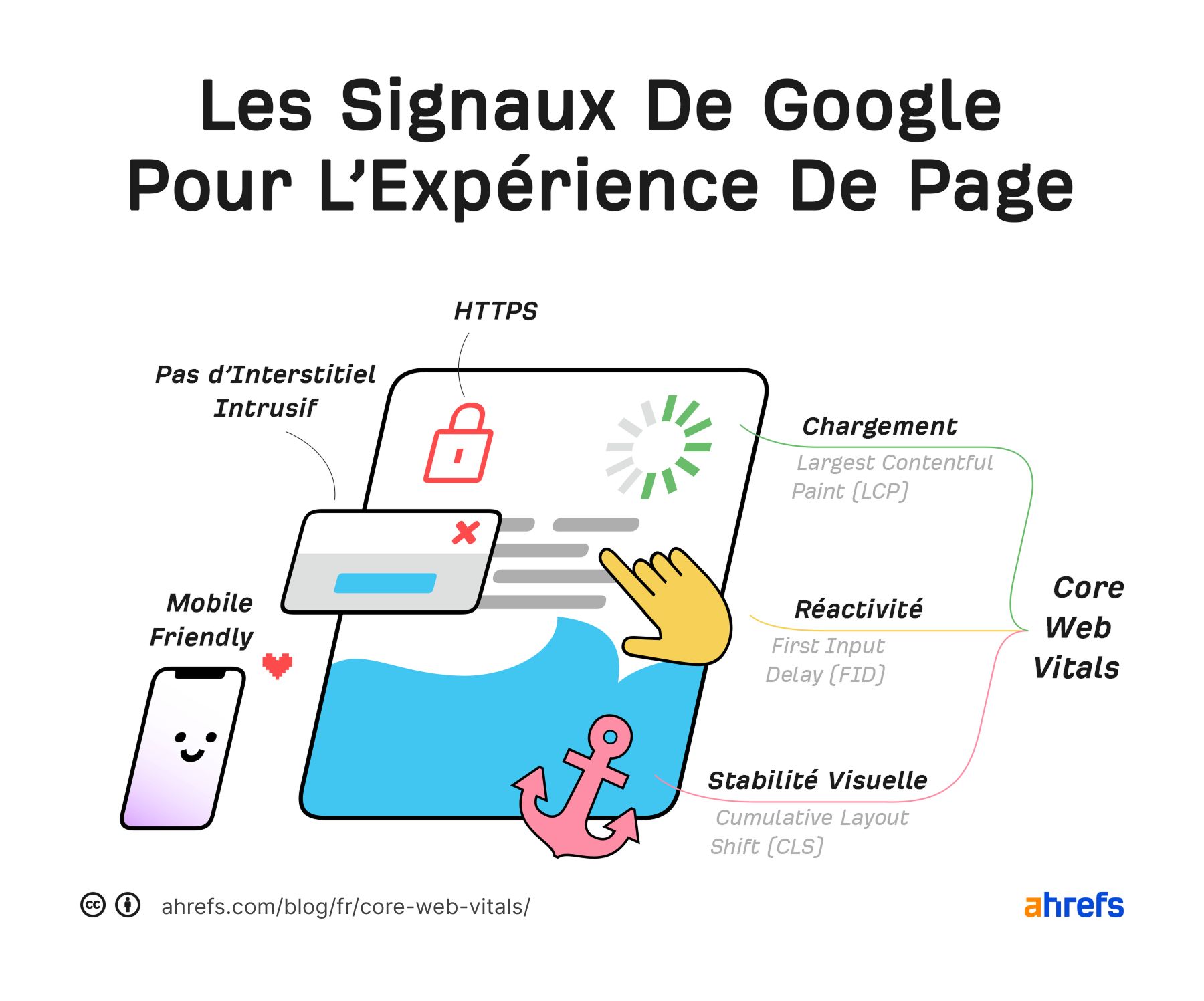

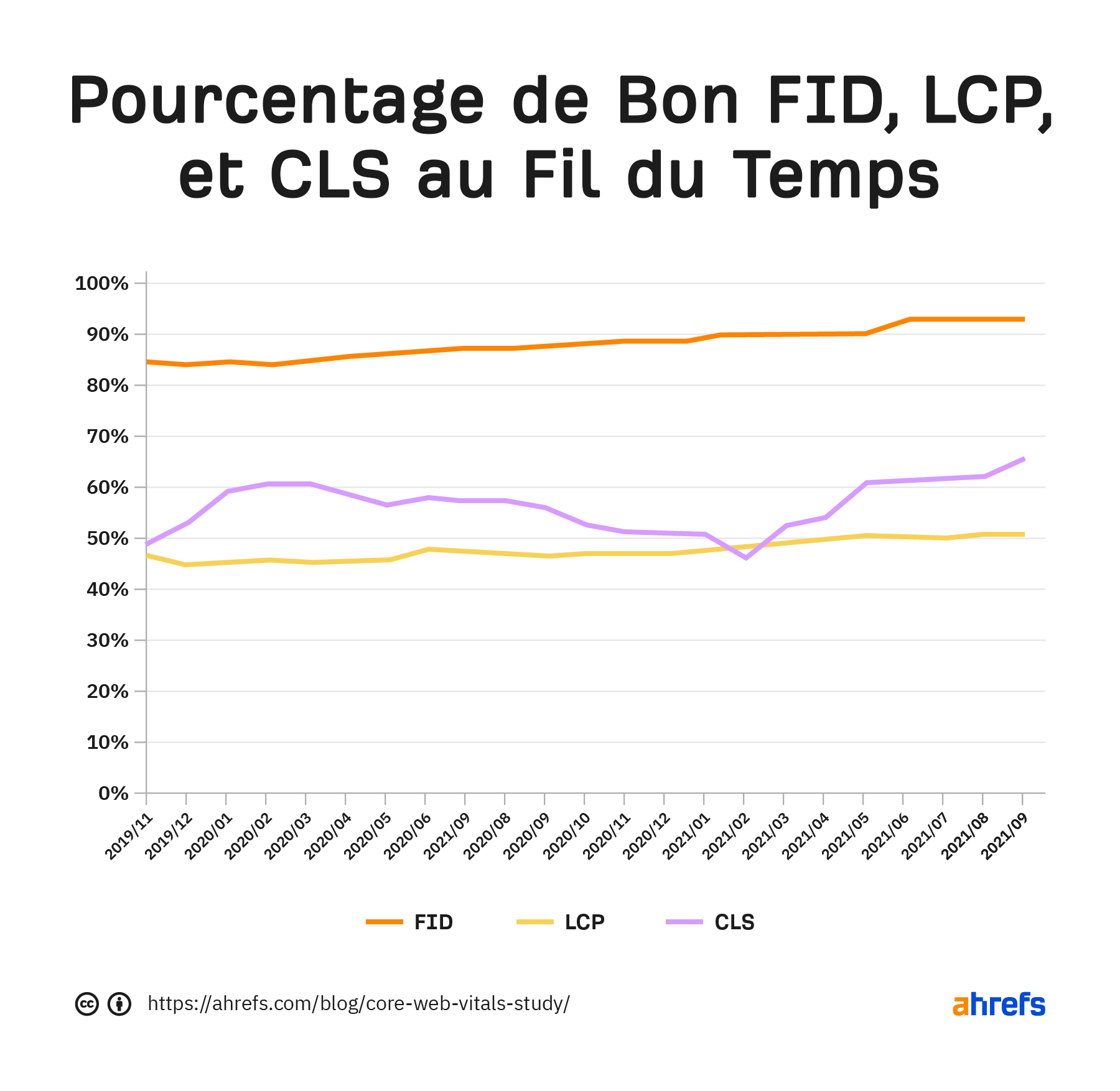

Les Core Web Vitals (CWV) sont des mesures de vitesse qui font partie des signaux de Page Experience de Google pour mesurer l’expérience utilisateur. Ces chiffres mesurent le chargement visuel avec le Largest Contentful Paint (LCP), la stabilité visuelle avec Cumulative Layout Shift (CLS) et l’interactivité avec le First Input Delay (FID).

L’expérience de page sur mobile et les Core Web Vitals qui vont avec ont été officiellement utilisées pour le classement des pages depuis mai 2021. Les signaux sur desktop sont utilisés depuis février 2022.

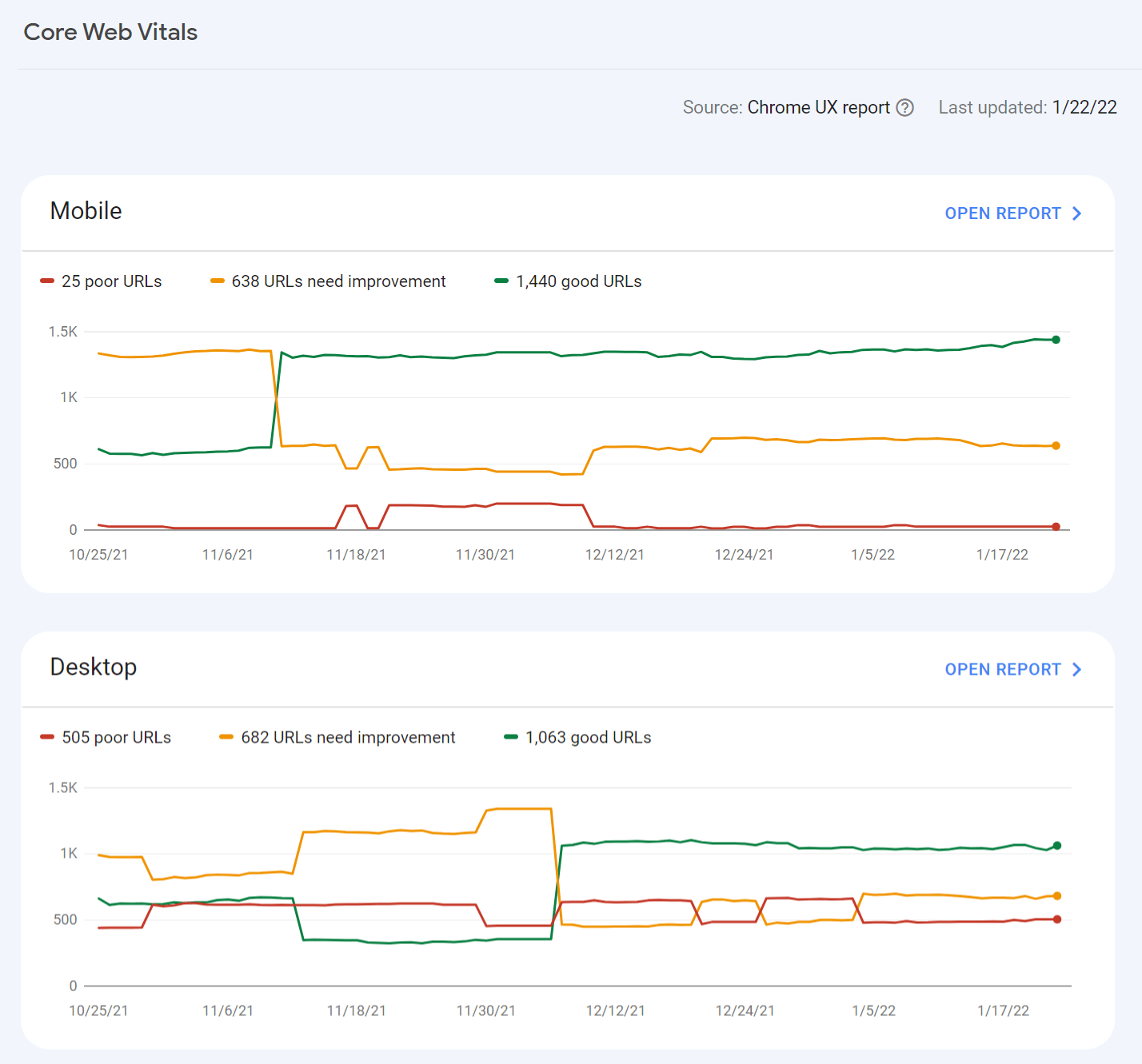

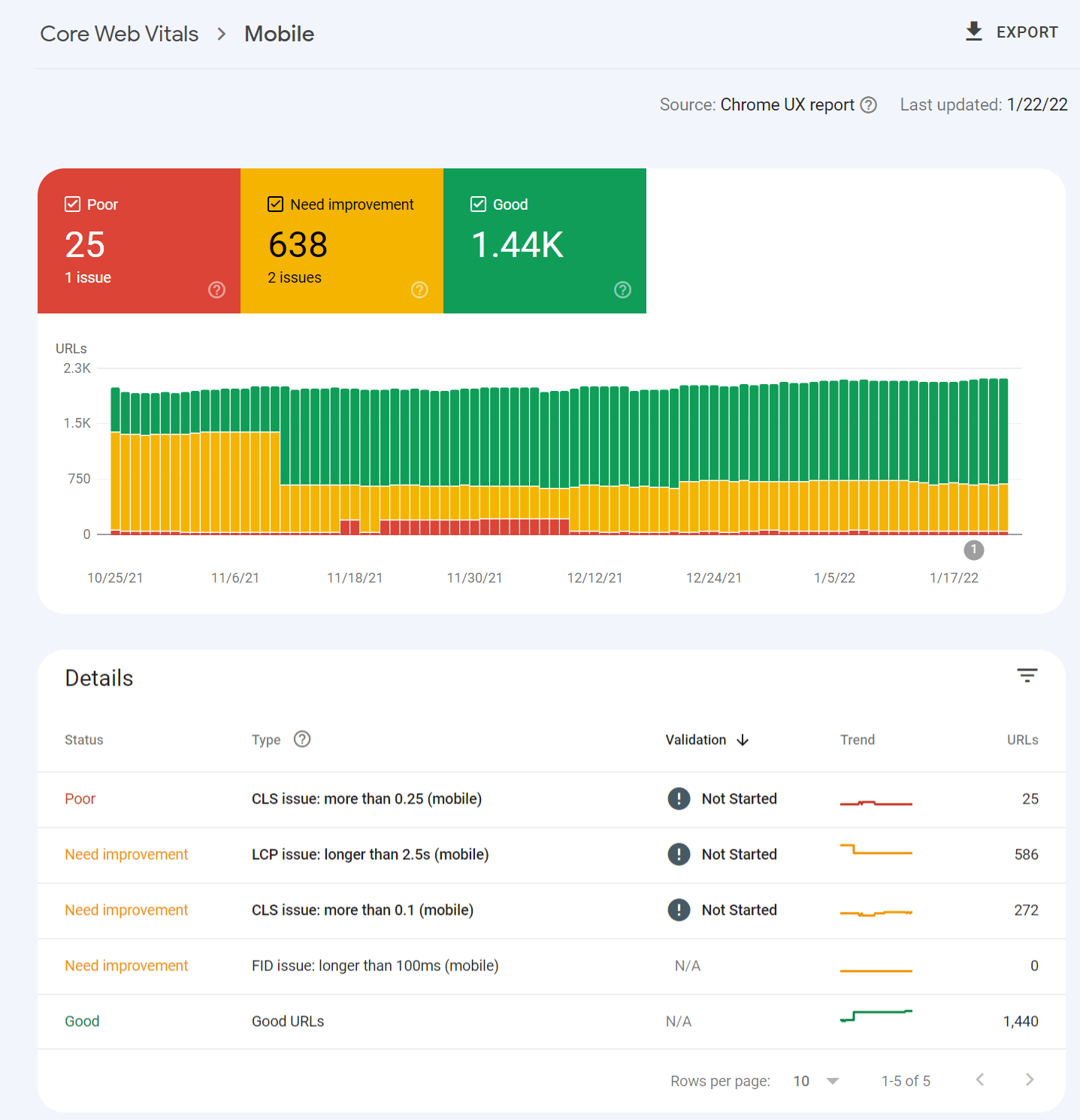

Le meilleur moyen pour connaître les mesures de votre site est de se rendre sur le rapport Core Web Vitals de la Google Search Console. Avec ce rapport, vous allez rapidement voir si vos pages sont classées dans “mauvaise URL”, “URL a besoin d’amélioration” ou “bonne URL”.

Les seuils pour chaque catégorie sont les suivants :

| Good | Needs improvement | Poor | |

|---|---|---|---|

| LCP | <=2.5s | <=4s | >4s |

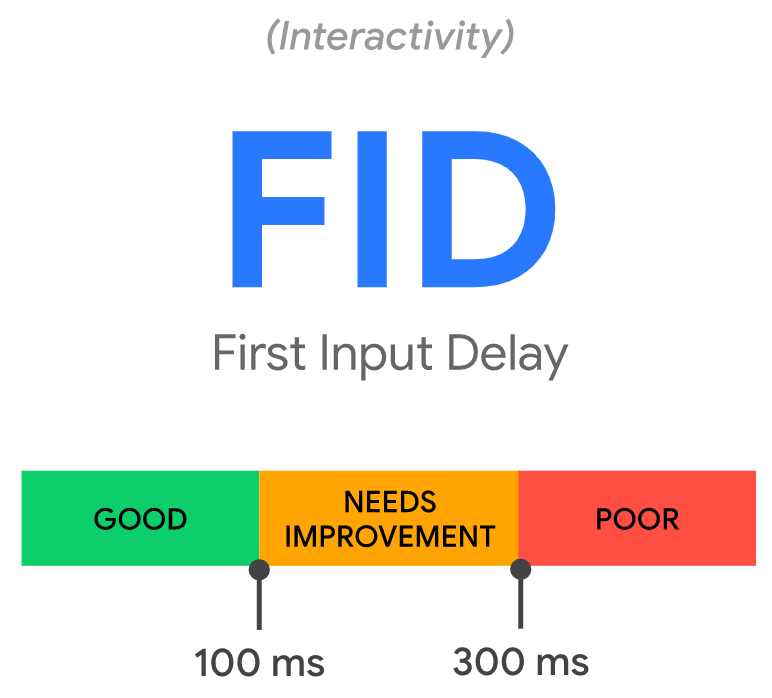

| FIDv | <=100ms | <=300ms | >300ms |

| CLS | <=0.1 | <=0.25 | >0.25 |

Ainsi, voici à quoi ressemble le rapport :

Si vous cliquez sur l’un de ces rapports, vous aurez plus de détails sur les typologies de problèmes ainsi que le nombre d’URL impactées.

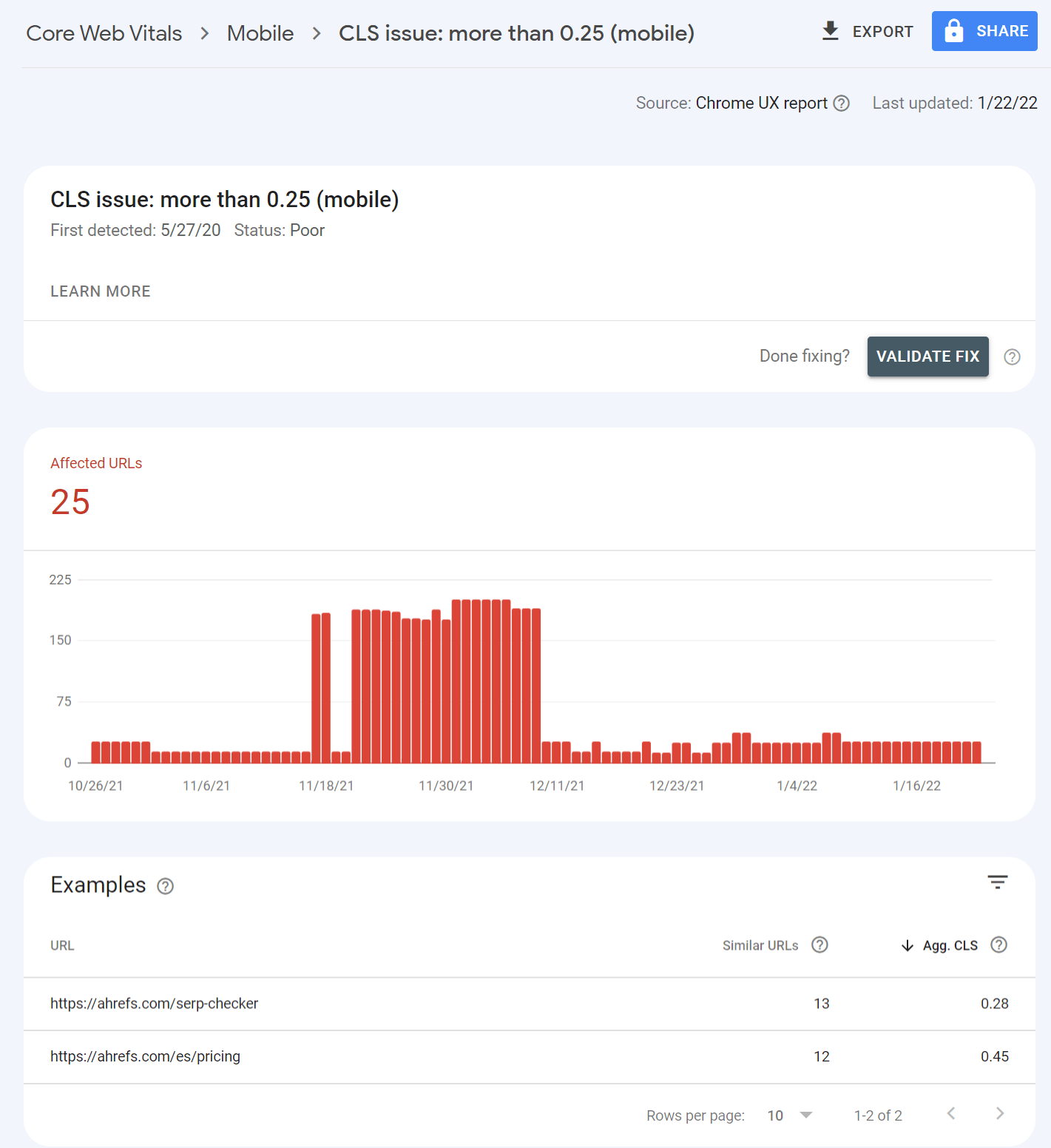

Cliquer sur l’un de ces problèmes va de nouveau vous donner plus de détails sur des groupes de pages qui sont affectées. Ce regroupement est logique, la plupart des modifications à faire pour améliorer les Core Web Vitals se font depuis un template de page spécifique qui va affecter plusieurs URL. Vous pouvez faire le changement une seule fois dans le template et les corrections vont se propager sur toutes les pages où le template s’applique.

Vous savez désormais quelles pages sont touchées précisément.

Voici quelques informations complémentaires sur les Core Web Vitals ainsi que comment faire passer les tests à vos pages :

- Quelques faits sur les Core Web Vitals

- Est-ce que les Core Web Vitals sont importants en SEO ?

- Composition des Core Web Vitals

- Outils pour mesurer les Core Web Vitals

Fait 1: Les mesures sont séparées entre version desktop (ordinateur) et version mobile. Les signaux mobiles sont utilisés pour le ranking sur mobile et les signaux desktop pour le ranking sur desktop.

Fait 2: Les données viennent du Chrome User Experience Report (CrUX), qui enregistre des données d’utilisateurs Chrome qui ont accepté de les partager. Ces mesures sont prises à mesure du 75e percentile d’utilisateur. Par conséquent, si 70% des utilisateurs ont une expérience de page “bonne”, et 5% sont dans la catégorie “besoin d’amélioration”, alors votre page sera indiquée dans “besoin d’amélioration”.

Fait 3: Les mesures sont prises pour chaque page. Mais s’il n’y a pas assez de données, “les signaux des parties d’un site ou du site en général peuvent être utilisés” déclare John Mueller, Webmaster Trend Analyste de Google. Dans notre étude de données Core Web Vitals, nous avons analysé plus de 42 millions de pages et avons découvert que seules 11.4% d’entre elles avaient des mesures associées.

Fait 4: Avec l’ajout de ces nouvelles mesures, Accelerated Mobile Pages (AMP) n’est plus un prérequis pour être dans les Tops Stories sur mobile. Comme ces news stories n’auront pas réellement de données sur les mesures de vitesse, il est possible que ce soient les mesures d’une plus grande catégorie de page, voire du domaine en entier, qui soient utilisées.

Fait 5: Single Page Application ne peut pas calculer deux mesures, FID et LCP, via les transitions de pages. Il y a quelques propositions de changement, dont App History API et potentiellement un changement de mesure de l’interactivité qui pourrait être appelé Responsiveness pour le temps de réaction d’une page.

Fait 6: Les mesures peuvent changer au fil du temps, tout comme le seuil. Google a déjà fait évoluer ses calculs pour mesurer la vitesse dans ses outils au fil des années, ainsi que le seuil de ce qui était considéré comme étant rapide ou non.

Les Core Web Vitals ont déjà changé, et il y a déjà d’autres changements proposés pour le futur. Typiquement, je ne serais pas surpris que la taille de page soit ajoutée. Actuellement, vous pouvez réussir à obtenir de bons scores dans les mesures actuelles en réglant les priorités de certains éléments, même avec une très grande page. Je pense que cela devrait changer par la suite.

Parmi les facteurs de Google pour se positionner, beaucoup n’ont pas beaucoup d’importance. Pour ce qui est des Core Web Vitals, les représentants de Google disent qu’ils ont une faible importance, ou bien peuvent servir d’aide à la décision en cas d’égalité.

Gary Illyes, de l’équipe Google Search, l’a résumé lors de Pubcon en septembre 2023 :

“La plupart des sites ne bénéficieront pas vraiment de l’amélioration de leurs Core Web Vitals.” — Gary Illyes (@methode), Pubcon, 21 sept. 2023

Je ne m’attends pas à beaucoup de changements (voire aucun) dans l’amélioration du SEO d’un site en optimisant les Core Web Vitals. Cela dit, ils restent un facteur, et ce tweet de John Mueller montre comment cela peut fonctionner comme signal de départage.

Il y a eu beaucoup de facteurs de ranking qui prenaient en considération la vitesse pendant de nombreuses années. Je ne m’attendais donc pas à un gros impact visible lorsque la mise à jour d’expérience de la page sur mobile a été déployée. Malheureusement, il y a eu également plusieurs Google Core Updates pendant cette période, ce qui rend difficile de réellement mesurer des impacts ou tirer des conclusions fiables.

Certaines études montrent des corrélations positives entre avoir un bon score en termes de Core Web Vitals et de meilleurs résultats dans les SERP. Mais j’y porte un regard sceptique. Ce serait comme dire que ce sont les sites qui se concentrent sur le SEO qui ont tendance à mieux ranker. Si un site travaille à améliorer ses CWV, il a certainement déjà fait beaucoup d’efforts sur d’autres points aussi.

Ce que vous devez retenir : les CWV ne vont probablement pas transformer votre SEO du jour au lendemain. En revanche, ils ont un impact direct sur l’expérience utilisateur; et donc sur vos taux de conversion et de rétention. Si votre site est déjà bien optimisé sur tous les autres points, améliorer vos CWV peut faire la différence face à des concurrents aux scores similaires.

Données réelles vs données de lab : quelle différence ?

La différence entre les deux est simple : les données de terrain (field data) viennent de vrais utilisateurs qui visitent votre site, via le Chrome User Experience Report (CrUX). C’est ce que Google utilise pour le classement. Les données de laboratoire (lab data) sont produites dans un environnement simulé et contrôlé — c’est ce que vous voyez dans Lighthouse, PageSpeed Insights ou Chrome DevTools. Elles ne reflètent pas votre classement, mais elles sont reproductibles et utiles pour tester vos corrections.

Les deux peuvent afficher des scores très différents pour une même page, et c’est normal. Un vrai utilisateur arrive souvent avec du cache, sur un réseau variable, depuis un appareil que vous n’avez pas simulé. Par ailleurs, l’INP ne peut pas être mesuré en lab : comme cette métrique dépend des vraies interactions, les outils de lab utilisent à la place le Total Blocking Time (TBT) comme indicateur proxy.

| Données terrain | Données de lab | |

|---|---|---|

| Source | Vrais utilisateurs (CrUX) | Environnement simulé (Lighthouse) |

| Utilisées par Google | ✅ Oui | ❌ Non |

| Reproductibles | ❌ Variable | ✅ Oui |

| INP mesurable | ✅ Oui | ❌ Non (TBT à la place) |

| Idéal pour | Diagnostiquer, suivre | Tester des corrections |

En pratique, servez-vous des données terrain pour savoir où vous en êtes aux yeux de Google, et des données de lab pour diagnostiquer et tester. Les deux sont complémentaires. Notez que les données CrUX ont un délai de 28 jours : après une optimisation, il faudra patienter avant de voir le résultat remonter dans Search Console.

Voici les trois composants actuels des Core Web Vitals et ce qu’ils mesurent :

- Largest Contentful Paint (LCP) : Chargement visuel

- Interaction to Next Paint (INP) : Interactivité

- Cumulative Layout Shift (CLS) : Stabilité visuelle

Il faut savoir qu’il existe d’autres Web Vitals qui servent de mesures proxy et des mesures supplémentaires qui ne sont pas utilisées dans les calculs de ranking. On va en parler dans la section Web Vitals secondaires.

Le LCP est l’élément visible le plus grand qui soit chargé dans le viewport.

Source: web.dev

L’élément le plus grand est généralement l’image mise en avant ou peut-être la balise h1, mais cela peut être également :

- Élément <img>

- Élément <image> dans un élément <svg>

- Image dans un élément <video>

- Image de fond chargée avec la fonction url()

- Blocs de texte

les <svg> et <video> pourraient être ajoutés dans le futur.

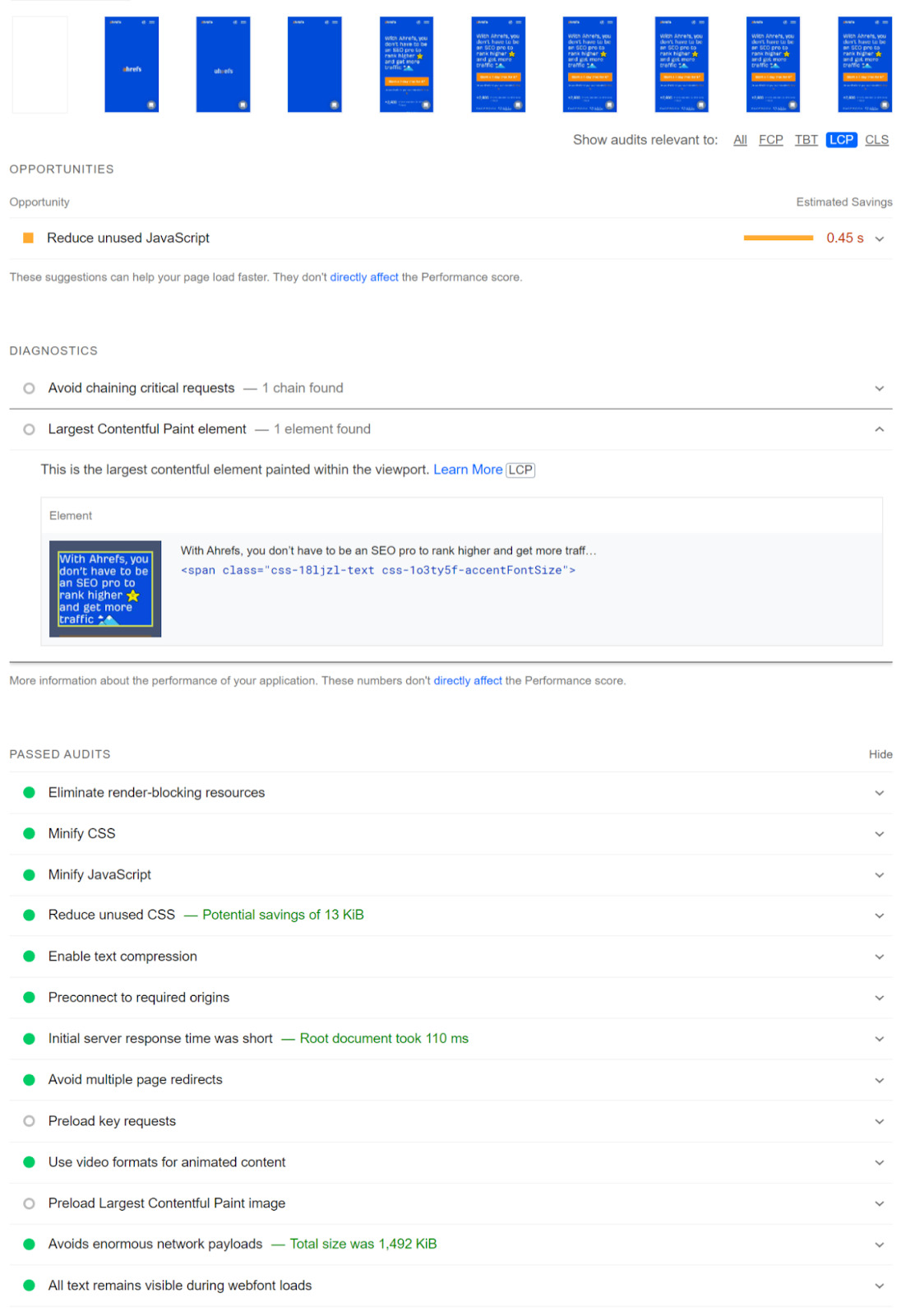

Comment voir le LCP ?

Dans PageSpeed Insights l’élément LCP sera spécifié dans la section “Diagnostic”. Remarquez également qu’il y a un onglet pour sélectionner LCP pour ne voir que les éléments qui le concernent.

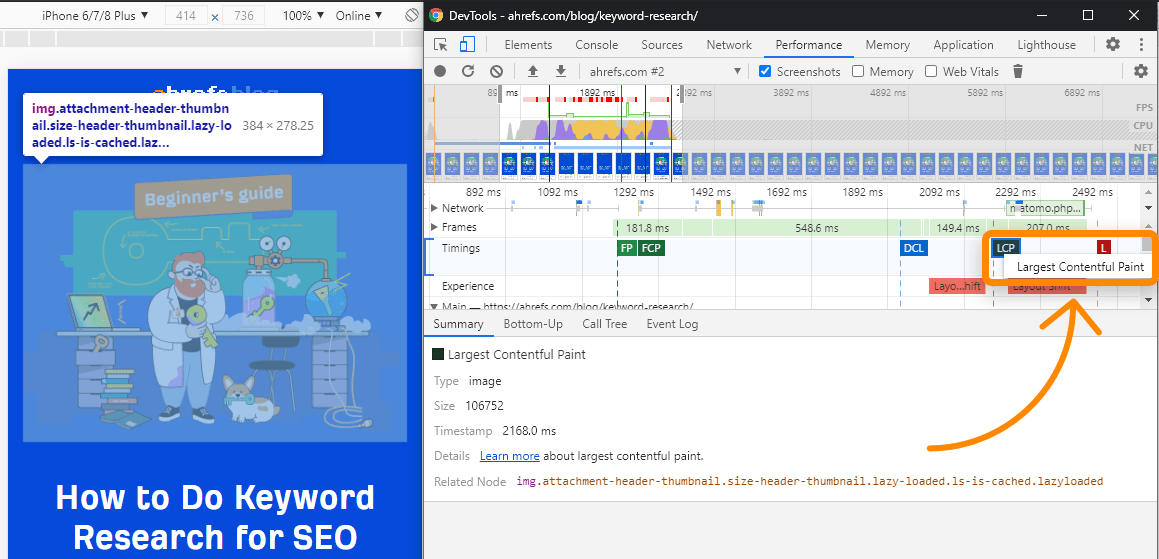

Dans Chrome DevTools, suivez ces étapes :

- Performance > sélectionnez “Screenshots”

- Cliquez sur “Start profiling and reload page”

- LCP est sur le graphique temporel

- Cliquez sur le node, c’est l’élément pour le LCP

Optimiser le LCP en 5 étapes

Comme nous avons pu le voir sur PageSpeed Insights, il y a beaucoup de problèmes qui doivent être corrigés, ce qui fait du LCP la mesure la plus difficile à améliorer. Dans notre étude, j’ai remarqué que la plupart des sites n’ont pas beaucoup amélioré le LCP au fil du temps.

Voici quelques éléments à garder en tête sur les différentes manières d’améliorer le LCP.

Je vous liste les 5 étapes pour améliorer le LCP ici et après, je les développe un par un :

- Réduire la taille de vos fichiers

- Être proche du serveur

- Utiliser le même serveur

- Mettre en cache

- Prioriser les ressources

On entre dans le détail de chaque étape maintenant :

1. Plus petit = plus rapide

Si vous ne pouvez vous débarrasser de n’importe quel fichier ou réduire sa taille, votre page va charger plus vite. Vous pouvez vouloir supprimer tout fichier ou morceau de code qui ne sont pas utilisés.

La manière dont vous allez vous y prendre va beaucoup dépendre de comment votre site est fait, mais on parle du processus comme du a href=“https://webpack.js.org/guides/tree-shaking/”>tree shaking (secouer l’arbre). C’est généralement géré de manière automatique dans beaucoup de systèmes, mais pour certains, cela va demander des efforts.

Il y a également la compression, qui va réduire la taille des fichiers. Quasiment tous les types de fichiers utilisés pour construire votre site peuvent être compressés, comme le CSS, le JavaScript, les Images et le HTML.

2. Plus près = plus rapide

L’information ne se transmet pas instantanément, il lui faut du temps. Plus vous êtes loin du serveur, plus il faudra de temps pour transmettre les données. À moins que vous ne vous concentriez exclusivement sur une petite zone géographique, avoir un Content Delivery Network (CDN) est une bonne idée.

Les CDN sont un bon moyen de faire passer votre site par un serveur plus proche des utilisateurs. C’est un peu comme avoir des copies de votre serveur à différents endroits du monde.

3. Si possible, utilisez le même serveur

Lorsque vous vous connectez la première fois à un serveur, un processus parcourt le web pour établir une connexion sécurisée entre l’utilisateur et le serveur. Cela prend un peu de temps, et chaque nouvelle connexion nécessaire va ajouter du délai supplémentaire pour répéter le processus. Si toutes vos ressources sont sur le même serveur, cela va vous permettre d’éliminer ces délais supplémentaires.

Si vous ne pouvez pas utiliser le même serveur, vous pouvez vous trouver vers le preconnect ou le DNS-prefetch pour que les connexions se déclenchent plus tôt. Un navigateur va en général atteindre la fin du téléchargement du HTML pour commencer les connexions. Mais avec du preconnect et du DNS-prefetch, les connexions vont se déclencher plus tôt que la normale. Notez que le DNS-prefetch est mieux supporté que preconnect.

4. Mettez en cache ce que vous pouvez

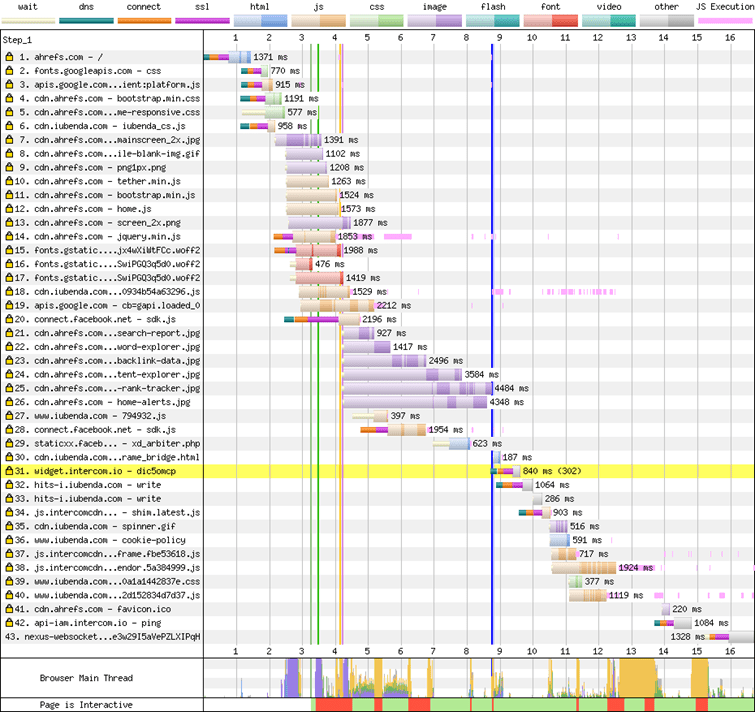

Lorsque vous mettez des ressources en cache, elles sont téléchargées lors de la première vue de la page, mais n’auront pas besoin d’être à nouveau téléchargées avec les nouvelles vues. Avec des ressources directement accessibles, les futurs chargements de page seront plus rapides. Voyez dans le tableau en cascade ci-dessous, la différence entre le premier et le second chargement de page.

Premier chargement de la page :

Second chargement de la page :

5. Priorisez les ressources

Pour réussir la vérification LCP, vous devez donner des ordres de priorité sur comment les ressources sont chargées dans le critical rendering path. Vous devez réorganiser l’ordre dans lequel les ressources sont téléchargées et traitées. Il faut commencer par celles que vous voulez que votre utilisateur voit en premier, puis charger le reste ensuite.

Beaucoup de sites peuvent passer le LCP en ajoutant simplement des règles de preload pour certaines choses comme l’image principale ou les feuilles de styles et polices nécessaires. Voyons comment optimiser ces différents types de ressources.

LES IMAGES PLUS TÔT

Si vous n’avez pas besoin de l’image, la meilleure solution est tout simplement de s’en débarrasser. Si vous avez besoin de l’image, il faut en optimiser la taille et la qualité pour la rendre la plus légère possible.

Vous pouvez en plus précharger l’image (preload). Cela va lancer le téléchargement de l’image un peu plus tôt. Elle apparaîtra donc plus vite. Une déclaration de preload pour une image ressemble à ça :

<link rel="preload" as="image" href=“cat.jpg"

imagesrcset=“cat_400px.jpg 400w,

cat_800px.jpg 800w, cat_1600px.jpg 1600w"

imagesizes="50vw">

LES IMAGES PLUS TARD

On appelle cette étape le lazy loading des images non critiques.

Vous devriez charger plus tardivement (lazy load) les images dont vos utilisateurs n’ont pas besoin dans l’immédiat.. Cela déclenche le chargement de l’image plus tard dans le processus ou lorsque l’utilisateur scrolle jusqu’à elle. Vous pouvez utiliser le loading=”lazy” comme ceci :

<img src=“cat.jpg" alt=“cat" loading="lazy">

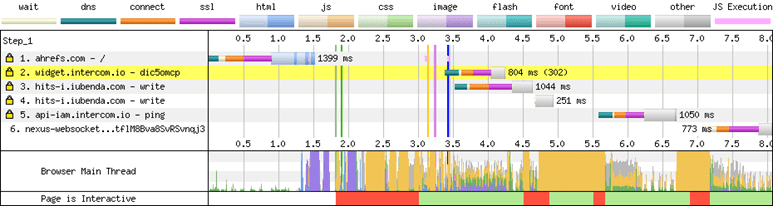

LE CSS PLUS TÔT

Nous avons déjà parlé du fait de retirer le CSS inutilisé et de minifier celui qui reste. L’autre chose à faire est de charger le CSS critique inline. Cela prend les parties du CSS nécessaires pour charger les éléments que l’utilisateur doit voir immédiatement pour l’appliquer directement dans le HTML. Lorsqu’il est téléchargé, tout le CSS nécessaire pour charger ce que voit l’utilisateur est déjà disponible.

LE CSS PLUS TARD

Pour tout le CSS supplémentaire qui n’est pas critique (nécessaire à l’affichage immédiat), il devrait être chargé plus tard dans le processus. Vous pouvez commencer le téléchargement du CSS avec une déclaration de preload mais ne l’appliquer que plus tard avec un event onload, ça ressemble à ça :

<link rel="preload" href="stylesheet.css" as="style" onload="this.rel='stylesheet'">

FONTS (POLICES)

Voici plusieurs options possibles selon mon avis :

Bien : Préchargez vos polices. C’est encore mieux si vous utilisez le même serveur pour éviter toute connexion.

Mieux : Font-display: optional. Cela peut être fait avec une déclaration de preload. Cela va donner à votre police un court laps de temps pour charger. Si elle ne charge pas à temps, le chargement initial de la page se fera avec une font par défaut. Votre police personnalisée sera mise en cache et apparaîtra lors des prochains chargements de page.

Parfait : utilisez une police système. Il n’y a rien à charger, donc pas de délai.

LE JAVASCRIPT PLUS TÔT

Nous avons déjà parlé de supprimer le Javascript non utilisé et minifier celui qui reste. Si vous utilisez un framework JavaScript, vous pouvez soit pré-rendre la page ou la rendre server-side (SSR).

Vos autres options sont de rendre le JavaScript nécessaire tôt dans le chargement inline. Cela fonctionne de la même manière que le CSS, où vous chargez des portions du code dans le HTML ou préchargez les fichiers JavaScript pour les avoir disponibles plus tôt. Cela ne doit être fait que pour des éléments nécessaires pour charger du contenu au-dessus du fold (c’est-à-dire la partie visible avant d’avoir besoin de scroller) ou si certaines fonctionnalités dépendent du JavaScript.

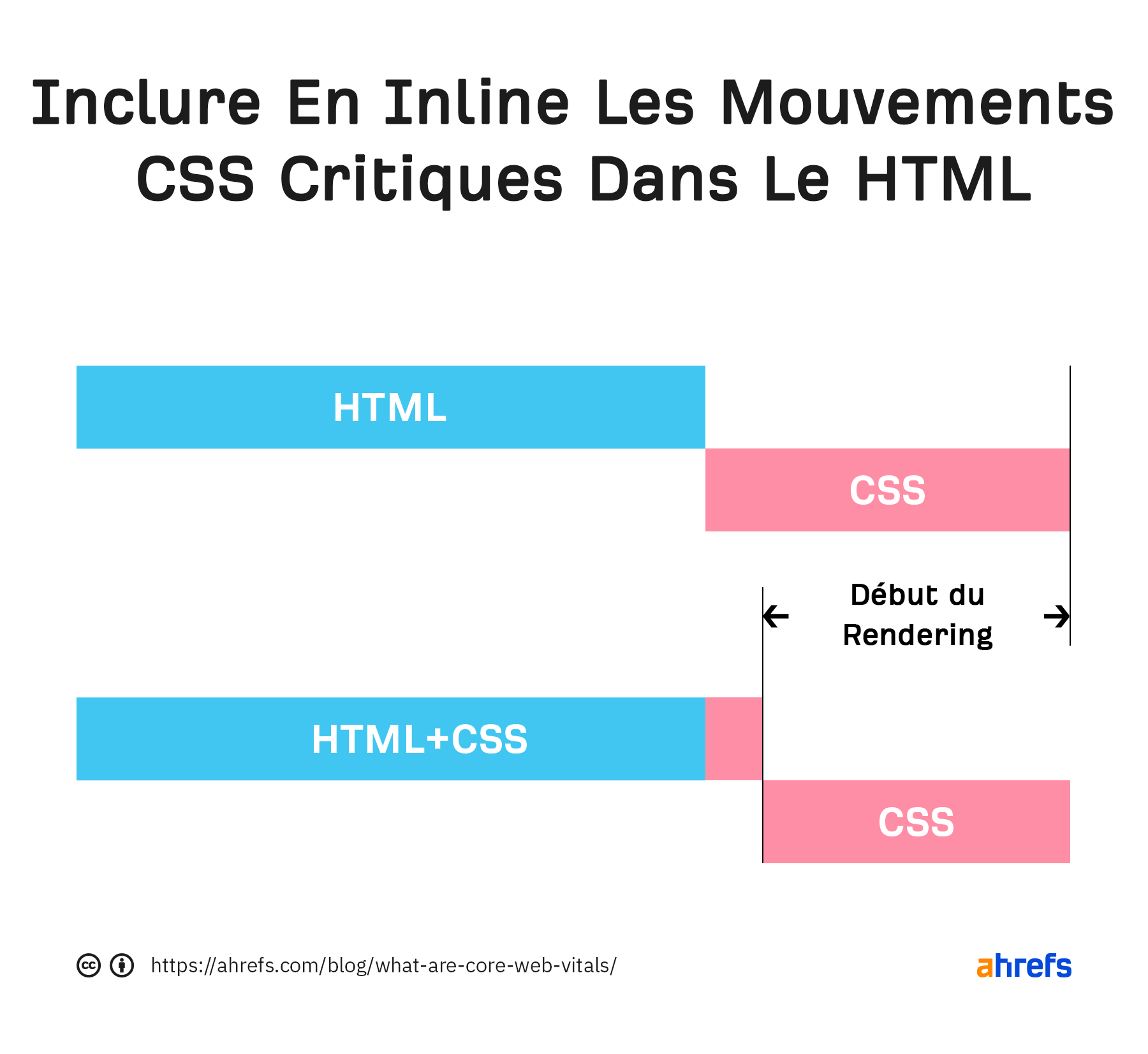

LE JAVASCRIPT PLUS TARD

Tout Javascript dont vous n’avez pas besoin immédiatement devrait être chargé plus tard. Il y a deux manières de faire cela : les attributs defer et async. Ces attributs peuvent être ajoutés dans les balises de vos scripts.

Généralement, le téléchargement d’un script bloque le parser pendant le téléchargement et l’exécution. Async (asynchronisation) va permettre le parsing et le téléchargement de se produire en même temps, mais bloquera tout de même le parsing pendant l’exécution. Le Defer (retardement) ne bloquera pas le parsing pendant le téléchargement et ne s’exécutera que lorsque le HTML aura fini son parsing.

Quelle méthode choisir ? Pour tout ce que vous voulez assez tôt ou qui est nécessaire à d’autres fonctions, je pencherais pour l’async. J’utiliserais, par exemple, l’async pour qu’une balise analytics enregistre plus d’utilisateurs. Il vaut mieux defer tout ce qui n’est pas immédiatement nécessaire ou n’est pas nécessaire à autre chose. Ces attributs sont assez simples à ajouter, voici des exemples :

Normal:

<script src="https://www.domain.com/file.js"></script>

Async:

<script src="https://www.domain.com/file.js" async></script>

Defer:

<script src="https://www.domain.com/file.js" defer></script>

Divers

Il existe encore d’autres technologies que vous pourriez vouloir explorer pour améliorer les performances, par exemple : Speculative Prerendering, Early Hints, Signed Exchanges, and HTTP/3.

Resources

- Optimize Largest Contentful Paint – web.dev

- Investigating Largest Contentful Paint – Paul Irish (video)

- How to Improve Page Speed From Start to Finish – Ahrefs

Pourquoi l’INP a remplacé le FID ?

L’INP a officiellement remplacé le First Input Delay (FID) le 12 mars 2024. Ce changement n’est pas anodin : le FID ne mesurait que le délai avant la première interaction d’un utilisateur sur une page. C’était une fenêtre trop étroite, qui ne reflétait pas la réactivité réelle d’une page tout au long de la session.

L’INP mesure toutes les interactions (clics, tapotements, pressions de touches) et retient la pire au 75e percentile. Si un utilisateur clique dix fois sur votre page et que neuf interactions sont instantanées mais qu’une seule est lente, c’est cette lenteur que l’INP va capturer. C’est beaucoup plus exigeant, et beaucoup plus représentatif de ce que vit vraiment l’utilisateur.

Seuils INP : bon, à améliorer, mauvais

| Bon | À améliorer | Mauvais | |

|---|---|---|---|

| INP | ≤ 200 ms | ≤ 500 ms | > 500 ms |

Comment mesurer l’INP ?

Pour diagnostiquer l’INP, utilisez à la place le Total Blocking Time (TBT) comme proxy dans PageSpeed Insights et Lighthouse. Un TBT élevé est un bon indicateur d’un INP potentiellement problématique.

Pour les données terrain réelles, rendez-vous dans :

- Le rapport Core Web Vitals de la Google Search Console

- L’onglet “Données terrain” de PageSpeed Insights (si votre page a suffisamment de trafic dans CrUX)

- L’extension Chrome Web Vitals pour mesurer en temps réel en naviguant sur votre site

Comment améliorer l’INP ?

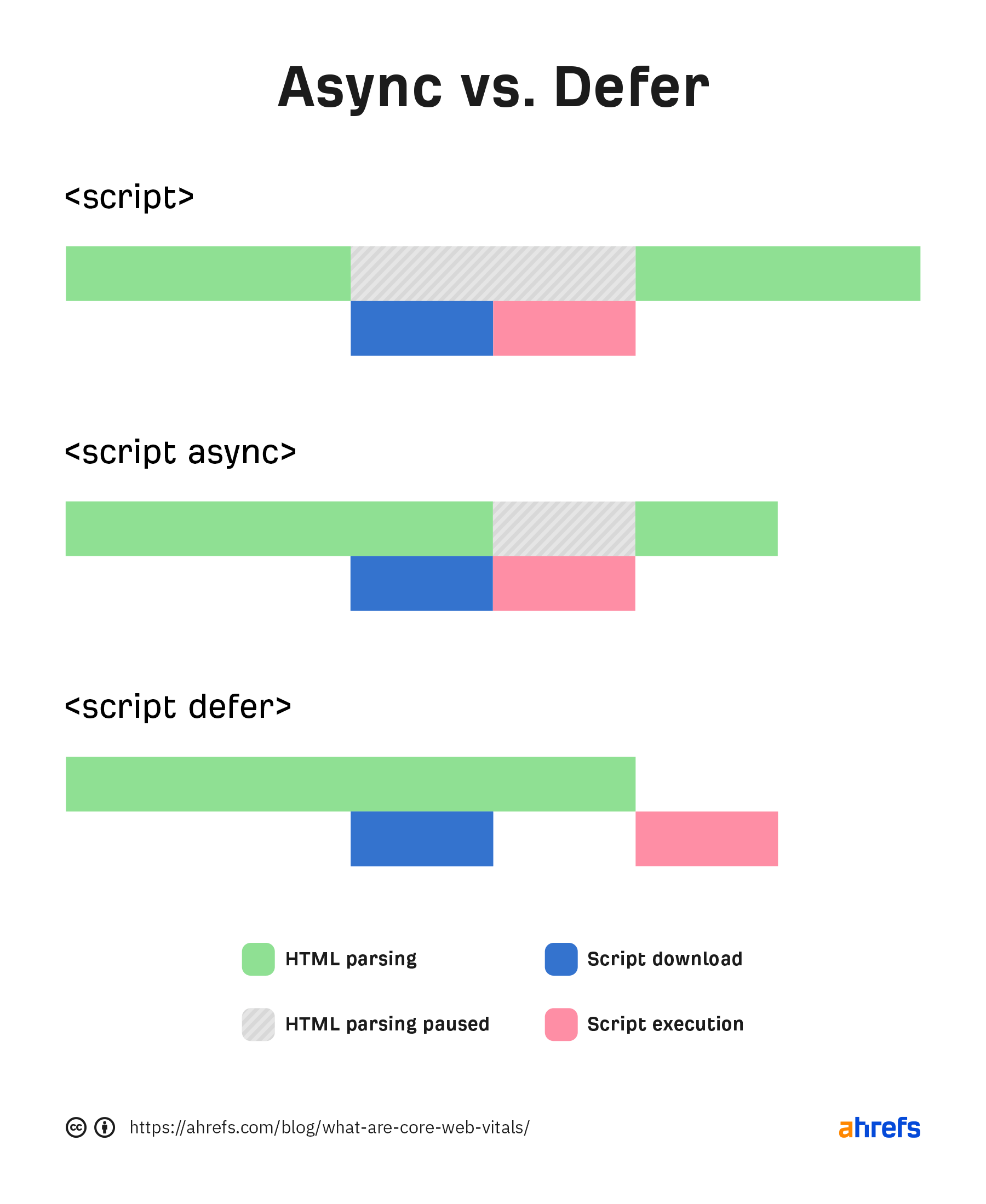

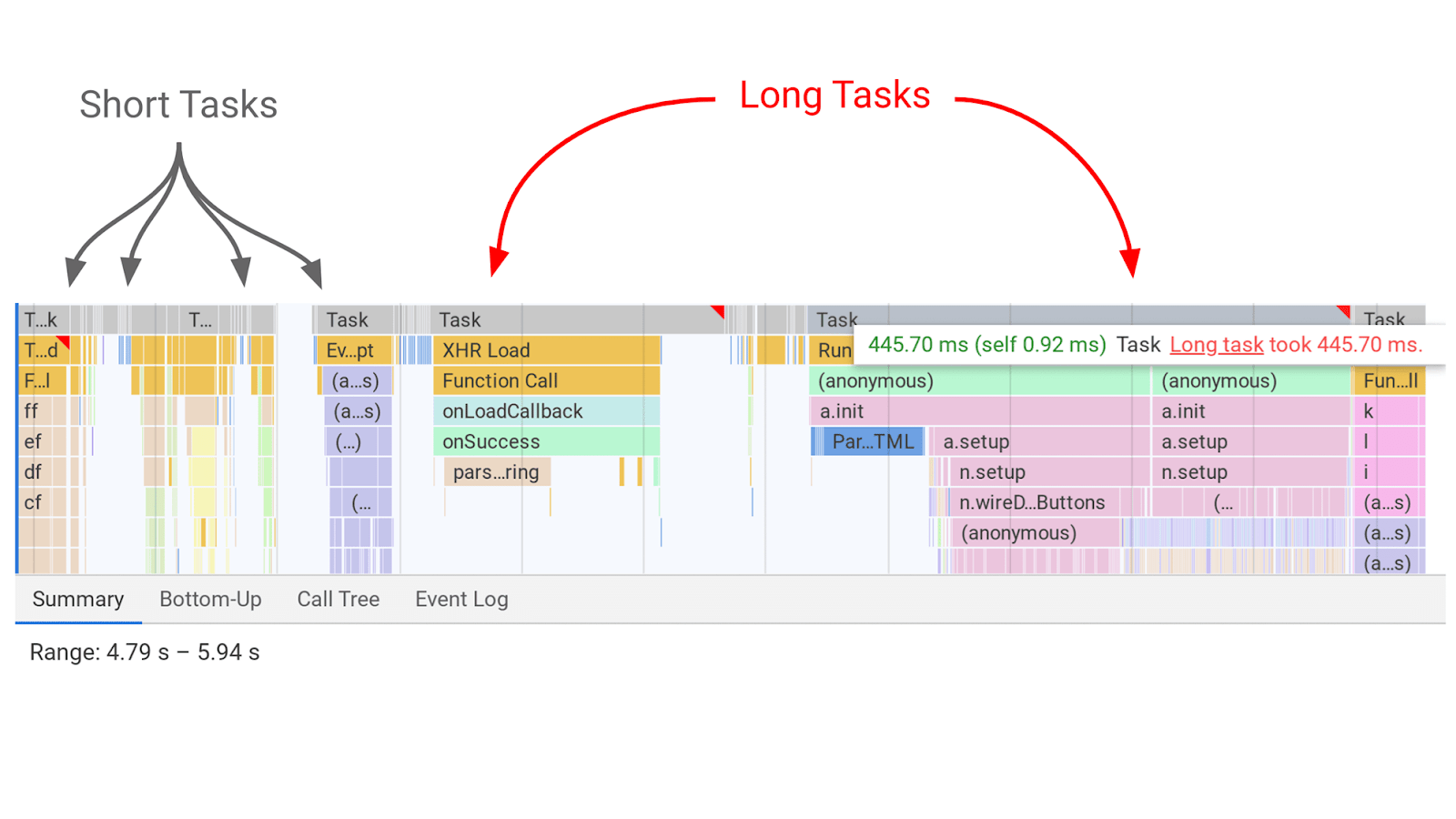

La cause principale d’un mauvais INP est le même que pour le FID : c’est le JavaScript qui entre en compétition pour le main thread. Il n’y a qu’un seul main thread, et le JavaScript doit prendre son tour pour s’exécuter. Pendant qu’une tâche est en cours, la page ne peut pas répondre aux interactions de l’utilisateur, c’est le délai que l’on ressent.

Source : web.dev

Pour améliorer l’INP, vous pouvez aussi :

- Réduire le temps d’exécution JavaScript et supprimez le JavaScript inutilisé

- Éviter les tâches longues (long tasks) ou divisez le JavaScript en plus petits blocs

- Utiliser les Web Workers pour les traitements lourds

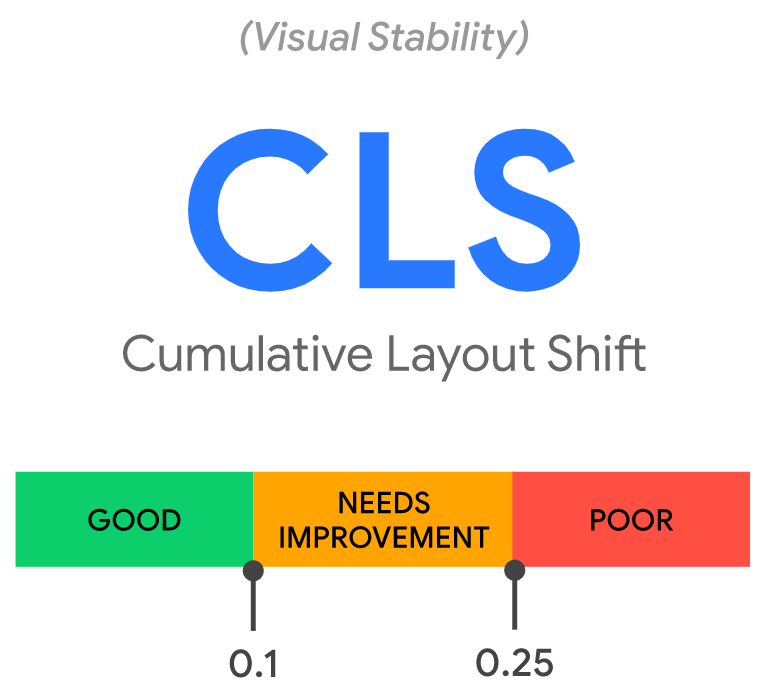

Qu’est-ce qui provoque un CLS élevé ?

Le CLS mesure la façon dont les éléments bougent et la stabilité de l’organisation de la page. Il va prendre en compte la taille du contenu et la distance sur laquelle il va bouger. Google a déjà mis à jour la manière dont le CLS est mesuré : auparavant, il continuait sa mesure après le chargement initial de la page. Dorénavant, il se restreint aux 5 secondes où il y a le plus de changement.

Il peut être agaçant de vouloir cliquer sur quelque chose sur une page qui va soudainement bouger et vous faire cliquer sur quelque chose d’autre. Je veux cliquer sur quelque chose et, subitement, une pub se met à la place et je me retrouve sur un autre site. En tant qu’utilisateur, c’est frustrant.

Parmi les principales causes de CLS, on retrouve :

- Les images sans dimensions

- Les pubs, embeds et iframes sans dimensions

- L’injection de contenu avec du JavaScript

- L’application tardive de polices ou styles

Seuils CLS : bon, à améliorer, mauvais

| Bon | À améliorer | Mauvais | |

|---|---|---|---|

| CLS | ≤ 0,1 | ≤ 0,25 | > 0,25 |

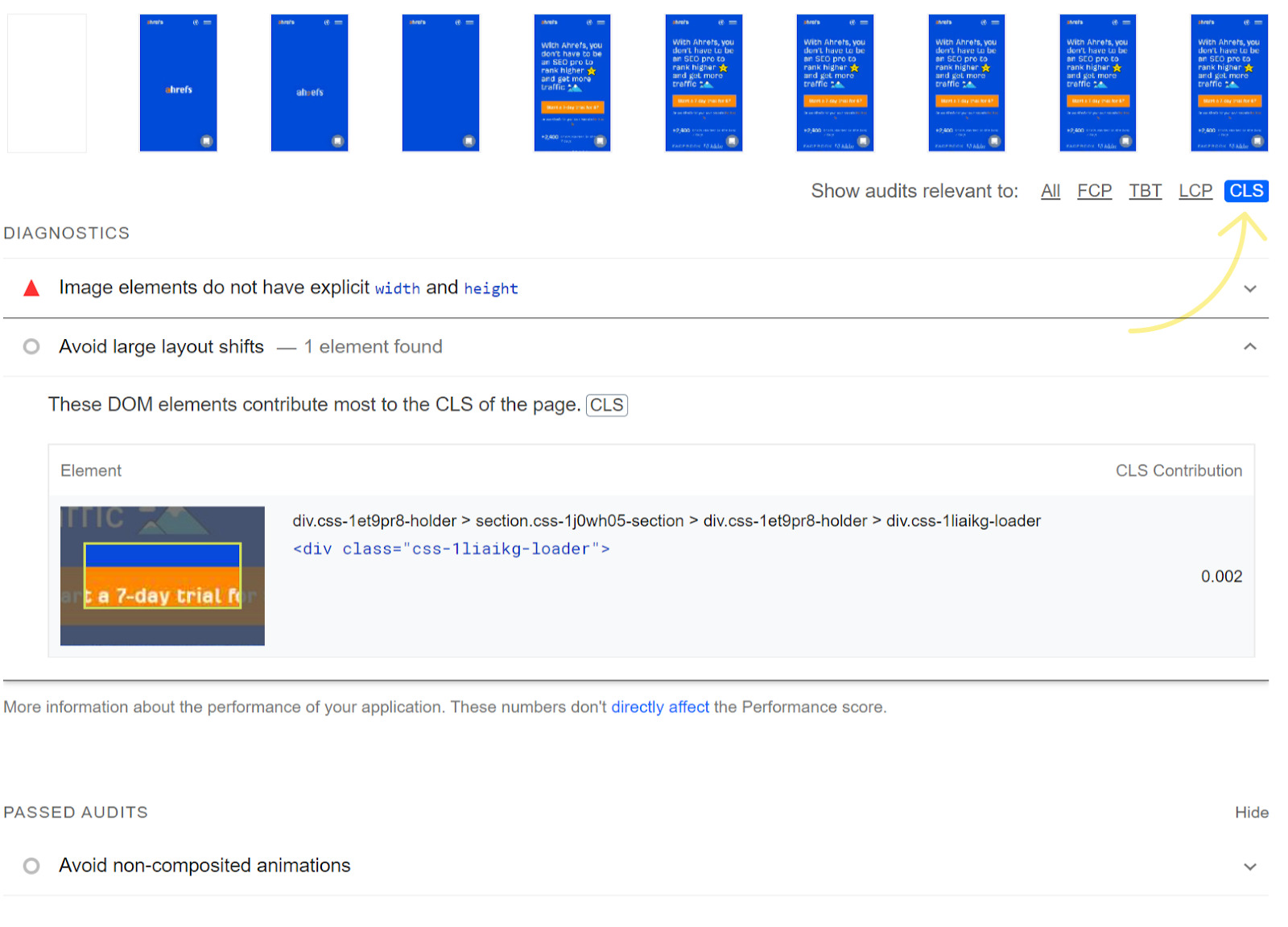

Comment mesurer le CLS ?

En sélectionnant le CLS dans PageSpeed Insights, vous pouvez voir tous les problèmes. Celui auquel il faut porter une attention particulière est “Avoid large layout shifts.”

Dans Chrome DevTools, l’onglet Performance met en évidence les layout shifts directement sur la timeline. Vous pouvez également utiliser l’extension Chrome Web Vitals pour voir le score CLS en temps réel pendant que vous naviguez sur votre site.

Comment améliorer le CLS ?

Dans la plupart des cas, vous allez devoir travailler autour des images, des polices et possiblement du contenu injecté pour optimiser le CLS.

Réserver l’espace pour les images et vidéos (width/height)

Pour les images, vous devez réserver l’espace pour qu’il n’y ait pas de changement brusque et que l’image se contente de remplir l’espace alloué. Cela veut dire définir la hauteur et la largeur des images à l’intérieur de la balise <img> :

<img

width="1000"

height="1000"

src="puppy-1000.jpg"

srcset="puppy-1000.jpg 1000w, puppy-2000.jpg 2000w, puppy-3000.jpg 3000w"

alt="Puppy with balloons" />Ces attributs permettent au navigateur de réserver l’espace exact avant même que l’image soit téléchargée. Appliquez le même principe aux éléments <video> et <iframe>.

Éviter les publicités et embeds sans dimensions définies

Réservez l’espace maximal nécessaire pour du contenu dynamique comme des pubs. Si vous ne connaissez pas la taille exacte à l’avance, définissez un espace minimum avec une hauteur fixe en CSS pour éviter que le contenu autour soit déplacé lors du chargement.

Gérer les polices web (font-display, preload)

Lorsqu’une police est chargée ou changée, vous allez avoir un changement visible comme un Flash of Invisible Text (FOIT) ou Flash of Unstyled Text (FOUT). Pour les polices, votre but est qu’elles apparaissent dès que possible sans s’interchanger.

Si vous pouvez utiliser une police système, faites-le. S’il n’y a rien à charger, il n’y aura ni délai ni changement.

Si vous utilisez une police personnalisée, combinez <link rel="preload"> (qui va essayer de charger votre police dès que possible) avec font-display: optional (qui va donner à votre police un court laps de temps pour charger). Si la police ne parvient pas à se charger à temps, la page initiale va simplement montrer la police par défaut. Votre police personnalisée va être mise en cache et sera montrée aux prochains chargements de page.

Lorsque le contenu est inséré dynamiquement par-dessus du contenu existant, cela va causer un mouvement. Si vous devez le faire, pensez à réserver de l’espace à l’avance.

Ressources :

Ces métriques ne font pas partie des Core Web Vitals et ne sont pas utilisées directement dans le classement. Elles servent de métriques proxy : améliorer l’une d’elles a un impact direct sur vos scores LCP ou INP.

TTFB (Time to First Byte) : temps de réponse serveur

Le TTFB mesure le temps entre la requête du navigateur et la réception du premier octet de réponse du serveur. C’est la base de tout : un TTFB lent pénalise mécaniquement votre LCP, quelle que soit la qualité de vos autres optimisations.

| Bon | À améliorer | Mauvais |

|---|---|---|

| ≤ 800 ms | ≤ 1 800 ms | > 1 800 ms |

Pour l’améliorer : hébergement performant, mise en cache serveur, CDN, et activation d’Early Hints.

FCP (First Contentful Paint) : premier rendu

Le FCP mesure le temps jusqu’à ce que le premier élément (texte, image, SVG) soit affiché à l’écran. Il précède toujours le LCP et sert d’indicateur intermédiaire : si votre FCP est lent, votre LCP le sera forcément aussi.

| Bon | À améliorer | Mauvais |

|---|---|---|

| ≤ 1,8 s | ≤ 3 s | > 3 s |

Pour l’améliorer : éliminer les ressources bloquant le rendu (CSS et JS render-blocking), réduire le TTFB.

TBT (Total Blocking Time) : proxy de l’interactivité

Le TBT mesure la durée totale pendant laquelle le main thread est bloqué entre le FCP et le Time to Interactive. C’est le proxy lab de l’INP : puisque l’INP ne peut pas être mesuré en environnement de laboratoire, un TBT élevé est le signal à surveiller dans Lighthouse et PageSpeed Insights.

| Bon | À améliorer | Mauvais |

|---|---|---|

| ≤ 200 ms | ≤ 600 ms | > 600 ms |

Pour l’améliorer : réduire les long tasks JavaScript, différer les scripts non critiques (defer/async).

Il existe beaucoup d’outils pour mesurer et suivre ces données. L’idéal est de voir les données réelles du terrain, qui seront les véritables bases de mesure de Google. Mais des données “de lab” seront plus utiles pour faire des tests.

La plupart de ces outils utilisent Lighthouse comme base pour les tests. Les données terrain viennent de CrUX.

Chrome DevTools : analyse page par page

Utile pour débugger en profondeur. L’onglet Performance donne accès à la timeline de chargement, aux long tasks et à l’élément LCP. Vous pouvez aussi voir les layout shifts directement sur la timeline.

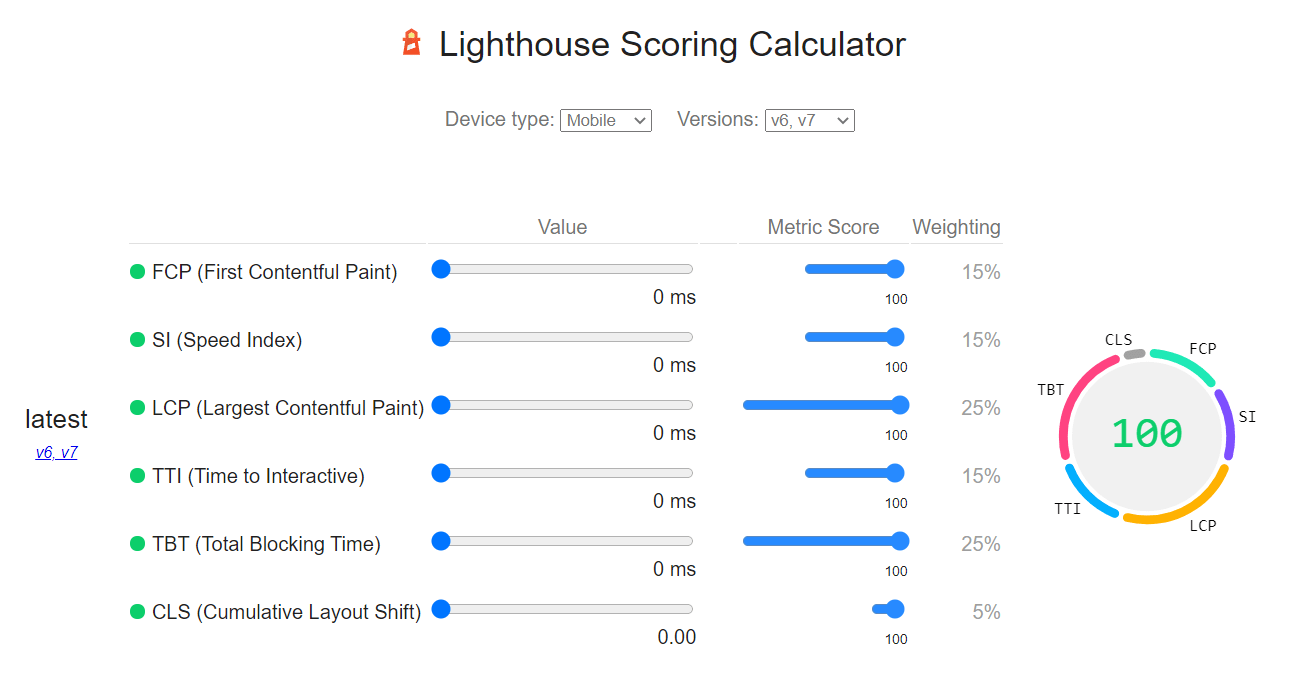

Lighthouse : audit complet en local

Lighthouse est intégré à Chrome DevTools (onglet Lighthouse) et génère un rapport complet avec scores et recommandations. Attention : ce sont des données de lab et les scores peuvent différer de vos données terrain. Vous pouvez aussi consulter le scoring calculator Lighthouse pour comprendre l’historique des changements de pondération.

L’extension Chrome Web Vitals

La Web Vitals extension affiche LCP, INP et CLS en temps réel pendant que vous naviguez sur n’importe quelle page. Pratique pour un diagnostic rapide sans ouvrir DevTools.

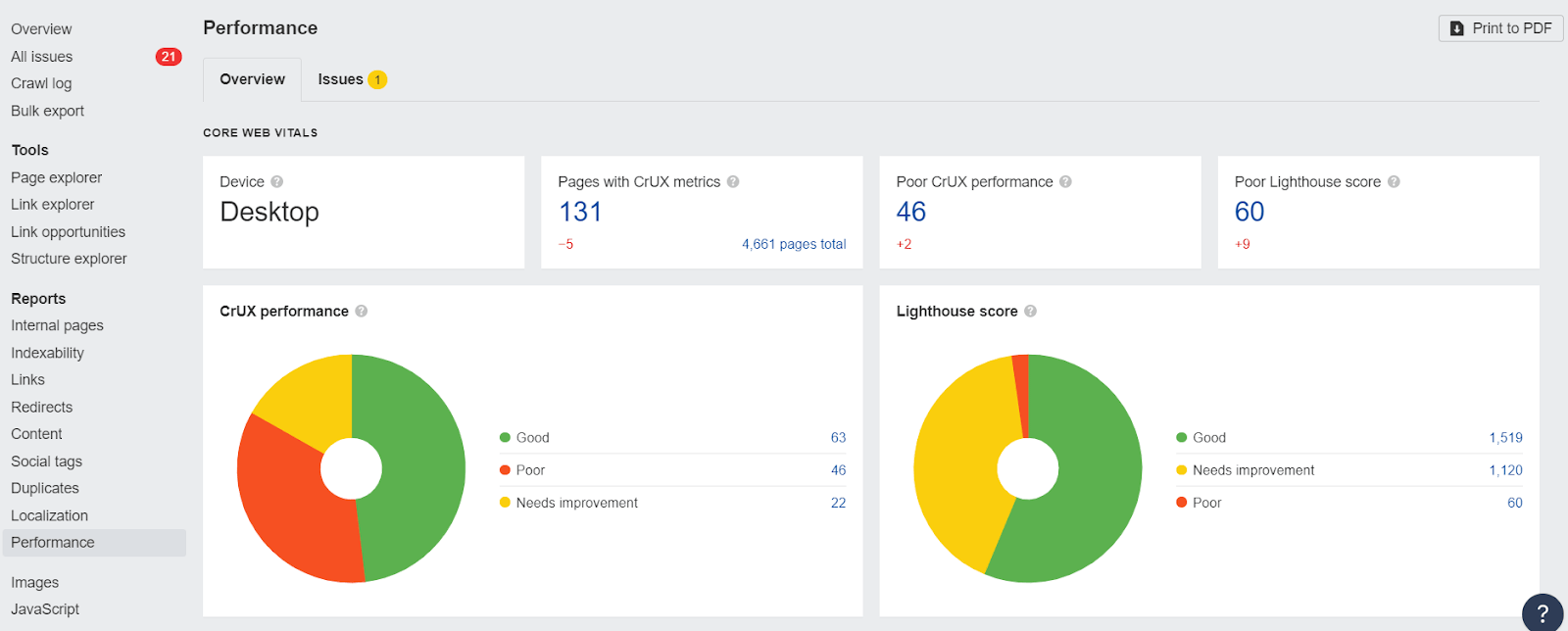

Outils tiers : Ahrefs Site Audit, GTmetrix, WebPageTest

Ahrefs Site Audit connecte l’API PageSpeed Insights pour remonter les données CWV de tout votre site en un seul rapport, avec suivi dans le temps. C’est la solution la plus efficace pour monitorer les CWV à grande échelle.

GTmetrix propose des tests de lab avec une bonne visualisation en cascade (waterfall), utile pour identifier les ressources qui ralentissent le chargement.

WebPageTest est l’outil le plus avancé pour les tests de performance approfondis : il permet de simuler différents appareils, réseaux et localisations géographiques.

Vérifier une page isolée avec PageSpeed Insights, c’est bien. Savoir quelles pages de tout votre site posent problème, et dans quel ordre les traiter, c’est mieux.

Utiliser le rapport GSC pour prioriser les pages

Le rapport Core Web Vitals de la Search Console est le point de départ. Il vous donne une vue globale par statut (Bon / À améliorer / Mauvais) pour mobile et desktop, et vous indique le nombre d’URL impactées par chaque type de problème.

Commencez par les pages “Mauvaises” en mobile — c’est là que l’impact sur le ranking est le plus direct.

Auditer en masse avec Ahrefs Site Audit

L’Audit de Site Ahrefs connecte l’API PageSpeed Insights pour récupérer les données CWV de toutes vos pages en un seul crawl, avec suivi dans le temps. Contrairement à la GSC, vous obtenez les données de lab page par page — utile pour identifier les causes précises, pas seulement les symptômes.

Pour activer les données CWV dans votre crawl : Paramètres du crawl > Performance > Activer PageSpeed Insights.

Interpréter les données : pages groupées par template

C’est le principe clé de l’audit CWV à grande échelle : Google (et la GSC) regroupe les pages par template, pas par URL individuelle. Une page produit, une page catégorie et un article de blog partagent rarement le même template, donc rarement les mêmes problèmes.

Concrètement : si 200 pages produits ont un mauvais LCP, la cause est probablement unique (une image hero non optimisée dans le template). Corrigez le template une fois, et les 200 pages passent. C’est pourquoi il vaut mieux raisonner par type de page plutôt que d’optimiser URL par URL.

WordPress alimente plus de 40 % du web. C’est aussi l’un des CMS où les CWV sont les plus délicats à maîtriser, notamment à cause de la multiplication des plugins et des page builders. Bonne nouvelle : l’écosystème a énormément progressé sur le sujet ces dernières années.

Les plugins d’optimisation recommandés pour les CWB et WordPress

Un bon plugin de performance peut régler automatiquement une grande partie des problèmes LCP et CLS sans toucher au code : minification CSS/JS, lazy loading, cache navigateur et serveur, préchargement des ressources critiques.

Les options les plus efficaces :

- WP Rocket — la référence payante. Gère le cache, le CSS critique inline, le defer JS et le préchargement LCP en quelques clics.

- LiteSpeed Cache — gratuit et très complet, particulièrement performant sur les hébergements LiteSpeed.

- Autoptimize — solution gratuite pour la minification et la concaténation CSS/JS, souvent couplé à un plugin de cache.

Quel que soit le plugin choisi, travaillez avec votre développeur pour les réglages avancés — une mauvaise configuration peut aggraver les scores plutôt que les améliorer.

Elementor, Divi, Webflow : comment gérer les builders ?

Les page builders sont l’une des principales causes de mauvais scores CWV sur WordPress : ils génèrent du CSS inutilisé en masse, chargent de nombreux scripts et produisent souvent un DOM très lourd.

Quelques règles pratiques :

- Activez le CSS critique dans les réglages de votre builder (Elementor Pro le propose nativement).

- Désactivez les assets inutiles page par page — charger les scripts Elementor sur toutes les pages du site, y compris celles qui n’utilisent pas le builder, est une erreur fréquente.

- Webflow génère du code plus propre que la plupart des builders WordPress, mais reste sensible aux animations et interactions qui peuvent pénaliser l’INP.

Si vos scores restent mauvais malgré les optimisations, la question du builder lui-même mérite d’être posée.

Hébergement et CDN : impact direct sur les scores

Le TTFB, et donc le LCP, commence au serveur. Un hébergement mutualisé bas de gamme peut ruiner vos efforts d’optimisation front-end, peu importe la qualité de vos plugins.

- Privilégiez un hébergement avec serveur dédié ou VPS, ou un hébergement WordPress managé (Kinsta, WP Engine, Cloudways).

- Activez un CDN pour servir les assets statiques depuis un serveur proche de l’utilisateur. Cloudflare est la solution la plus répandue et dispose d’une offre gratuite efficace.

- Vérifiez que votre hébergement supporte HTTP/2 ou HTTP/3 — ces protocoles réduisent significativement la latence des connexions multiples.

Ce que disent les représentants de Google

Google compte plus de 200 facteurs de ranking dont 7 prioritaires. Les CWV en font partie, mais les représentants de Google ont été clairs sur leur poids : faible, voire rôle de départage en cas d’égalité. Gary Illyes l’a dit sans détour à Pubcon en septembre 2023 :

“La plupart des sites ne bénéficieront pas vraiment d’une amélioration de leurs Core Web Vitals.” — Gary Illyes (@methode), Pubcon, sept. 2023

Ce que montrent les études de corrélation

Certaines études montrent des corrélations positives entre de bons scores CWV et de meilleures positions dans les SERP. J’y porte un regard sceptique. Ce serait comme dire que ce sont les sites qui se concentrent sur le SEO qui ont tendance à mieux ranker. Si un site travaille à améliorer ses CWV, il a certainement déjà fait beaucoup d’efforts sur d’autres points aussi : contenu, backlinks, SEO technique.

Isoler l’impact des CWV dans les données de ranking reste méthodologiquement difficile, d’autant que plusieurs Core Updates se sont superposés depuis leur introduction.

Faut-il tout sacrifier pour un score parfait ?

Non. Si votre argumentaire pour optimiser les CWV repose uniquement sur le SEO, c’est un argument fragile. En revanche, c’est à prendre en compte pour l’expérience utilisateur et l’expérience utilisateur, elle, a un impact mesurable sur les conversions.

Côté priorités : si votre site est lent au point d’avoir de mauvais scores CWV, les corriger aura probablement plus d’impact sur vos taux de rebond et de conversion que sur vos positions. Commencez par là, et traitez les CWV comme un investissement UX, pas comme un levier SEO direct.

Une bonne nouvelle : les choses seront de plus en plus simples à mesure que de nouvelles technologies sortiront. Beaucoup de plateformes gèrent déjà une partie des tâches d’optimisation automatiquement. WordPress précharge la première image nativement, Cloudflare a déployé Early Hints, Signed Exchanges et HTTP/3. Dans quelques années, la plupart des sites n’auront probablement plus à s’en préoccuper activement.

Conclusion

Je ne pense pas que les Core Web Vitals aient un grand impact en matière de SEO. À moins que le site soit très lent, ma priorité n’est pas de les optimiser. Si vous voulez faire un argumentaire pour optimiser les CWS, ne vous servez pas du SEO comme argument.

Mais par contre, c’est à prendre en compte pour l’expérience utilisateur. Comme je l’ai dit dans mon article sur la vitesse de page, des améliorations vont permettre de faire rentrer plus de données dans Analytics, ce qui va “donner l’impression” d’une amélioration. Vous pouvez aussi améliorer les CWV pour avoir plus de conversions, beaucoup d’études tendent à le prouver (mais c’est peut-être encore là parce qu’il y a plus de données enregistrées).

Un autre point important : en tant que SEO, travaillez avec vos développeurs : ce sont eux les experts. L’optimisation de la vitesse peut être un sujet très complexe. Si vous êtes seul, vous allez peut-être avoir besoin d’un plugin ou d’un service tiers (par exemple WP Rocket ou Autoptimize) pour gérer cela.

Les choses seront de plus en plus simples à mesure que de nouvelles technologies sortent et que des plateformes comme votre CMS, votre CFN voire nos navigateurs gèrent une partie des tâches d’optimisation. Je pense que dans quelques années, la plupart des sites n’auront pas à s’inquiéter de ces facteurs, car l’optimisation sera presque automatique.

Beaucoup de plateformes ont déjà sorties des fonctionnalités ou travaillent sur ce sujet.

D’ores et déjà, WordPress précharge la première image et monte une équipe pour travailler sur les Wore Web Vitals. Cloudflare a déjà sorti beaucoup d’éléments pour rendre votre site plus rapide comme Early Hints, Signed Exchanges, et HTTP/3.. Je pense que cela va continuer jusqu’au point qu’un propriétaire de site n’ait même plus à se poser de questions.

Comme toujours, écrivez-moi sur Twitter si vous avez des questions et sur Linkedin pour les francophones.